Como renderizar animação no Blender: guia completo para artistas 3D

Visão geral

Introdução

Renderizar um único fotograma no Blender é simples. Renderizar uma animação — centenas ou milhares de fotogramas com qualidade consistente, sem cintilação e com tempos de renderização geríveis — é um desafio completamente diferente. Cada ineficiência nas definições de renderização é multiplicada pelo número de fotogramas, e os problemas invisíveis numa imagem estática (ruído temporal, cintilação de luz, fugas de memória) tornam-se evidentes em movimento.

Renderizamos animações de Blender diariamente na nossa render farm, e os problemas que vemos com maior frequência resumem-se aos mesmos erros: formato de saída errado, contagens de amostras não otimizadas, denoising que introduz artefactos temporais e memória que cresce fotograma a fotograma até o trabalho falhar. Este guia percorre todo o processo de configuração e renderização de uma animação no Blender 4.x, desde as definições iniciais de renderização até à saída final — quer renderize localmente ou envie fotogramas para uma render farm na nuvem.

Os exemplos aqui utilizam o Blender 4.2 LTS com Cycles, embora também abordemos os workflows do Eevee quando relevante. Se precisar de uma referência mais aprofundada sobre definições individuais de renderização, o nosso guia de otimização de definições de renderização do Blender abrange cada painel em detalhe.

Escolher o motor de renderização para animação

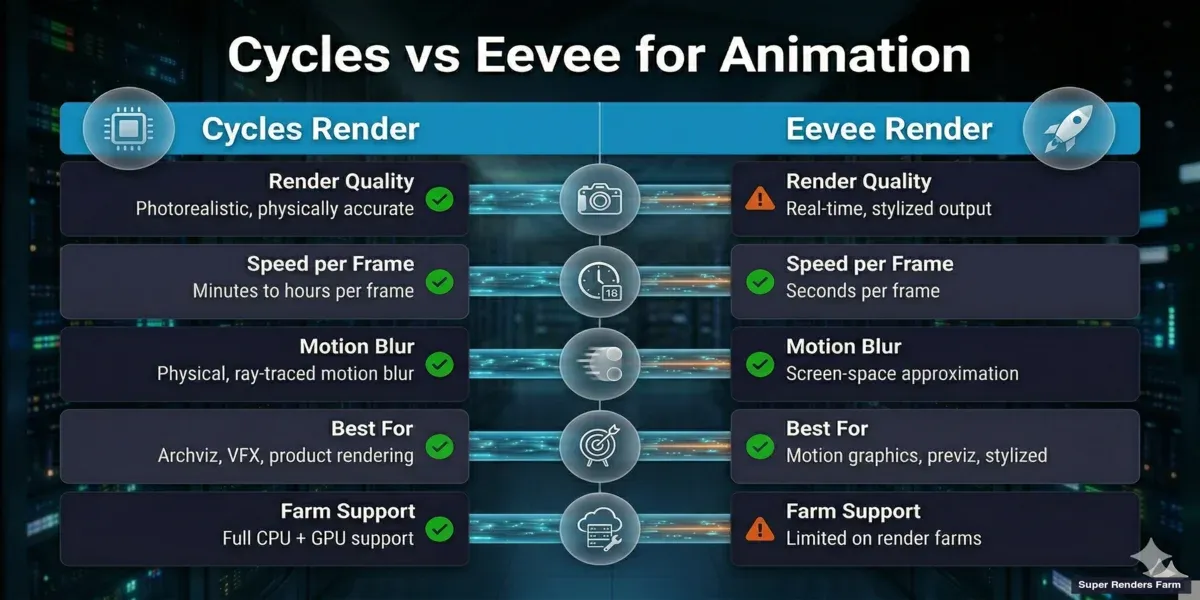

O Blender inclui dois motores de produção: Cycles (traçado de raios) e Eevee (rasterização). Ambos podem renderizar animações, mas têm pontos fortes diferentes para trabalho em movimento.

Cycles é a escolha principal para animação fotorrealista. Processa iluminação complexa, reflexos, volumétricos e motion blur fisicamente — o que significa que obtém resultados corretos sem simular nada artificialmente. A contrapartida é o tempo de renderização. Um único fotograma de Cycles pode demorar entre 2 a 30 minutos dependendo da complexidade, pelo que uma animação de 300 fotogramas pode demorar entre 10 horas e vários dias numa única máquina.

Eevee (Eevee Next no Blender 4.x) renderiza a velocidades quase em tempo real usando rasterização. É excelente para motion graphics, animação estilizada e previz. O Eevee processa animações onde o fotorrealismo absoluto não é necessário — sequências de títulos, loops abstratos, fly-throughs arquitetónicos onde a velocidade importa mais do que a precisão do ray-tracing. O manual do Blender aborda ambos os motores em detalhe.

Quando usar qual:

| Cenário | Motor recomendado |

|---|---|

| Visita guiada arquitetónica (fotorrealista) | Cycles |

| Plataforma giratória de produto com reflexos/cáusticas | Cycles |

| Motion graphics / sequência de títulos | Eevee |

| Animação de personagens (look estilizado) | Eevee |

| Pranchas de compositing VFX | Cycles |

| Previz rápido antes do render final | Eevee, depois Cycles para os finais |

| Animação longa (1.000+ fotogramas, prazo apertado) | Cycles numa render farm |

Um workflow comum que vemos: os artistas iteram sobre o timing e o movimento de câmara com o Eevee (segundos por fotograma), depois mudam para Cycles para o render final. Isto poupa horas de espera durante a fase criativa.

Infografia de comparação — Cycles vs Eevee para renderização de animação no Blender

Configurar a renderização da animação

Antes de clicar em Render Animation, configure estas definições principais no painel Output Properties.

Intervalo de fotogramas

Defina o fotograma inicial e o fotograma final em Output Properties > Format. O Blender tem como predefinição os fotogramas 1-250. Para trabalho de produção, ajuste-os exatamente para corresponder à sua linha de tempo — renderizar fotogramas extra é desperdício de tempo, e fotogramas em falta significam nova renderização.

A definição Frame Step renderiza cada N-ésimo fotograma. Definir como 2 renderiza os fotogramas 1, 3, 5, 7... o que é útil para renders de teste para verificar o timing a metade do custo. Reponha sempre para 1 nos renders finais.

Taxa de fotogramas

Corresponda ao formato de entrega alvo do seu projeto:

| Caso de utilização | Taxa de fotogramas |

|---|---|

| Cinema / cinemático | 24 fps |

| Transmissão europeia (PAL) | 25 fps |

| Transmissão norte-americana (NTSC) | 30 fps |

| Vídeo web / YouTube | 24 ou 30 fps |

| Câmara lenta (renderizado a velocidade normal) | 60 fps |

| Cinemáticas de jogos | 30 ou 60 fps |

Defina em Output Properties > Format > Frame Rate. Alterar a taxa de fotogramas após a animação ter fotogramas-chave requer reajuste temporal — defina antes de começar a animar.

Resolução

Defina a resolução de saída final em Output Properties > Format. Resoluções de produção comuns:

- 1920 × 1080 (Full HD) — padrão para a maioria das entregas

- 2560 × 1440 (2K) — cada vez mais comum para web

- 3840 × 2160 (4K UHD) — entrega de alta qualidade, 4× os píxeis do HD

Use o controlo deslizante Resolution Percentage (predefinição 100 %) para fazer renders de teste com resolução reduzida. Renderizar a 50 % dá um quarto dos píxeis — muito mais rápido para verificar composição e timing.

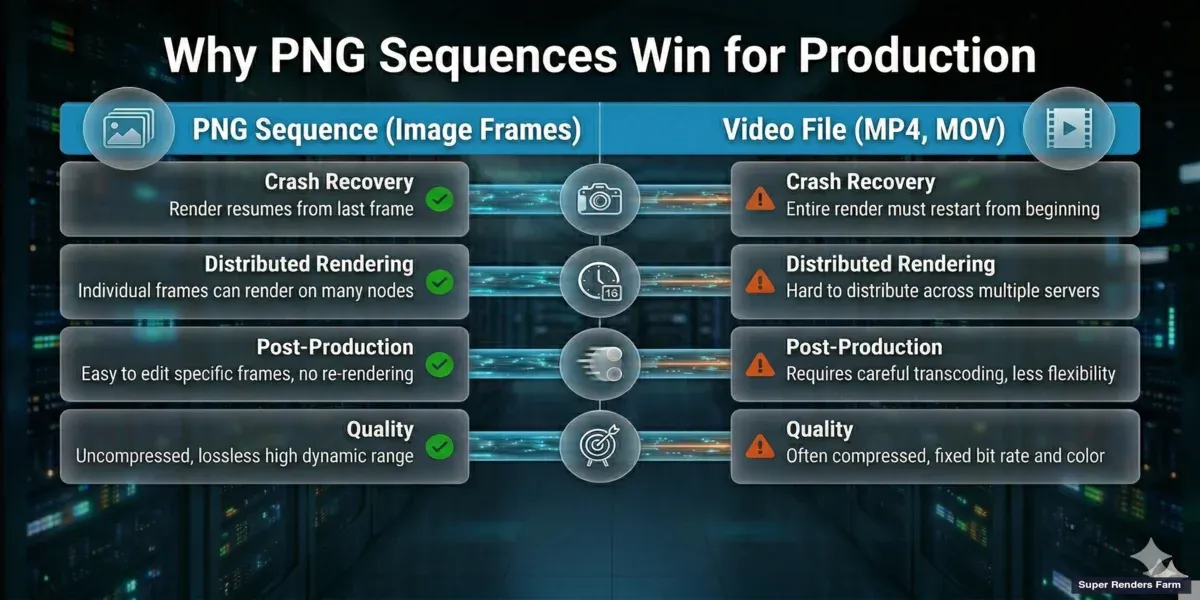

Formato de saída: sequência PNG vs ficheiro de vídeo

Esta é uma das decisões mais importantes na renderização de animações, e a resposta é quase sempre: renderize para uma sequência de imagens PNG, não para um ficheiro de vídeo.

Porque as sequências PNG são preferidas na produção:

-

Recuperação após falha. Se o Blender falhar no fotograma 847 de uma animação de 1.200 fotogramas, tem 846 fotogramas concluídos. Altere o fotograma inicial para 847 e retome. Com um ficheiro de vídeo, uma falha significa começar do zero — todo o ficheiro pode estar corrompido.

-

Renderização distribuída. As render farms dividem a sua animação por muitas máquinas. A máquina A renderiza os fotogramas 1-100, a máquina B renderiza os 101-200, e assim sucessivamente. Cada máquina escreve ficheiros de imagem individuais. Isto é impossível com um único contentor de vídeo.

-

Flexibilidade de pós-produção. As sequências de imagens são importadas fotograma a fotograma para software de compositing (After Effects, Nuke, DaVinci Resolve), permitindo gradação de cor não destrutiva, reajuste temporal e efeitos. Também pode substituir fotogramas defeituosos individuais sem renderizar novamente toda a sequência.

-

Sem perda de qualidade. O PNG não tem perdas. Os codecs de vídeo como H.264 têm perdas — comprimem fotogramas e introduzem artefactos, especialmente em áreas com detalhes finos ou gradientes subtis.

Quando a saída de vídeo é aceitável: Pré-visualizações rápidas, renders de teste, rascunhos para redes sociais onde a conveniência supera a qualidade. Use FFmpeg (contentor de vídeo) com um codec rápido para estes casos.

Definições de saída recomendadas:

| Definição | Valor | Porquê |

|---|---|---|

| Formato de ficheiro | PNG | Sem perdas, universal, seguro após falha |

| Modo de cor | RGBA | Preserva transparência para compositing |

| Profundidade de cor | 16 bits | Mais margem para gradação de cor |

| Compressão | 15 % | Bom equilíbrio entre tamanho de ficheiro e velocidade de escrita |

| Caminho de saída | //render/nome-projeto/frame_#### | Relativo ao ficheiro .blend, organizado |

Infografia comparando sequência de imagens PNG e saída de ficheiro de vídeo para renderização de animação no Blender

Para workflows OpenEXR (compositing VFX com passes de renderização), defina o formato de ficheiro como OpenEXR Multilayer. Isto incorpora todos os passes de renderização (difuso, brilhante, sombra, névoa, cryptomatte) num único ficheiro por fotograma — essencial para pipelines de compositing profissional. Consulte o nosso guia de workflows EXR e Cryptomatte para mais detalhes.

Otimizar as definições de renderização do Cycles para animação

A renderização de animação multiplica cada ineficiência. Uma definição que adiciona 30 segundos por fotograma adiciona 2,5 horas a uma animação de 300 fotogramas. Veja como otimizar o Cycles especificamente para trabalho de animação.

Amostragem e amostragem adaptativa

O Cycles no Blender 4.x usa amostragem adaptativa por predefinição. Em vez de renderizar um número fixo de amostras por píxel, para de amostrar píxeis que já convergiram — áreas brilhantes bem iluminadas convergem rapidamente enquanto cantos escuros e cáusticas precisam de mais amostras.

Para animação, configure:

- Render Samples: Defina como limite superior. 256 a 512 é um bom intervalo para a maioria das cenas com denoising ativado. Interiores complexos podem precisar de 1.024.

- Noise Threshold: 0,01 é um bom valor predefinido. Valores mais baixos (0,005) produzem fotogramas mais limpos mas aumentam o tempo de renderização. Para animação, a consistência entre fotogramas importa mais do que a limpeza absoluta — um nível de ruído consistente é limpo pelo denoising, enquanto níveis variáveis causam um efeito de "natação" visível no vídeo final.

- Min Samples: Mantenha em 32 ou superior para evitar que a amostragem adaptativa faça atalhos nos píxeis iniciais. Valores abaixo de 16 podem causar artefactos em áreas de gradiente.

Denoising para animação

O denoising é crítico para animação — permite renderizar com contagens de amostras mais baixas mantendo a qualidade visual. Mas nem todos os denoisers processam animação da mesma forma.

- OpenImageDenoise (OIDN): Baseado em CPU, incluído com o Blender. Produz excelentes resultados e é a opção mais estável para animação. O comportamento consistente fotograma a fotograma minimiza a cintilação temporal. Use como predefinição.

- OptiX Denoiser: Baseado em GPU (apenas NVIDIA). Mais rápido que o OIDN mas pode produzir resultados ligeiramente diferentes fotograma a fotograma, o que pode causar cintilação subtil em animações. Mais adequado para renders de pré-visualização onde a velocidade importa.

Para animação de produção, recomendamos: OIDN com definição de qualidade "Accurate", aplicado como passe de renderização (não viewport). Ative em Render Properties > Sampling > Denoise. Certifique-se de que o passe Denoising Data está ativado em View Layer Properties > Passes > Data — isto fornece ao denoiser informações adicionais (passes normal e albedo) para melhores resultados.

Caminhos de luz

As definições de caminhos de luz controlam quantas vezes os raios ricocheteiam na cena. Para animação:

- Ricochetes totais: 8-12 para a maioria das cenas. Interiores arquitetónicos com muitas superfícies refletoras podem precisar de 12-16.

- Ricochetes de transparência: Aumente para 16-32 se a cena tiver vidros empilhados, cortinas ou materiais translúcidos em camadas. Ricochetes de transparência insuficientes causam artefactos negros que cintilam na animação.

- Ricochetes de volume: Apenas aumente acima de 0 se tiver névoa volumétrica, fumo ou fogo. Cada ricochete de volume adiciona tempo de renderização significativo.

Motion blur

O Cycles processa o motion blur fisicamente — amostra a cena em múltiplos pontos temporais dentro do intervalo de obturação de cada fotograma. Isto é preciso mas dispendioso.

- Shutter: 0,5 é padrão (obturador de 180 graus). Valores acima de 1,0 criam desfocagem exagerada. Valores abaixo de 0,25 podem não produzir desfocagem visível a 24fps.

- Steps: Controla a qualidade do motion blur. O padrão (1) funciona para movimento simples. Aumente para 3-5 para objetos em movimento rápido ou com deformação complexa.

- Position: "Center on Frame" é o padrão. "Start on Frame" muda a direção da desfocagem.

Se o motion blur estiver a adicionar mais de 30 % ao tempo de renderização, considere renderizar sem ele e adicioná-lo em pós-produção usando um passe de vetor — exporte o passe de renderização Vector e aplique desfocagem direcional no compositor.

Gestão de memória para animações longas

Os problemas de memória são a causa mais comum de falhas em renders de animação. Uma cena que renderiza o fotograma 1 sem problema pode falhar no fotograma 400 porque o uso de memória cresce ao longo do tempo.

Porque a memória cresce durante a renderização de animação:

- Cache de texturas: O Blender guarda texturas em memória. Texturas animadas ou texturas procedurais que mudam por fotograma acumulam dados em cache.

- Sistemas de partículas: As simulações de cabelo, tecido e fluido guardam o estado por fotograma. Simulações longas podem consumir gigabytes.

- Histórico de anulação: O Blender mantém os passos de anulação em memória por predefinição. Para renderização, isto não serve nenhum propósito.

Como prevenir falhas de memória:

- Cozer simulações antes de renderizar. Coza os sistemas de partículas, tecido, fluido e corpo rígido no disco. Isto impede o Blender de recalcular a física em cada fotograma e mantém a memória previsível.

- Reduzir os passos de anulação. Em Preferences > System, reduza Undo Steps para 0 durante a renderização. Isto liberta memória que de outra forma se acumularia.

- Usar Persistent Images (Render Properties > Performance). Isto mantém os dados de textura em memória entre fotogramas em vez de os recarregar — parece contra-intuitivo, mas previne a fragmentação de memória que causa fugas graduais.

- Ativar renderização CPU + GPU (Cycles). Em Preferences > System > Cycles Render Devices, ative tanto CPU como GPU. Isto distribui a carga de trabalho e pode prevenir o overflow de memória GPU em cenas complexas. Consulte o nosso guia de renderização GPU vs CPU para saber quando faz sentido.

- Renderizar em blocos. Se renderizar localmente numa máquina com RAM limitada, divida a animação em blocos (fotogramas 1-100, 101-200, etc.) e reinicie o Blender entre blocos. Isto limpa a memória acumulada.

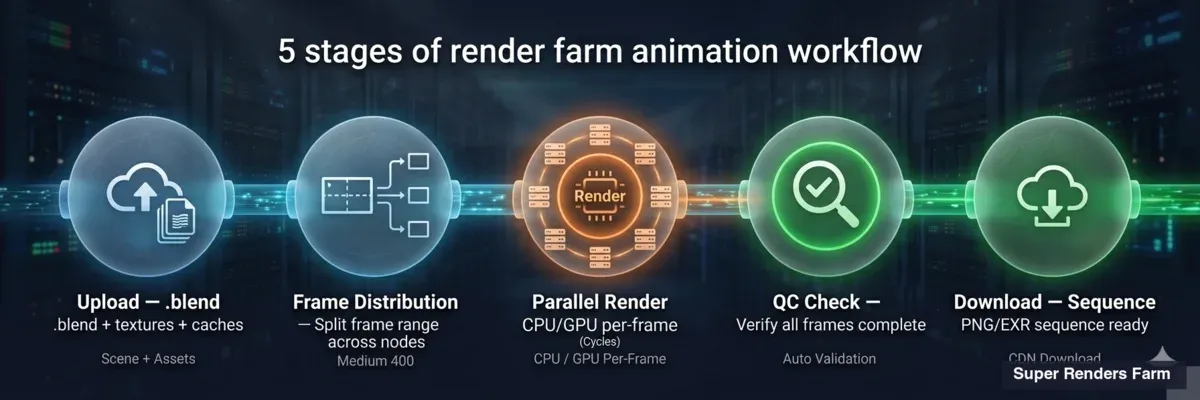

Renderizar animações do Blender numa render farm

Para animações com mais de algumas centenas de fotogramas, a renderização local é frequentemente impraticável. Uma animação Cycles de 500 fotogramas a 5 minutos por fotograma demora 42 horas numa única máquina. Numa render farm, esses mesmos 500 fotogramas distribuem-se por dezenas de máquinas e ficam prontos em horas em vez de dias.

Diagrama de pipeline mostrando o workflow de render farm para animações do Blender — upload, distribuição, renderização, download

Como funciona a renderização em farm para animações:

- Faz upload do ficheiro .blend e todos os assets ligados (texturas, caches, HDRIs) através da ferramenta de submissão da farm.

- A farm divide o intervalo de fotogramas pelas máquinas disponíveis. Cada máquina renderiza os seus fotogramas atribuídos de forma independente.

- Os fotogramas concluídos são carregados para a pasta de download como ficheiros PNG ou EXR — um ficheiro por fotograma.

- Faz download da sequência completa e monta-a localmente.

Esta é precisamente a razão pela qual as sequências PNG são importantes. Cada máquina escreve ficheiros de fotogramas individuais. Não existe um único contentor de vídeo que possa ficar corrompido.

O que suportamos para o Blender na nossa farm:

- Cycles (CPU e GPU): Suporte completo. A renderização CPU usa a nossa frota de 20.000+ núcleos. A renderização GPU usa placas NVIDIA RTX 5090 com 32 GB de VRAM — suficiente para a maioria das cenas de produção. Incluímos automaticamente o licenciamento do Blender (o Blender é open source, pelo que não há custo de licença).

- Eevee: Suporte limitado em render farms. O Eevee depende muito do contexto GPU e do estado do viewport de formas que tornam a renderização distribuída pouco fiável. Funciona para algumas cenas, mas recomendamos Cycles para submissões em farm. Se o projeto precisar de Eevee, teste primeiro um pequeno intervalo de fotogramas.

Preparar o ficheiro .blend para submissão na farm:

- Embalar ficheiros externos. Vá a File > External Data > Pack Resources. Isto incorpora texturas e HDRIs no ficheiro .blend para que se transferam corretamente para a farm.

- Cozer todas as simulações. Os caches de partículas, tecido e fluido devem estar cozidos e guardados — as máquinas da farm não podem executar a simulação do zero.

- Definir saída para PNG ou EXR. Nunca defina a saída para um formato de vídeo ao submeter para uma farm — cada máquina tentaria escrever no mesmo ficheiro de vídeo.

- Remover objetos apenas de viewport. Desative ou elimine objetos usados apenas para referência de viewport (empties com imagens de fundo, meshes de guia). Desperdiçam memória nas máquinas da farm.

- Testar 3 fotogramas. Renderize localmente fotogramas do início, meio e fim da linha de tempo para verificar as definições antes de fazer upload. Isto deteta problemas que desperdiçariam créditos de farm.

Para um guia detalhado sobre preços e submissão, consulte a nossa página de preços e o guia de render farm para Blender.

Renderizar múltiplos ângulos de câmara

Muitos projetos de animação requerem renders de múltiplos ângulos de câmara — visitas arquitetónicas com diferentes pontos de vista, plataformas giratórias de produtos com grandes planos e planos gerais, ou pranchas VFX de múltiplas câmaras virtuais.

O Blender suporta isto através de configurações de múltiplas câmaras baseadas em cenas e renderização em lote com Python. Em vez de duplicar toda a cena, cria cópias de cena ligadas que partilham geometria mas referenciam diferentes câmaras ativas. Um script Python itera depois pelas cenas e renderiza cada uma sequencialmente.

Esta abordagem funciona bem tanto em máquinas locais como em render farms. Numa farm, cada ângulo de câmara pode ser submetido como um trabalho separado, renderizando todos os ângulos em paralelo. Abordamos a configuração completa no nosso guia para renderizar múltiplas câmaras no Blender.

Problemas comuns de renderização de animação

Cintilação entre fotogramas

A cintilação é geralmente causada por amostras insuficientes em áreas com iluminação complexa. A amostragem adaptativa pode convergir de forma diferente de fotograma para fotograma, criando variação de luminosidade visível. Solução: aumente Min Samples para 64, aperte Noise Threshold para 0,005 e certifique-se de que o denoising está ativo. Para cenas ricas em fireflies (picos de píxeis brilhantes de cáusticas), ative o valor Clamp Indirect em 10 — isto limita o brilho dos caminhos de luz indiretos.

Artefactos de denoising em movimento

Os denoisers de IA podem produzir resultados ligeiramente diferentes por fotograma, causando um efeito de textura "a ferver" ou "a nadar" em áreas que deveriam ser estáticas. Solução: use OpenImageDenoise (OIDN) em vez de OptiX para renders finais. O OIDN é mais consistente temporalmente. Certifique-se também de que está a renderizar os passes Denoising Data (albedo + normal) — sem eles, o denoiser tem menos informação e produz resultados menos estáveis.

Falhas de memória em fotogramas tardios

Se a renderização falhar no fotograma N mas o fotograma 1 renderizar normalmente, a memória está provavelmente a acumular-se. Consulte a secção de Gestão de memória acima. O culpado mais comum são as simulações não cozidas — coza tudo no disco antes de renderizar.

A animação renderiza de forma diferente da pré-visualização no viewport

Isto acontece geralmente porque as definições do viewport e de renderização divergem. Verifique: resolução de renderização vs resolução do viewport, amostras de renderização vs amostras do viewport, e câmara de renderização vs câmara do viewport. A renderização usa sempre a câmara ativa definida em Scene Properties > Camera — não a câmara através da qual está a ver no viewport.

A saída de render substitui fotogramas anteriores

Se o caminho de saída não incluir um marcador de posição de número de fotograma (####), o Blender substitui o mesmo ficheiro em cada fotograma. Certifique-se de que o caminho de saída termina com algo como frame_#### — o #### é substituído pelo número do fotograma (com quatro dígitos).

Montar o vídeo final

Depois de renderizar a sequência PNG ou EXR, precisa de a codificar num ficheiro de vídeo para entrega.

Usar o Video Sequence Editor (VSE) do Blender:

- Abra um novo ficheiro do Blender (ou mude para o espaço de trabalho Video Editing).

- No Sequencer, vá a Add > Image/Sequence. Navegue até à pasta de render e selecione todos os fotogramas.

- Defina a resolução de saída e a taxa de fotogramas para corresponder às suas definições de render.

- Defina Output como FFmpeg Video, contentor MP4, codec H.264, qualidade de codificação Alta ou Sem perdas.

- Render Animation (Ctrl+F12) — isto codifica a sequência num vídeo.

Usar FFmpeg diretamente (mais rápido, sem interface gráfica):

ffmpeg -framerate 24 -i frame_%04d.png -c:v libx264 -crf 18 -pix_fmt yuv420p output.mp4

-framerate 24: corresponder à taxa de fotogramas do projeto-crf 18: qualidade (mais baixo = melhor, 18 é visualmente sem perdas)-pix_fmt yuv420p: garante compatibilidade com a maioria dos players

Para entrega profissional, renderize para ProRes (para entrega de edição) ou DNxHR (para transmissão) em vez de H.264.

FAQ

Q: Que formato de saída devo usar para renderizar animações no Blender? A: A sequência de imagens PNG é o formato recomendado para renderização de animação em produção. O PNG não tem perdas, permite recuperação após falha (conserva todos os fotogramas renderizados antes de uma falha), e é compatível com os workflows de render farm onde múltiplas máquinas renderizam fotogramas simultaneamente. Codifique para H.264 ou ProRes apenas como passo final de entrega.

Q: Como reduzir o tempo de renderização para animações do Blender? A: Ative a amostragem adaptativa com um Noise Threshold de 0,01, use OpenImageDenoise para permitir contagens de amostras mais baixas (256-512 em vez de 2.048+), reduza os ricochetes dos caminhos de luz de acordo com a complexidade da cena e renderize na resolução mínima necessária. Para projetos grandes, usar uma render farm com milhares de núcleos CPU pode reduzir dias de renderização a horas.

Q: Posso renderizar animações Eevee numa render farm? A: O Eevee tem suporte limitado em render farms porque depende do contexto GPU e do estado do viewport que nem sempre se transferem de forma limpa entre máquinas. O Cycles é o motor recomendado para renderização em farm. Se o projeto precisar de Eevee, teste primeiro um pequeno intervalo de fotogramas na farm para verificar a compatibilidade antes de se comprometer com um render completo.

Q: Porque cintilam os fotogramas da minha animação do Blender? A: A cintilação é tipicamente causada pela amostragem adaptativa que converge de forma diferente por fotograma, produzindo níveis de ruído variáveis que o denoiser trata de forma inconsistente. Corrija aumentando Min Samples para 64, apertando Noise Threshold para 0,005, usando OpenImageDenoise (que é mais estável temporalmente que o OptiX) e ativando os passes Denoising Data para melhor entrada no denoiser.

Q: Devo usar renderização GPU ou CPU para animações do Blender? A: Ambas funcionam bem para animações Cycles. A renderização GPU (CUDA, OptiX, HIP) é mais rápida por fotograma mas limitada pela VRAM — cenas complexas com muitas texturas podem exceder a memória GPU. A renderização CPU processa qualquer tamanho de cena mas é mais lenta por fotograma. Para render farms, as frotas de CPU oferecem mais núcleos de computação totais, enquanto as máquinas GPU oferecem tempos de fotograma individuais mais rápidos. Muitos artistas usam renderização GPU para cenas simples e CPU para cenas complexas.

Q: Como retomo um render de animação falhado no Blender? A: Se renderizou para uma sequência de imagens PNG ou EXR, verifique a pasta de saída para encontrar o último fotograma renderizado com sucesso. Defina o fotograma inicial para o número de fotograma seguinte e renderize novamente — o Blender continua a partir do ponto onde parou. Se ativar "Overwrite" em Output Properties, os fotogramas existentes são re-renderizados; desative para ignorar fotogramas que já existem no disco.

Q: O que causa falhas de memória durante renders de animação longos? A: A memória acumula-se tipicamente de simulações não cozidas (partículas, tecido, fluido), cache de texturas e histórico de anulação. Coza todas as simulações no disco antes de renderizar, reduza Undo Steps para 0 em Preferences e ative Persistent Images nas definições de desempenho de renderização. Para animações extremamente longas, considere renderizar em blocos e reiniciar o Blender entre eles para limpar a memória acumulada.

Q: De quantas amostras preciso para a renderização de animação no Cycles? A: Com denoising ativado, 256 a 512 amostras e um Noise Threshold de 0,01 produzem resultados limpos para a maioria das cenas. Interiores arquitetónicos com cáusticas complexas podem precisar de 1.024 amostras. A chave para a animação é a consistência — um nível de ruído uniforme entre fotogramas é mais previsível para fazer denoising do que níveis variáveis. Use a amostragem adaptativa para deixar o Blender alocar amostras extra apenas onde for necessário.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.