Blender Cloud Rendering: Come renderizzare i propri progetti su una render farm

Panoramica

Introduzione

Renderizzare una scena Blender complessa in locale significa tenere la workstation occupata per ore — a volte giorni, se si lavora su animazioni o still ad alta risoluzione con volumetrici pesanti. Il cloud rendering risolve questo problema distribuendo il rendering su decine o centinaia di macchine, restituendo i frame completati mentre si continua a lavorare sul prossimo shot.

Rendiamo progetti Blender ogni giorno sulla nostra farm. I progetti spaziano da singoli still architettonici fino ad animazioni di personaggi da 10.000 frame, e le domande degli artisti tendono a seguire lo stesso schema: come si prepara la scena, quale motore funziona sulla farm, cosa succede alle texture e agli add-on, e quanto costerà effettivamente? Questa guida risponde a tutte queste domande.

Che si abbia già utilizzato una render farm o che sia la prima volta che ci si allontana dalla propria macchina locale, il workflow è lo stesso: preparare la scena, caricarla, configurare le impostazioni di rendering da remoto e scaricare i risultati. I dettagli di ogni fase sono quelli che contano, ed è esattamente ciò che viene trattato qui.

Perché il cloud rendering ha senso per Blender

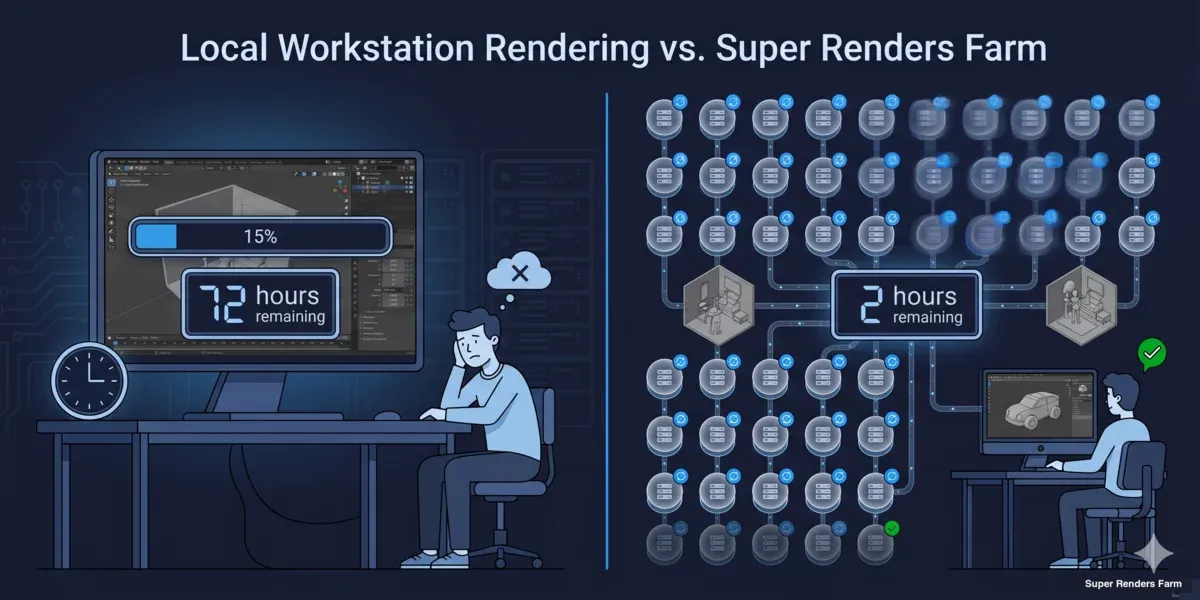

Blender è gratuito, ma il rendering non lo è — costa tempo. Un singolo frame Cycles su una GPU desktop moderna può richiedere da 5 a 15 minuti per una scena di interni. Moltiplicato per 300 frame, si arriva a 25-75 ore di rendering continuo su una sola macchina. Significa da tre a nove giorni con la workstation non disponibile per modellazione, texturing o illuminazione.

Una cloud render farm cambia questa equazione:

| Fattore | Rendering locale | Cloud rendering |

|---|---|---|

| Costo hardware | $2.000-$5.000 iniziali (workstation GPU) | Pagamento per frame o per ora |

| Tempo di rendering (300 frame) | 25-75 ore | 1-4 ore (distribuito) |

| Disponibilità della workstation | Bloccata durante il rendering | Libera per continuare a lavorare |

| Scalabilità | Limitata all'hardware disponibile | Scala fino a centinaia di nodi |

| Energia e raffreddamento | A carico dell'utente | Inclusi nel costo di rendering |

Confronto tra cloud rendering e rendering locale per Blender — tempo, costo e scalabilità

Il cloud rendering è particolarmente utile per gli utenti Blender perché il software stesso è gratuito — il principale costo di produzione è o l'hardware o il tempo di rendering. Spostare la fase di rendering nel cloud mantiene basso il budget hardware eliminando al contempo il collo di bottiglia temporale.

Questo vale per i freelance che lavorano contro le scadenze dei clienti, per gli studi che gestiscono più progetti contemporaneamente e per gli studenti che hanno le competenze ma non l'hardware. Per un confronto più ampio tra cloud e rendering locale, la nostra analisi del costo totale build vs cloud (in inglese) analizza i numeri in dettaglio.

Preparare la scena Blender per il cloud rendering

La preparazione della scena è il passaggio più importante. Una scena che funziona perfettamente sulla propria macchina può fallire su una farm se gli asset esterni mancano, i percorsi sono errati o le dipendenze non sono incorporate.

Incorporare tutti i dati esterni. Andare su File > External Data > Automatically Pack Resources. Questo incorpora texture, HDRI, font e altri file esterni direttamente nel file .blend. Senza questo passaggio, le macchine della farm non troveranno le texture e il rendering risulterà sbagliato — superfici grigie, ambienti mancanti o errori veri e propri.

Usare percorsi relativi. In Edit > Preferences > File Paths, verificare che i percorsi predefiniti siano relativi (//textures/ anziché C:\Users\NomeUtente\textures\). I percorsi assoluti che puntano al disco locale non funzioneranno su nessuna macchina diversa dalla propria.

Bake di simulazioni e cache. Le simulazioni fisiche (tessuto, fluidi, corpo rigido, fumo), i sistemi di particelle e i Geometry Nodes che dipendono da dati di simulazione devono essere sottoposti a bake prima dell'invio. La farm renderizza i frame in modo indipendente — non esegue la simulazione dal frame 1 per generare il frame 200. Se la cache non è stata sottoposta a bake, i frame falliranno o renderizzeranno lo stato a riposo dell'oggetto fisico.

Semplificare o rimuovere gli elementi solo viewport. I overlay del viewport, le annotazioni grease pencil (a meno che non facciano parte del rendering) e gli oggetti su layer di rendering disabilitati dovrebbero essere ripuliti. Non causano errori, ma possono aumentare la dimensione del file e aggiungere confusione durante il debug.

Verificare le impostazioni di output. Nel pannello Output Properties:

- Impostare la risoluzione (corrispondente alle specifiche di consegna — non lasciare il default 1920x1080 se il progetto richiede il 4K)

- Impostare il range di frame (frame iniziale e finale)

- Impostare il formato di output: PNG per gli still, OpenEXR per i workflow di compositing, sequenza PNG per le animazioni

- Impostare il percorso di output (la farm di solito lo sovrascriverà, ma è buona norma configurarlo correttamente)

Una checklist rapida prima del caricamento:

- Tutte le texture incorporate (File > External Data > Automatically Pack Resources)

- Percorsi relativi abilitati

- Simulazioni e cache sottoposte a bake

- Motore di rendering impostato correttamente (Cycles o Eevee)

- Formato di output e risoluzione configurati

- Camera selezionata (la camera corretta è impostata come attiva)

- Range di frame definito

- Nessuna libreria collegata mancante (File > External Data > Report Missing Files)

Fasi di preparazione della scena Blender per il cloud rendering — incorporare texture, bake delle simulazioni, verificare le impostazioni

Cycles su una cloud render farm

Cycles è il motore principale utilizzato per il cloud rendering con Blender. È un path tracer fisicamente accurato e il suo output è deterministico — data la stessa scena e le stesse impostazioni, qualsiasi macchina produrrà lo stesso risultato. Questo lo rende ideale per il rendering distribuito.

Rendering CPU vs GPU su una farm. Cycles supporta sia il rendering CPU che GPU. Su una farm, la scelta dipende dalla scena:

| Tipo di scena | Consigliato | Perché |

|---|---|---|

| Geometria pesante (milioni di poligoni) | CPU | Più RAM di sistema disponibile (96-256 GB vs limiti VRAM GPU) |

| Volumetrici e subsurface scattering | CPU | La CPU gestisce questi bene; l'accelerazione GPU varia |

| Materiali standard, geometria moderata | GPU | Tempi di rendering per frame significativamente più veloci |

| Scene con utilizzo di memoria inferiore a 20-24 GB | GPU | Si adatta comodamente alla VRAM GPU (RTX 5090: 32 GB) |

| Misto (geometria pesante + materiali GPU) | CPU con denoising GPU | Combina capacità di memoria con denoising rapido |

Sulla nostra farm, circa il 70% dei job Blender viene eseguito su CPU (Dual Intel Xeon E5-2699 V4, 96-256 GB RAM) e il 30% su GPU (NVIDIA RTX 5090, 32 GB VRAM). Il rendering CPU è affidabile per qualsiasi scena indipendentemente dalla memoria — non si raggiungerà mai il limite VRAM. Il rendering GPU è più veloce per frame ma richiede che la scena si adatti alla memoria della GPU.

Impostazioni Cycles fondamentali per il cloud rendering:

- Samples: Impostare il numero di sample desiderato. Con l'adaptive sampling abilitato (Render Properties > Sampling > Noise Threshold impostato a 0,01), Cycles interromperà il campionamento dei singoli pixel una volta raggiunta una qualità accettabile. Questo risparmia tempo nelle aree semplici del frame senza ridurre la qualità nelle regioni complesse.

- Denoising: Abilitare OpenImageDenoise (OIDN) come denoiser. Funziona come post-processo e gestisce bene il rumore con un numero inferiore di sample. Su una farm, questo permette di ridurre il numero di sample (ad esempio da 4096 a 1024-2048) e lasciare che il denoiser pulisca il rumore residuo — riducendo significativamente i tempi di rendering.

- Light paths: Per la maggior parte delle scene di produzione, le impostazioni predefinite dei light path funzionano. Se la scena ha caustiche complesse o una profonda ricorsione del vetro, potrebbe essere necessario aumentare i bounce di Transmission e Glossy. Per gli interni architettonici, 8-12 bounce totali sono un punto di partenza comune.

- Tile size: In Blender 3.0 e versioni successive, la tile size è gestita automaticamente. Non è più necessario impostare manualmente tile grandi per GPU o tile piccole per CPU — il motore gestisce questa operazione da solo.

Per un approfondimento su ogni pannello di rendering Cycles, consultare la nostra guida all'ottimizzazione delle impostazioni di rendering Blender (in inglese).

Eevee e il cloud rendering

Eevee (Eevee Next in Blender 4.x) funziona in modo diverso da Cycles. È un motore di rasterizzazione — renderizza utilizzando tecniche screen-space, shadow map e light probe anziché il ray tracing. Questo lo rende estremamente veloce in locale, ma introduce complicazioni su una render farm.

Il problema principale: I rendering Eevee non sono così semplici da distribuire come quelli Cycles. Eevee dipende da un contesto GPU e da certi stati derivati dal viewport (baking delle light probe, riflessioni screen-space) che possono comportarsi diversamente tra macchine diverse. Alcune render farm supportano Eevee, ma i risultati potrebbero non corrispondere esattamente al rendering locale.

La nostra raccomandazione: Se il progetto utilizza Eevee, è consigliabile renderizzare in locale — è abbastanza veloce da rendere il cloud rendering generalmente non necessario. Un'animazione Eevee da 300 frame che impiega 5 secondi per frame termina in 25 minuti su una singola GPU. Se si ha effettivamente bisogno del rendering su farm per Eevee (animazioni molto lunghe o risoluzioni molto alte), è opportuno verificare con la render farm che supportino Eevee e testare con un piccolo batch di frame prima di affidare l'intero job.

Per il lavoro di produzione che richiede sia qualità che velocità, un approccio comune è iterare in Eevee durante la produzione e renderizzare l'output finale in Cycles su una farm. Questo garantisce feedback in tempo reale durante il processo creativo e risultati fisicamente accurati per la consegna.

Il workflow di invio

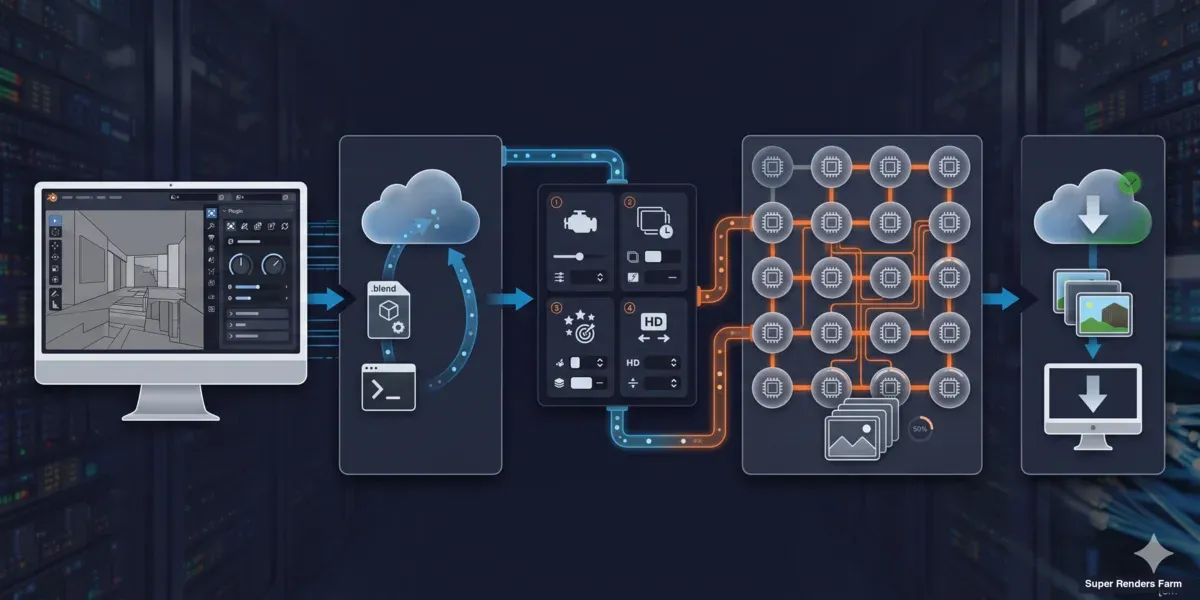

I passaggi esatti variano a seconda della render farm, ma il workflow di base è coerente in tutte. Ecco come appare il processo su una farm completamente gestita come Super Renders Farm:

Passo 1: Installare il plugin. La maggior parte delle render farm fornisce un add-on Blender che si integra direttamente nell'interfaccia. Sulla nostra farm, il plugin Super Renders Farm per Blender aggiunge un pannello nelle proprietà di rendering dove è possibile configurare e inviare i job senza uscire da Blender.

Passo 2: Caricare la scena. Il plugin impacchetta il file .blend (con tutti gli asset incorporati) e lo carica sulla farm. Se la scena utilizza asset esterni che non possono essere incorporati (ad esempio librerie di texture molto grandi, cache di simulazione memorizzate separatamente), è possibile caricarli come archivio separato.

Passo 3: Configurare le impostazioni della farm. Selezionare il motore di render (Cycles CPU o GPU), il range di frame, il formato di output e il livello di priorità. L'interfaccia della farm potrebbe anche consentire di impostare un limite di costo o le preferenze di notifica.

Passo 4: Inviare e monitorare. Una volta inviato, la farm distribuisce i frame sulle macchine disponibili. È possibile monitorare l'avanzamento nel pannello del plugin o sulla dashboard web della farm — osservando il completamento dei frame, i tempi di rendering per frame e gli eventuali log degli errori.

Passo 5: Scaricare i risultati. I frame completati sono disponibili per il download man mano che vengono completati. La maggior parte delle farm supporta il download automatico tramite il plugin, così i frame appaiono nella cartella di output senza intervento manuale.

L'intero processo — dal clic su "Submit" alla ricezione dei primi frame — richiede tipicamente da 5 a 15 minuti a seconda della velocità di upload e della coda della farm.

Workflow di invio alla render farm per Blender — installare il plugin, caricare, configurare, renderizzare, scaricare

Licenze e compatibilità degli add-on

Una delle preoccupazioni più comuni tra gli artisti Blender che si avvicinano al cloud rendering: cosa succede agli add-on e agli asset commerciali?

Blender stesso: Blender è open source (GPL). Non ci sono restrizioni di licenza — la farm può eseguire Blender liberamente su ogni macchina.

Motori di rendering: Cycles è incluso con Blender e non comporta costi di licenza aggiuntivi. Se si utilizza un motore di terze parti come V-Ray per Blender o Redshift per Blender, la render farm deve disporre di quelle licenze. Sulla nostra farm, includiamo le licenze V-Ray, Corona, Arnold e Redshift come parte del costo di rendering — non è necessario fornire la propria licenza.

Add-on che modificano la geometria: Add-on come Scatter, BagaPie o configurazioni di Geometry Nodes che generano geometria al momento del rendering devono essere disponibili sulla farm. L'approccio più sicuro è applicare i modificatori e convertire la geometria procedurale in mesh prima dell'invio. Se l'add-on è commerciale, è opportuno verificare con la farm — alcune installano add-on comuni, altre no.

Librerie di texture e asset: Gli asset di librerie come Poliigon, Quixel Megascans o Poly Haven sono compatibili purché siano incorporati nel file .blend. La farm non necessita di accesso separato a queste librerie — ha bisogno solo delle texture incorporate nel file di scena.

Ottimizzazione dei costi

I costi del cloud rendering dipendono da tre variabili: tempo di rendering per frame, numero di frame e tipo di hardware utilizzato (CPU vs GPU). Ecco modi pratici per ridurre i costi:

1. Ottimizzare la scena prima del caricamento. Ogni minuto risparmiato per frame si moltiplica sull'intero job. I guadagni maggiori:

- Abilitare l'adaptive sampling (Noise Threshold: 0,01) — può ridurre il tempo di rendering del 20-40%

- Usare OpenImageDenoise e ridurre il numero di sample (2048 → 1024)

- Limitare i light bounce a quelli effettivamente necessari per la scena (interni: 8-12, esterni: 4-6)

- Disabilitare i render layer non necessari per l'output finale

2. Testare prima con un piccolo batch. Renderizzare da 5 a 10 frame prima di inviare l'intero job. Questo individua gli errori in anticipo (texture mancanti, impostazioni errate, problemi di memoria) e fornisce una stima accurata del costo per frame. Moltiplicando per il totale dei frame si ottiene il budget prima di impegnarsi.

3. Scegliere il tier hardware adeguato. Il rendering GPU è più veloce per frame ma costa di più per ora. Il rendering CPU è più lento per frame ma meno costoso per ora. Per molte scene, il costo totale risulta simile — ma se la scena si adatta alla memoria GPU (meno di 20-24 GB), il rendering GPU è solitamente più conveniente perché i tempi più veloci compensano la tariffa oraria più alta.

4. Usare i range di frame in modo strategico. Per la resa di un'animazione, è consigliabile inviare per range (frame 1-100, 101-200) anziché un unico job massiccio. Questo permette di individuare i problemi dopo il primo batch e di regolare le impostazioni prima di esaurire l'intero budget.

Per modelli di prezzo dettagliati e calcoli dei costi, consultare la nostra guida al costo per frame della render farm (in inglese) e la pagina dei prezzi.

Problemi comuni e risoluzione dei problemi

Questi sono i problemi che si riscontrano più spesso con i job di cloud rendering Blender, sulla base di ticket di supporto reali:

| Problema | Causa | Soluzione |

|---|---|---|

| Texture mancanti (superfici grigie o rosa) | Asset non incorporati | File > External Data > Pack All Into .blend |

| Il rendering appare diverso dal locale | Versione Cycles diversa | Abbinare la versione Blender sulla farm a quella locale |

| Memoria esaurita (GPU) | La scena supera la VRAM GPU | Passare al rendering CPU o semplificare la geometria |

| La simulazione non viene renderizzata correttamente | Cache non sottoposta a bake | Bake di tutte le simulazioni prima dell'invio |

| Frame casuali falliti | Scena instabile (geometria corrotta o espressioni driver) | Testare localmente con il frame esatto che ha fallito |

| Frame neri | Camera non impostata, o render region abilitata | Verificare la camera attiva e disabilitare la render region (Ctrl+Alt+B) |

| Il rendering impiega più del previsto | Alto numero di sample senza adaptive sampling | Abilitare l'adaptive sampling con noise threshold 0,01 |

| Il colore appare sbagliato | Mancata corrispondenza nella gestione del colore | Impostare View Transform su AgX o Filmic (abbinare le impostazioni locali) |

Se si incontra un problema non elencato qui, un buon primo passo è renderizzare localmente il frame che ha fallito con le stesse impostazioni. Se funziona in locale, il problema è probabilmente legato al packaging del file (asset o percorsi mancanti). Se fallisce anche in locale, il problema è nelle impostazioni della scena.

Geometry Nodes e workflow procedurali

Il sistema Geometry Nodes di Blender merita un'attenzione speciale per il cloud rendering. La geometria procedurale generata al momento del rendering funziona correttamente su una farm — la farm valuta gli alberi di nodi esattamente come farebbe la macchina locale. Tuttavia, esistono alcuni casi limite:

Simulation zones (novità in Blender 4.x): devono essere sottoposte a bake prima dell'invio, proprio come le simulazioni fisiche tradizionali. La farm renderizza i frame in modo indipendente e non può simulare in avanti dal frame 1.

Variazioni di seed casuali: Se la configurazione di Geometry Nodes utilizza distribuzioni casuali, l'output sarà identico sulla farm purché i valori seed siano gli stessi. Questo viene gestito automaticamente — Cycles è deterministico.

Alberi di nodi ad alta intensità di calcolo: Le configurazioni procedurali complesse possono essere intensive in termini di memoria. Se i Geometry Nodes generano milioni di istanze al momento del rendering, è opportuno monitorare prima l'utilizzo di memoria locale. Le scene che utilizzano più di 60 GB di RAM in locale avranno bisogno del rendering CPU sulla farm (che dispone di 96-256 GB). Il rendering GPU fallirà se la geometria generata supera la VRAM.

Come iniziare

Passare dal rendering locale al cloud rendering è semplice una volta che la scena è adeguatamente preparata. Il processo per la maggior parte degli artisti Blender:

- Preparare la scena — incorporare gli asset, bake delle simulazioni, verificare le impostazioni

- Installare il plugin della farm — scaricarlo dalla documentazione della farm

- Inviare un test batch — 5-10 frame per verificare che tutto venga renderizzato correttamente

- Rivedere e regolare — controllare la qualità dell'output, il costo per frame, i tempi di rendering

- Inviare il job completo — e continuare a lavorare mentre la farm gestisce il rendering

Per la guida alle impostazioni di rendering specifiche per Blender, la nostra guida all'ottimizzazione delle impostazioni di rendering (in inglese) copre ogni pannello. Per i workflow specifici delle animazioni, la guida al rendering di animazioni (in inglese) illustra le sequenze di frame, i formati di output e il denoising temporale.

Per la valutazione delle render farm per Blender, il nostro confronto delle render farm Blender per il 2026 (in inglese) illustra cosa cercare — modelli di prezzo, supporto dei motori e qualità del plugin.

FAQ

Il cloud rendering Blender supporta sia Cycles che Eevee?

Cycles è completamente supportato su tutte le principali render farm perché produce risultati deterministici su hardware diverso. Eevee ha un supporto limitato sulle farm a causa della sua dipendenza dal contesto GPU — la maggior parte delle farm consiglia Cycles per il rendering distribuito. Se il progetto utilizza Eevee, il rendering in locale è solitamente più veloce e più affidabile.

È necessario fornire una licenza Blender per il cloud rendering?

No. Blender è un software open source rilasciato sotto licenza GPL, quindi le render farm possono eseguirlo su ogni macchina senza costi di licenza. Questo è uno dei vantaggi di Blender per il cloud rendering — non c'è costo di licenza per nodo come avviene con alcune applicazioni DCC commerciali.

Come si prepara il file Blender per una render farm?

Bisogna incorporare tutte le risorse esterne nel file .blend (File > External Data > Automatically Pack Resources), usare percorsi relativi, eseguire il bake di tutte le simulazioni e le cache fisiche, e impostare il motore di rendering, la risoluzione, il range di frame e il formato di output prima del caricamento. Eseguire File > External Data > Report Missing Files per individuare eventuali riferimenti non risolti.

Cosa succede alle texture e agli add-on quando si renderizza nel cloud?

Le texture incorporate nel file .blend vengono renderizzate correttamente su qualsiasi macchina della farm. Per gli add-on commerciali che generano geometria al momento del rendering, l'approccio più sicuro è applicare il modificatore o convertire in mesh prima dell'invio. I motori di rendering di terze parti (V-Ray, Redshift) necessitano di licenze sulla farm — le farm completamente gestite le includono tipicamente nel costo di rendering.

Il rendering GPU o CPU è migliore per Blender su una farm?

Dipende dalla scena. Il rendering GPU (ad esempio NVIDIA RTX 5090) è più veloce per frame ed è conveniente per le scene che si adattano alla VRAM (meno di 20-24 GB). Il rendering CPU (Dual Xeon, 96-256 GB RAM) gestisce qualsiasi scena indipendentemente dalla memoria ed è più affidabile per geometria pesante, volumetrici e subsurface scattering. Molte farm offrono entrambe le opzioni — è consigliabile testare alcuni frame su ciascuna per confrontare.

Quanto costa renderizzare un progetto Blender su una cloud render farm?

Il costo dipende dal tempo di rendering per frame, dal numero di frame e dal tipo di hardware. Un esempio indicativo: una scena di interni Cycles a 2048 sample che renderizza in 8 minuti per frame su GPU costa approssimativamente $0,30-0,80 per frame. Un'animazione da 300 frame costerebbe $90-240. L'abilitazione dell'adaptive sampling e del denoising può ridurre questo importo del 30-50%. La maggior parte delle farm permette di eseguire un piccolo test batch per stimare il costo totale prima di impegnarsi.

È possibile renderizzare Geometry Nodes e configurazioni procedurali su una cloud render farm?

Sì. I Geometry Nodes vengono valutati in modo identico sulle macchine della farm come farebbero in locale — l'output è deterministico. La principale considerazione è la memoria: se la configurazione procedurale genera milioni di istanze, è necessario assicurarsi che la scena si adatti ai limiti hardware della farm. Le simulation zones (Blender 4.x) devono essere sottoposte a bake prima dell'invio, proprio come le simulazioni fisiche tradizionali.

Quali versioni di Blender supportano le render farm?

La maggior parte delle farm supporta tutte le versioni stabili ufficiali e le versioni LTS. Sulla nostra farm, manteniamo le versioni Blender attuali e LTS e aggiorniamo entro pochi giorni dalle nuove uscite. È sempre consigliabile abbinare la versione Blender sulla farm a quella utilizzata per creare la scena — le incompatibilità di versione possono causare differenze nell'output del rendering, specialmente con shader e Geometry Nodes.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.