Tendencias de la industria VFX en 2026: tiempo real, IA, Gaussian Splatting, OpenUSD y economía cloud

Resumen

Introducción

El VFX de 2026 presenta una estructura radicalmente diferente a la de 2022. Cinco cambios están reconfigurando simultáneamente la economía del renderizado: los motores de tiempo real cruzando el umbral del píxel final, la IA pasando del denoising al interior del pipeline, el Gaussian Splatting entrando en las herramientas de producción como un tipo de asset de primera clase, OpenUSD madurando hasta convertirse en el estándar de intercambio de la industria, y el renderizado en la nube pasando de ser una opción a ser la infraestructura predeterminada para estudios fuera del primer nivel.

Durante los últimos años, hemos observado cómo estas tendencias llegaban de forma fragmentada a Super Renders Farm. Ya no son experimentales; se manifiestan en trabajos de producción entregados, en lanzamientos de herramientas publicadas y en nuestra propia combinación de trabajos. Este artículo es una encuesta sobre tendencias del sector dirigida a responsables de decisiones en estudios, TDs de pipeline y artistas que planifican dónde invertir su tiempo de aprendizaje y presupuesto — no es una comparativa de proveedores ni una guía de compra.

Tendencias de la industria VFX 2026 — convergencia de motores de tiempo real, denoising IA, Gaussian Splatting, OpenUSD y renderizado en la nube

El panorama de la industria en 2026

El dimensionamiento del mercado VFX en 2026 varía considerablemente según el alcance. Mordor Intelligence valora el mercado combinado de animación y VFX en aproximadamente 220.690 millones de USD en 2026 con una CAGR del 11,86 % hasta 2031, aunque esa cifra absorbe largometrajes de animación, TV animada, motion design y visualización. Las estimaciones de VFX puro son menores y más controvertidas: Research Nester dimensiona la industria de efectos visuales en 27.590 millones de USD en 2026; los informes de alcance más reducido rondan los 13.230 millones de USD. El delta metodológico es relevante porque los grandes titulares absorben mercados adyacentes que no comparten las estructuras de costos propias del VFX.

Una cifra más reveladora para los estudios es la capa de renderizado específicamente. Los analistas del sector proyectan que el mercado de renderizado 3D crecerá desde aproximadamente 4.300 millones de USD en 2025 hasta 13.920 millones de USD en 2031 (una CAGR de ~21,6 %), con la cuota del renderizado GPU aumentando desde aproximadamente el 55,8 % en 2024 hasta ~60 % en 2026. El cambio en la composición es la señal más clara de los datos: la capa de renderizado crece más rápido que el mercado VFX que la contiene, y dentro de esa capa es la cuota GPU la que se está compoundando.

La segunda variable es la recuperación post-huelga. Las huelgas de la WGA y la SAG-AFTRA de 2023 redujeron el volumen de producción upstream que fluyó hacia los pipelines de proveedores VFX durante gran parte de 2024 y parte de 2025. VFX Voice (la revista de la Visual Effects Society) caracteriza la entrada a 2026 como un equilibrio entre incertidumbre y oportunidad — los pipelines vuelven a llenarse, pero el empleo freelance sigue siendo desigual. La tercera variable es la consolidación del nivel medio: varios estudios pivotaron hacia servicios de producción virtual o divisiones inmersivas durante el período de contracción, cambiando la composición de compradores en el lado de las render farms.

El renderizado en tiempo real cruza el umbral del píxel final

La gran historia del tiempo real en 2026 es que el muro entre "tiempo real para previs" y "offline para píxel final" ha dejado de ser un muro. VFX Voice y los medios de cobertura del NAB Show 2025 caracterizan el renderizado casi en tiempo real como uno de los cambios tecnológicos más significativos del sector — junto con la generación de imágenes asistida por IA — porque cambia qué trabajo tiene que estar en cola y cuál puede revisarse en directo.

Unreal Engine 5, con geometría virtualizada Nanite e iluminación global Lumen, es el exponente visible de ese cambio. La técnica no es nueva — StageCraft de ILM renderizó The Mandalorian en Unreal Engine a partir de 2019 para rodar entornos diversos en un único plató — pero en 2026 el mismo enfoque está llegando a producciones de segundo nivel y trabajo de difusión, no solo a series de streaming de máximo presupuesto. La cobertura del NAB Show 2025 (ProductionHUB, VP-Land, Nitro Media Group) situó la producción virtual en el centro del espacio por tercer año consecutivo, con Sony presentando el sistema de seguimiento de cámara sin marcadores Ocellus y herramientas de compensación de color fuera de eje para Crystal LED que reducen materialmente el costo de operar un volumen LED.

La implicación económica no es que el renderizado offline desaparezca — sino que el volumen de trabajo que califica para el tiempo real se ha expandido. Las placas de fondo para VFX en cámara (ICVFX) en escenarios LED son trabajo de tiempo real. El previs y el postvis son trabajo de tiempo real. Cada vez más, los planos principales en comerciales de presupuesto medio y piezas de difusión también se entregan desde la Movie Render Queue de Unreal Engine 5.

Lo que permanece offline en 2026 es el trabajo de finales de película fotorrealistas donde el transporte de luz trazada por caminos, la salida multicapa deep-EXR y los ciclos de iteración artística por plano siguen siendo dominantes. V-Ray, Arnold, Redshift y Karma continúan evolucionando en el lado offline: V-Ray 7 añadió soporte de Gaussian Splat trazable por rayos (véase la siguiente sección), Karma XPU continúa madurando, y los lanzamientos de Redshift 2026 se han centrado en volumétricas y complejidad de shaders. Estos motores y la pila de tiempo real ya no compiten en suma cero; se superponen en diferentes etapas del pipeline.

En el lado de la render farm, el crecimiento del tiempo real no ha reducido visiblemente los volúmenes de renderizado offline — ha cambiado su composición. Los trabajos offline de píxel final se inclinan hacia escenas de mayor complejidad (volumétricas, composición con trazado de splats en profundidad, cabello y ropa trazados por rayos) mientras que los planos más sencillos que antes justificaban tiempo de renderizado offline están migrando al tiempo real. La render farm offline de 2026 es un motor de complejidad, no un motor de volumen. Para la planificación de infraestructura, eso significa que el costo por fotograma importa más que el rendimiento de nodos por segundo — cubierto en nuestra guía de costo por fotograma.

La IA se adentra en el interior del pipeline

La IA en VFX en 2024 era en gran medida un debate sobre herramientas generativas en las etapas de guión y concepto. La IA en VFX en 2026 es una realidad interior del pipeline en varias categorías, cada una en un nivel de madurez diferente.

El denoising IA es un requisito básico. NVIDIA OptiX AI Denoiser e Intel Open Image Denoise (OIDN) están integrados en todos los motores de renderizado de producción principales — V-Ray, Arnold, Redshift, Cycles, Karma. Intel OIDN recibió un Premio al Logro Técnico de la Academy of Motion Picture Arts and Sciences en 2025, una señal de mercado útil: la tecnología ha alcanzado la escala de producción que cumple con los criterios de la Academia. Los informes del sector y los benchmarks agregados de render farms indican que las escenas que históricamente requerían entre 2.000 y 4.000 muestras para una salida limpia pueden alcanzar una calidad comparable con entre 200 y 500 muestras con denoising IA. En nuestra render farm, la reducción media del tiempo de renderizado en trabajos que aprovechan el denoising IA frente a trabajos equivalentes de 2024 que convergían puramente por conteo de muestras está en el rango del 40–60 %, dependiendo del motor y el tipo de escena. La varianza se debe principalmente a volumétricas intensas o profundidad de campo agresiva, donde los denoisers IA todavía dejan artefactos residuales que requieren respaldo por conteo de muestras.

La IA generativa en previs y concepto es la segunda categoría. Stable Diffusion XL y Midjourney forman ahora parte de los ciclos de lookdev de preproducción en múltiples estudios, utilizados para la iteración rápida de mood boards antes del modelado 3D completo. RunwayML y herramientas similares gestionan las composiciones rápidas para clientes. La integración en el pipeline sigue siendo ad-hoc — la mayoría de los estudios ejecutan la IA generativa como una pista paralela en lugar de una etapa integrada — pero el flujo de trabajo se ha estabilizado lo suficiente como para que lo veamos referenciado en los briefs de clientes que recibimos.

La reconstrucción de imagen a 3D y NeRF/Gaussian Splatting es la tercera categoría — pasó de curiosidad de investigación a herramienta de producción, cubierta en detalle en la siguiente sección.

La IA para rotoscopia, limpieza de matchmove y previsualizaciones de simulación es la categoría más silenciosamente transformadora. Estas tareas intermedias del pipeline históricamente consumían tiempo desproporcionado de artistas junior, y las herramientas que las aceleran cambian la economía del estudio porque liberan horas, no minutos.

Lo que la IA en 2026 no ha hecho es reemplazar el criterio del artista en las etapas de lookdev, composición o revisión directorial. El patrón en los estudios que adoptaron estas herramientas antes es que los equipos se han mantenido constantes o han crecido ligeramente mientras el rendimiento del proyecto por artista ha aumentado. Los estudios que adoptaron renderizado en la nube junto con herramientas asistidas por IA en 2025–2026 reportaron completar más proyectos en el mismo período de tiempo sin reducir la plantilla.

El Gaussian Splatting entra en el VFX de producción

El Gaussian Splatting — y su extensión temporal, el 4D Gaussian Splatting — pasó de novedad de artículo de investigación a herramienta de producción lanzada más rápido de lo que esperaba la mayoría de los supervisores de pipeline. La técnica codifica una escena 3D como millones de pequeños Gaussianos anisotrópicos en lugar de geometría poligonal más texturas; el resultado es una calidad visual fotorrealista a velocidades de renderizado en tiempo real, con escenas que rutinariamente renderizan a más de 100 FPS dentro de Unreal Engine.

A principios de 2026, los splats tienen soporte de primera clase en toda la pila de producción: Nuke 17 incluye soporte nativo de Gaussian Splat, Houdini 21 incluye una vista previa técnica, OpenUSD 26.03 añadió un esquema de primera clase, y V-Ray 7 ahora puede trazar por rayos datos de splat junto a geometría tradicional. Las integraciones de composición y motor de renderizado son importantes porque sacan los splats de las "islas" de producción virtual exclusivas de Unreal hacia el pipeline VFX más amplio.

El punto de referencia de producción es el trabajo de Framestore en Superman (2025), donde el estudio utilizó 4D Gaussian Splatting para entregar aproximadamente 40 planos de píxel final. Es el primer caso ampliamente reportado donde los splats 4D gestionaron planos que anteriormente requerían una combinación de fotogrametría tradicional, trabajo de placa y reconstrucción CG. Otros estudios los han seguido públicamente en trabajo episódico y de ICVFX.

El contexto de mercado es favorable. Las estimaciones del sector sitúan el mercado global de producción virtual en aproximadamente 2.900 millones de USD en 2025 con proyecciones hacia 18.500 millones de USD en 2035, y el Gaussian Splatting está ampliamente caracterizado como un método preferido para crear los entornos fotorrealistas que alimentan los escenarios de volumen LED. DJI Terra V5.0+ Flagship procesa reconstrucciones de Gaussian Splatting a aproximadamente 500 imágenes por hora en hardware de estación de trabajo; los sets de calidad cinematográfica típicamente requieren entre 300 y más de 1.000 imágenes de una cámara DSLR o un dron. El tiempo de captura en set hasta asset se ha comprimido de días de escaneo manual a menos de una hora para muchos entornos.

Para las render farms, los splats introducen un perfil de costo por fotograma diferente. Las escenas poligonales escalan de manera predecible con el conteo de muestras y la complejidad de shaders; las escenas trazadas con splats tienen un perfil de ancho de banda de memoria más cercano al renderizado volumétrico — la VRAM importa más, y motores como V-Ray 7 todavía están evolucionando rápidamente sus rutas de trazado de splats. Lo tratamos operativamente como una clase de trabajo que necesita benchmarking separado, no como "otro tipo de geometría más".

Pipeline de Gaussian Splatting — captura con dron o DSLR → reconstrucción → reproducción en tiempo real en Unreal Engine + composición trazada por rayos en V-Ray 7

OpenUSD como estándar de intercambio de la industria

El Universal Scene Description (USD) de Pixar, publicado como código abierto en 2016, ha sido el candidato a estándar de evolución lenta durante casi una década. En 2026, "candidato" ya no es la palabra correcta. La Alliance for OpenUSD (AOUSD), formada por Pixar con Adobe, Apple, Autodesk y NVIDIA en 2023, está en camino de formalizar las especificaciones fundamentales de OpenUSD a finales de 2025, y el SIGGRAPH 2024 demostró la expansión de OpenUSD más allá de los medios y el entretenimiento tradicionales hacia la robótica, la simulación de vehículos autónomos y la visualización industrial.

La actualización técnica más relevante para los operadores de render farms es la adición de soporte Vulkan al renderizador Hydra Storm de OpenUSD (anunciado en OpenUSD 24.08, aportado por Pixar, Autodesk y Adobe bajo el paraguas de AOUSD según informes del Khronos Group). HgiVulkan lleva la interfaz Hydra a paridad de características con los backends existentes de OpenGL y Metal y extiende USD/Hydra a dispositivos móviles Android, abriendo un objetivo de plataforma más amplio sin sacrificar la huella existente en Mac/Linux/Windows.

Lo que esto significa en la práctica:

- El intercambio de assets entre DCCs (Maya, Houdini, Cinema 4D, Blender, 3ds Max) es materialmente menos frágil que cuando se depende de FBX o exportaciones por DCC. Vemos menos tickets de soporte de "transformación rota" año tras año a medida que los estudios consolidan USD como formato de ida y vuelta.

- La interoperabilidad entre motores de renderizado está mejorando — los delegates de renderizado Hydra de V-Ray, Karma, Arnold, Cycles y otros son cada vez más viables tanto para lookdev interactivo como para renderizado por lotes, aunque la paridad con la descripción de escena nativa de cada motor varía según el motor.

- La inversión en herramientas de pipeline está pasando de importadores/exportadores por DCC a sistemas de publicación de assets nativos en USD. Los estudios que construyeron infraestructura USD en 2023–2024 están cosechando ahorros operativos; los que no lo hicieron lo están tratando como una prioridad de capex para 2026–2027.

OpenUSD no resuelve todos los problemas de intercambio en 2026 — la traducción de texturas y materiales entre delegates Hydra sigue siendo imperfecta, y las extensiones por motor crean riesgos de vendor-lock que la apertura de USD supuestamente debía eliminar. La tendencia es inequívoca, sin embargo: USD es el consenso de formato de asset que la industria no tenía del todo hace diez años.

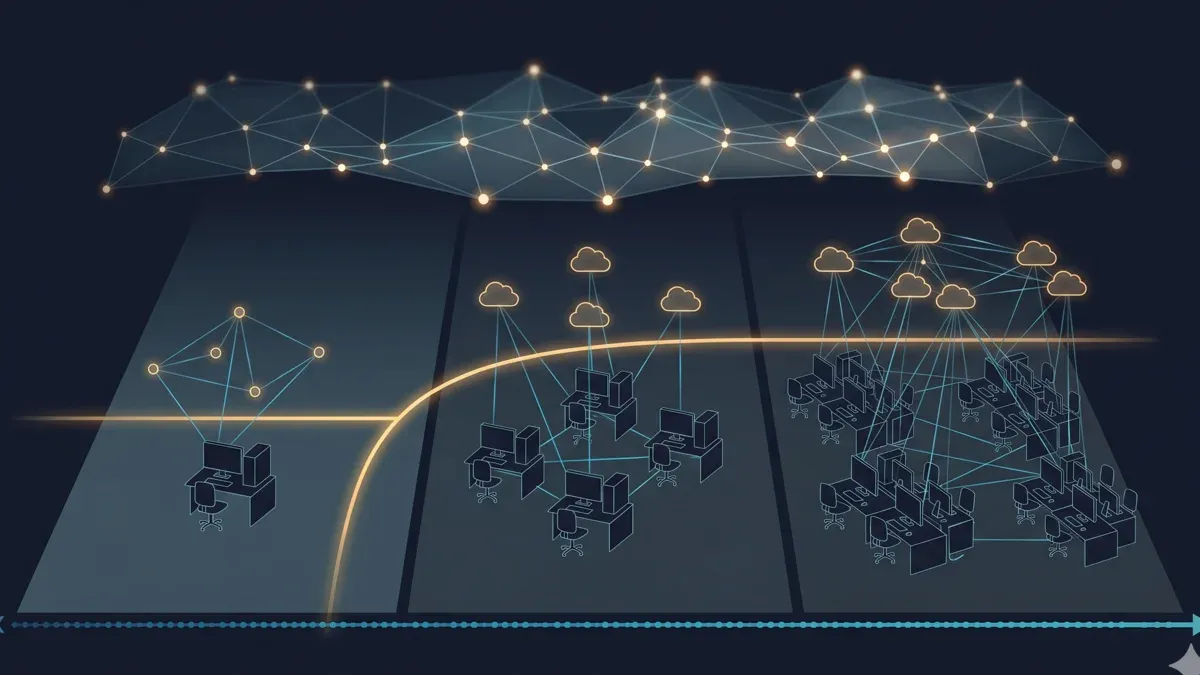

Economía del renderizado en la nube para estudios indie y de nivel medio

El tercer cambio silenciosamente transformador de 2026 está en el lado de los costos. El renderizado en la nube en 2024 se enmarcaba principalmente como capacidad de desbordamiento para estudios con sus propios muros de renderizado. En 2026, es la infraestructura predeterminada para equipos indie y una proporción creciente de estudios de nivel medio — no como plan de contingencia, sino como el núcleo de su pipeline.

Tres fuerzas están impulsando esto:

La volatilidad del precio de GPU en el lado del hardware. La NVIDIA RTX 5090 se lanzó a un precio de venta sugerido de 1.999 USD, pero los precios de venta al público en 2026 han oscilado entre 2.500 y 3.800 USD debido a la escasez de memoria GDDR7 y la demanda de cómputo de IA que desplaza el suministro al consumidor. Para un estudio pequeño que construye un nodo de renderizado de ocho GPU, ese delta multiplicado entre tarjetas más placa base, fuente de alimentación, refrigeración y rack ha desestabilizado el caso de capex para cómputo GPU auto-alojado.

La compresión del precio de GPU en la nube en el lado del opex. Los precios de GPU en la nube han bajado más rápido que los precios de tarjetas al por menor, particularmente en proveedores de segundo nivel. La cobertura del sector cita a Thunder Compute con aproximadamente 0,66 USD por GPU-hora de A100 frente a 4,10 USD en nubes de primer nivel. Esa diferencia es mayor que hace 18 meses, reduciendo la brecha de acceso entre estudios grandes y pequeños en la iteración en tiempo real y el rendimiento de fotogramas finales.

El denoising IA comprimiendo el volumen de cómputo requerido. Este es el factor menos apreciado. Si un trabajo de visualización arquitectónica que necesitaba 4.000 muestras en 2023 ahora necesita 500 con denoising IA, la factura de la nube para ese trabajo es aproximadamente 8 veces menor para la misma calidad — lo que cambia materialmente el punto de equilibrio nube-frente-a-local.

El punto de equilibrio sigue existiendo. Los muros de renderizado locales tienen sentido económico por encima de aproximadamente 400 horas de renderizado al mes de volumen consistentemente alto, donde el costo por hora del hardware propio cae por debajo de las tarifas de la nube. Por debajo de eso, la nube es estructuralmente más económica. Cubrimos las matemáticas detalladas en nuestro análisis de costo total de construcción frente a nube y en nuestra guía de precios.

Lo que es nuevo en 2026 es la distribución de estudios a cada lado de esa curva. La línea de las 400 horas solía separar "freelance/indie" de "estudio pequeño". Ahora separa cada vez más "estudio pequeño" de "nivel medio" porque más estudios pequeños han migrado a una pila cloud-first. Los estudios de nivel medio y grandes todavía construyen infraestructura híbrida: cómputo propio para la base predecible más nube para los picos.

La palanca operativa que más importa es si la nube elegida está completamente gestionada o es Infraestructura como Servicio (IaaS). Los pipelines parecen superficialmente similares pero el tiempo de artista por trabajo difiere materialmente — cubierto en nuestro análisis de gestión completa frente a DIY.

En nuestra render farm, operamos más de 20.000 núcleos CPU (nodos Dual Intel Xeon E5-2699 V4 con 96–256 GB de RAM) y una flota GPU dedicada de tarjetas NVIDIA RTX 5090 con 32 GB de VRAM cada una, con Cinema 4D + Redshift, V-Ray, Corona, Arnold, Octane y Cycles preinstalados y licenciados a nivel de plataforma. Como partner oficial de renderizado de Chaos y partner oficial de Maxon, las licencias de V-Ray, Corona y Redshift están incluidas en lugar de ser gestionadas por el usuario. El punto no es la hoja de especificaciones — es que el modelo operativo (sin escritorio remoto, sin instalaciones manuales, sin contención del servidor de licencias) es lo que determina si el renderizado en la nube realmente ahorra tiempo al artista, independientemente del proveedor.

Marco de decisión para el renderizado en la nube en 2026 — horas al mes vs tamaño del estudio vs elección gestionado-frente-a-IaaS

Lo que estas tendencias significan para los estudios en 2026

Leer las cinco tendencias como una imagen única en lugar de cinco historias separadas cambia las conclusiones estratégicas.

El aprendizaje de pipeline ha convergido. Hace tres años, un TD que planificaba la formación del equipo tenía que elegir entre profundizar en Maya/Houdini, aprender Unreal Engine, construir herramientas USD o invertir en integración de flujos de trabajo IA. En 2026, esos no son caminos distintos — un TD de pipeline competente necesita fluidez funcional en los cuatro, y lo mismo se aplica al artista senior de lookdev/iluminación cuyo trabajo ahora abarca finales offline trazados por caminos, lookdev en tiempo real y pases de lookdev asistidos por IA.

La arquitectura de cómputo se ha vuelto más heterogénea, no menos. La narrativa de 2020 decía que el renderizado GPU reemplazaría al renderizado CPU. La realidad de 2026 es que CPU todavía posee aproximadamente el 70 % de nuestra combinación de trabajos de renderizado, mientras que GPU gana cuota para trabajo con Redshift, Octane, V-Ray GPU y Gaussian Splatting. Un plan de hardware que asuma uno u otro quedará subdimensionado en algún punto.

La render farm offline ha pasado de volumen a complejidad. Los estudios que combinan esto con planificación de infraestructura — desbordar a la nube para finales trazados por caminos mientras ejecutan iteración en tiempo real y acelerada por IA internamente — obtienen el beneficio de ambas capas. Los estudios que intentan forzar cada plano a través de un modelo puramente offline o puramente en tiempo real acaban pagando por uno y usando el otro.

Los estudios indie y de nivel medio se han puesto al día en acceso a infraestructura. La barrera para producir trabajo VFX fotorrealista y complejo en 2026 es cada vez más la habilidad y la madurez del pipeline, no el acceso a GPU. Los grandes estudios ya no pueden depender de la ventaja de cómputo bruto como foso, y los estudios indie pueden superar a su clase de hardware con la disciplina operativa adecuada.

El tiempo real y el offline coexisten como herramientas diferentes, no como un patrón de sucesión. El discurso del sector a menudo enmarca el tiempo real como el eventual reemplazo del offline; cinco años de evidencia sugieren que esa no es la trayectoria. El tiempo real ha ampliado el trabajo que posee; el offline ha ampliado la complejidad que posee; ambos están creciendo. Planifica para la heterogeneidad composicional en lugar de para la transición a una sola pila.

FAQ

Q: ¿Cuáles son las mayores tendencias de la industria VFX en 2026? A: Cinco cambios están reconfigurando la industria: el renderizado en tiempo real cruzando el umbral del píxel final (Unreal Engine 5 y producción virtual), la IA pasando del denoising a tareas interiores del pipeline como previs generativo y rotoscopia, el Gaussian Splatting entrando en las herramientas de VFX de producción como un tipo de asset de primera clase, OpenUSD madurando hasta convertirse en el estándar de intercambio de la industria, y el renderizado en la nube convirtiéndose en infraestructura predeterminada para estudios indie y de nivel medio en lugar de capacidad de desbordamiento para los grandes.

Q: ¿Cómo está cambiando la IA el pipeline de renderizado VFX en 2026? A: La IA en 2026 se encuentra dentro del pipeline de producción en múltiples etapas. El denoising IA (OptiX, Intel Open Image Denoise) es estándar en V-Ray, Arnold, Redshift, Cycles y Karma, reduciendo los conteos de muestras requeridos de aproximadamente 2.000–4.000 a 200–500 para calidad comparable. Las herramientas de IA generativa como Stable Diffusion XL y RunwayML están integradas en el lookdev de preproducción y las composiciones para clientes. La reconstrucción de imagen a 3D y Gaussian Splatting ha pasado de investigación a herramienta de producción lanzada. La rotoscopia asistida por IA, la limpieza de matchmove y las previsualizaciones de simulación están comprimiendo silenciosamente el interior del pipeline.

Q: ¿Se utiliza Unreal Engine 5 para el renderizado de píxel final en 2026? A: Sí — la Movie Render Queue de Unreal Engine 5 está entregando planos de píxel final para VFX en cámara en volúmenes LED, trabajo de difusión y comerciales de presupuesto medio, y una proporción creciente de contenido episódico y teatral. La técnica fue pionera por StageCraft de ILM en The Mandalorian en 2019 y se ha escalado hacia niveles inferiores desde entonces. El trabajo de finales de película fotorrealistas que exige transporte de luz trazada por caminos, salida multicapa deep-EXR y ciclos de iteración por plano todavía se ejecuta principalmente en motores offline como V-Ray, Arnold, Redshift y Karma — el tiempo real y el offline se superponen en diferentes etapas del pipeline, no se reemplazan mutuamente.

Q: ¿Qué es el Gaussian Splatting y por qué es importante para el VFX en 2026? A: El Gaussian Splatting codifica una escena 3D como millones de pequeños Gaussianos anisotrópicos en lugar de geometría poligonal más texturas, produciendo calidad visual fotorrealista a velocidades de renderizado en tiempo real (más de 100 FPS en Unreal Engine). A principios de 2026, Nuke 17 incluye soporte nativo de splats, Houdini 21 incluye una vista previa técnica, OpenUSD 26.03 añadió un esquema de primera clase, y V-Ray 7 puede trazar por rayos datos de splat junto a geometría tradicional. Framestore utilizó 4D Gaussian Splatting para entregar aproximadamente 40 planos de píxel final en Superman (2025). El tiempo de captura en set hasta asset se ha comprimido de días a menos de una hora para muchos entornos.

Q: ¿Cómo está cambiando OpenUSD los pipelines de los estudios en 2026? A: OpenUSD (Universal Scene Description), publicado como código abierto por Pixar en 2016, se está consolidando como el estándar de intercambio de la industria. La Alliance for OpenUSD — Pixar, Adobe, Apple, Autodesk, NVIDIA, formada en 2023 — está en camino de formalizar las especificaciones fundamentales de OpenUSD a finales de 2025. El soporte Vulkan se añadió al renderizador Hydra Storm en OpenUSD 24.08, extendiendo la plataforma a un rango de dispositivos más amplio incluyendo Android. El intercambio de assets entre Maya, Houdini, Cinema 4D, Blender y 3ds Max es materialmente menos frágil que depender de FBX, y la interoperabilidad entre motores de renderizado a través de delegates de renderizado Hydra está mejorando año tras año.

Q: ¿Deberían los estudios indie y de nivel medio usar renderizado en la nube en 2026? A: Para la mayoría de las cargas de trabajo por debajo de aproximadamente 400 horas de renderizado al mes de volumen consistente, el renderizado en la nube es estructuralmente más económico que construir y mantener un muro de renderizado local — y esa línea sigue moviéndose hacia arriba a medida que los precios de GPU en la nube bajan y el denoising IA comprime los conteos de muestras requeridos. La palanca más importante para la economía del estudio es si la nube elegida está completamente gestionada (sin escritorio remoto, sin instalaciones manuales, licencias gestionadas a nivel de plataforma) o es Infraestructura como Servicio (IaaS). Por encima de 400 horas de volumen mensual consistente, los modelos híbridos — cómputo propio para la base más nube para los picos — típicamente superan a cualquiera de los extremos.

Q: ¿Cómo afectaron las huelgas de Hollywood de 2023 a las perspectivas de la industria VFX en 2026? A: Las huelgas de la WGA y la SAG-AFTRA de 2023 redujeron el volumen de producción upstream que fluyó hacia los pipelines de proveedores VFX durante gran parte de 2024 y parte de 2025. VFX Voice caracteriza la entrada a 2026 como un equilibrio entre incertidumbre y oportunidad — los pipelines vuelven a llenarse impulsados por proyectos de streaming y teatrales, pero el empleo freelance y por contrato sigue siendo desigual, particularmente en los clusters del Reino Unido y Vancouver que absorbieron los mayores despidos. Varios estudios de nivel medio pivotaron hacia servicios de producción virtual o divisiones inmersivas para diversificar los ingresos, cambiando estructuralmente la composición de compradores que sirven los operadores de render farms.

Q: ¿Qué hardware de renderizado deberían planificar los estudios para 2026? A: Planifica para la heterogeneidad. El renderizado CPU todavía posee la mayoría del volumen de trabajos de renderizado de producción — visualización arquitectónica con V-Ray y Corona, animación con Arnold, y pipelines donde la memoria por hilo importa más que los FLOPS brutos — mientras que GPU está ganando cuota para trabajo con Redshift, Octane, V-Ray GPU y Gaussian Splatting. Los precios de venta al público de la NVIDIA RTX 5090 han oscilado entre 2.500 y 3.800 USD en 2026 debido a la escasez de GDDR7 y la demanda de cómputo de IA, desestabilizando el caso de capex para cómputo GPU auto-alojado en estudios más pequeños. Los precios de GPU en la nube en proveedores de segundo nivel se han comprimido significativamente (la cobertura del sector cita aproximadamente 0,66 USD por GPU-hora de A100 frente a 4,10 USD en nubes de primer nivel), reduciendo la brecha de acceso a infraestructura entre estudios grandes y pequeños.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.