VFX-Branchentrends 2026: Echtzeit, KI, Gaussian Splatting, OpenUSD und Cloud-Rendering-Wirtschaftlichkeit

Überblick

Einführung

VFX sieht im Jahr 2026 strukturell anders aus als VFX im Jahr 2022. Fünf Entwicklungen verändern gleichzeitig die Rendering-Wirtschaftlichkeit: Echtzeit-Engines, die die Final-Pixel-Schwelle überschreiten, KI, die vom Denoising ins Innere der Pipeline vorrückt, Gaussian Splatting, das als erstklassiger Asset-Typ in Produktions-Tools Einzug hält, OpenUSD, das zum Austauschstandard der Branche heranreift, und Cloud Rendering, das für Studios außerhalb der Spitzenklasse zur Standardlösung — nicht zur Ausweichlösung — geworden ist.

In den vergangenen Jahren haben wir beobachtet, wie diese Trends schrittweise bei Super Renders Farm ankamen. Sie sind nicht länger experimentell; sie zeigen sich in veröffentlichten Produktionen, in veröffentlichten Tool-Releases und in unserem eigenen Job-Mix. Dieser Artikel ist eine Branchentrend-Übersicht für Studio-Entscheidungsträger, Pipeline-TDs und Artists, die planen, wo sie ihre Lernzeit und ihr Budget investieren — kein Anbietervergleich, kein Kaufratgeber.

VFX-Branchentrends 2026 — Konvergenz von Echtzeit-Engines, KI-Denoising, Gaussian Splatting, OpenUSD und Cloud Rendering

Der Branchenüberblick 2026

Die Marktgröße für VFX im Jahr 2026 variiert je nach Scope erheblich. Mordor Intelligence bewertet den kombinierten Animation- und VFX-Markt für 2026 auf rund 220,69 Milliarden USD mit einer CAGR von 11,86 % bis 2031, aber diese Zahl umfasst Animationsfilme, animiertes TV, Motion Design und Visualisierung. Reine VFX-Schätzungen sind kleiner und umstrittener: Research Nester beziffert die Visual-Effects-Branche für 2026 auf 27,59 Milliarden USD; engere Schätzungen liegen bei rund 13,23 Milliarden USD. Die methodische Differenz ist relevant, da die größeren Schlagzeilen-Zahlen angrenzende Märkte absorbieren, die keine VFX-spezifischen Kostenstrukturen teilen.

Eine aussagekräftigere Zahl für Studios ist die Rendering-Schicht selbst. Branchenanalysten prognostizieren, dass der Markt für 3D-Rendering von rund 4,30 Milliarden USD im Jahr 2025 auf 13,92 Milliarden USD bis 2031 wächst (eine CAGR von ~21,6 %), wobei der GPU-Rendering-Anteil von etwa 55,8 % im Jahr 2024 auf ~60 % bis 2026 steigt. Die Verschiebung im Mix ist das deutlichste Signal in den Daten: Die Rendering-Schicht wächst schneller als der VFX-Markt, der sie enthält, und innerhalb dieser Schicht ist der GPU-Anteil das am stärksten wachsende Segment.

Die zweite Variable ist die Erholung nach den Streiks. Die WGA- und SAG-AFTRA-Streiks von 2023 reduzierten das vorgelagerte Produktionsvolumen, das den Großteil des Jahres 2024 und Teile des Jahres 2025 in die Pipelines der VFX-Anbieter einfloss. VFX Voice (das Journal der Visual Effects Society) charakterisiert den Einstieg in das Jahr 2026 als Balance zwischen Unsicherheit und Chance — Pipelines füllen sich wieder, aber die freiberufliche Beschäftigung bleibt ungleich verteilt. Die dritte Variable ist die Konsolidierung im mittleren Marktsegment: Mehrere Unternehmen haben sich während des Tiefpunkts in Richtung Virtual-Production-Dienstleistungen oder Immersive-Divisions verlagert und damit die Käuferzusammensetzung auf der Seite der render farms verändert.

Echtzeit-Rendering überschreitet die Final-Pixel-Linie

Die zentrale Echtzeit-Geschichte im Jahr 2026 ist, dass die Grenze zwischen „Echtzeit für Previs" und „Offline für Final-Pixel" keine Grenze mehr ist. VFX Voice und Berichterstattungsmedien zur NAB Show 2025 bezeichnen nahezu Echtzeit-Rendering als eine der folgenreichsten technologischen Entwicklungen der Branche — neben KI-gestützter Bildgenerierung — weil sie bestimmt, welche Arbeiten in der Queue landen müssen und welche live begutachtet werden können.

Unreal Engine 5, mit der virtualisierten Geometrie Nanite und der globalen Beleuchtung Lumen, ist das sichtbare Ende dieser Entwicklung. Die Technik ist nicht neu — ILMs StageCraft renderte The Mandalorian ab 2019 in Unreal Engine, um verschiedene Umgebungen auf einer einzigen Bühne zu drehen — aber im Jahr 2026 erreicht derselbe Ansatz Tier-2-Produktionen und Broadcast-Arbeiten, nicht nur hochbudgetierte Streaming-Serien. Die Berichterstattung zur NAB Show 2025 (ProductionHUB, VP-Land, Nitro Media Group) stellte Virtual Production zum dritten Jahr in Folge in den Mittelpunkt, wobei Sony das markerfreie Kameratracking-System Ocellus und Crystal-LED-Off-Axis-Farbkompensations-Tooling vorstellte, das die Betriebskosten einer LED-Volume-Bühne erheblich senkt.

Die wirtschaftliche Konsequenz ist nicht, dass Offline-Rendering verschwindet — sondern dass das Volumen der Arbeiten, die für Echtzeit qualifizieren, gewachsen ist. Hintergrundplatten für In-Camera-VFX (ICVFX) auf LED-Bühnen sind Echtzeit-Arbeit. Previs und Postvis sind Echtzeit-Arbeit. Zunehmend werden auch vollständige Hero-Shots in mittelbudgetierten Werbespots und Broadcast-Stücken aus Unreal Engine 5's Movie Render Queue geliefert.

Was 2026 offline bleibt, ist photorealistische Film-Finals-Arbeit, bei der path-traced Lichttransport, Deep-EXR-Mehrschicht-Output und per-Shot-Künstler-Iterationszyklen dominant bleiben. V-Ray, Arnold, Redshift und Karma entwickeln sich alle auf der Offline-Seite weiter: V-Ray 7 fügte ray-traceable Gaussian-Splat-Unterstützung hinzu (siehe nächster Abschnitt), Karma XPU reift weiter heran, und die Redshift-Releases von 2026 konzentrierten sich auf Volumetrics und Shader-Komplexität. Diese Engines und der Echtzeit-Stack stehen nicht mehr in einem Nullsummen-Wettbewerb; sie schichten sich auf verschiedene Phasen der Pipeline auf.

Auf der Farm-Seite hat Echtzeit-Wachstum die Offline-Rendervolumen nicht sichtbar reduziert — es hat deren Zusammensetzung verändert. Final-Pixel-Offline-Jobs tendieren zu komplexeren Szenen (Volumetrics, Deep-Splat-traced Compositing, Ray-traced Haar und Stoff), während einfachere Shots, die früher Offline-Renderzeit rechtfertigten, in den Echtzeit-Bereich migrieren. Die Offline-render farm im Jahr 2026 ist eine Komplexitäts-Engine, keine Volumen-Engine. Für die Infrastrukturplanung bedeutet das, dass die Kosten pro Frame wichtiger sind als der Nodes-per-second-Durchsatz — behandelt in unserem Leitfaden zu Kosten pro Frame.

KI rückt in das Innere der Pipeline vor

KI in VFX im Jahr 2024 war größtenteils eine Debatte über generative Tools in den Script- und Konzeptphasen. KI in VFX im Jahr 2026 ist eine Pipeline-Realität in mehreren Kategorien, jede auf einem anderen Reifegrad.

KI-Denoising ist Standard. NVIDIA OptiX AI Denoiser und Intel Open Image Denoise (OIDN) sind in jeden gängigen Produktions-Renderer integriert — V-Ray, Arnold, Redshift, Cycles, Karma. Intel OIDN erhielt 2025 einen Technical Achievement Award der Academy of Motion Picture Arts and Sciences, ein nützliches Marktsignal: Die Technologie hat eine Produktionsreife erreicht, die den Academy-Kriterien entspricht. Branchenberichte und aggregierte render-farm-Benchmarks zeigen, dass Szenen, die historisch 2.000–4.000 Samples für ein sauberes Ergebnis benötigten, mit KI-Denoising vergleichbare Qualität bei 200–500 Samples erreichen können. Auf unserer Farm liegt die durchschnittliche Renderzeit-Reduzierung bei Jobs, die KI-Denoising nutzen, gegenüber vergleichbaren Jobs aus 2024, die rein über die Sample-Anzahl konvergierten, im Bereich von 40–60 %, abhängig von Engine und Szenentyp. Die Varianz wird größtenteils durch starke Volumetrics oder aggressives Tiefenunschärfe-Rendering bestimmt, wo KI-Denoiser noch Restfehler hinterlassen, die eine Sicherung durch höhere Sample-Anzahl erfordern.

Generative KI in Previs und Konzept ist die zweite Kategorie. Stable Diffusion XL und Midjourney sind nun Teil der Vorproduktions-Lookdev-Zyklen in mehreren Studios und werden für schnelle Mood-Board-Iterationen vor dem vollständigen 3D-Sculpting eingesetzt. RunwayML und ähnliche Tools übernehmen schnelle Client-Comps. Die Pipeline-Integration ist noch ad-hoc — die meisten Studios betreiben generative KI als parallelen Track statt als eingebettete Phase — aber der Workflow hat sich soweit stabilisiert, dass wir ihn in Client-Briefings sehen.

Image-to-3D und NeRF/Gaussian-Splatting-Rekonstruktion ist die dritte Kategorie — von der Forschungsneugier zum Produktions-Tooling aufgestiegen, im nächsten Abschnitt ausführlich behandelt.

KI für Rotoscoping, Matchmove-Bereinigung und Simulations-Previews ist die am stillsten transformierende Kategorie. Diese mittleren Pipeline-Aufgaben haben historisch unverhältnismäßig viel Zeit von Junior-Artists in Anspruch genommen, und Tools, die sie beschleunigen, verschieben die Studio-Wirtschaftlichkeit, weil sie Stunden freigeben, keine Minuten.

Was KI im Jahr 2026 nicht getan hat, ist das künstlerische Urteil in den Lookdev-, Kompositions- oder direktorialen Review-Phasen zu ersetzen. Das Muster bei Studios, die diese Tools am frühesten übernommen haben, ist, dass die Teamgrößen konstant blieben oder leicht wuchsen, während der Projektdurchsatz pro Artist gestiegen ist. Studios, die Cloud Rendering zusammen mit KI-unterstützten Tools in 2025–2026 eingesetzt haben, berichteten, mehr Projekte im gleichen Zeitrahmen abzuschließen, ohne Köpfe zu reduzieren.

Gaussian Splatting hält Einzug in VFX-Produktionen

Gaussian Splatting — und seine zeitliche Erweiterung, 4D Gaussian Splatting — hat sich schneller von einem Forschungspaper-Novum zu versandtem Produktions-Tooling entwickelt, als die meisten Pipeline-Supervisors erwartet hatten. Die Technik kodiert eine 3D-Szene als Millionen kleiner anisotroper Gaussians statt als polygonale Geometrie plus Texturen; das Ergebnis ist photorealistische visuelle Qualität bei Echtzeit-Rendering-Geschwindigkeiten, wobei Szenen routinemäßig mit 100+ FPS in Unreal Engine rendern.

Anfang 2026 haben Splats First-Class-Unterstützung in der gesamten Produktions-Pipeline: Nuke 17 wird mit nativer Gaussian-Splat-Unterstützung ausgeliefert, Houdini 21 enthält eine technische Vorschau, OpenUSD 26.03 fügte ein erstklassiges Schema hinzu, und V-Ray 7 kann nun Splat-Daten neben traditioneller Geometrie ray-tracen. Die Compositing- und Renderer-Integrationen sind wichtig, weil sie Splats aus „Unreal-only"-Virtual-Production-Inseln in die breitere VFX-Pipeline verschieben.

Der Produktions-Referenzpunkt ist Framestores Arbeit an Superman (2025), bei der das Studio 4D Gaussian Splatting einsetzte, um etwa 40 Final-Pixel-Shots zu liefern. Dies ist der erste weit berichtete Fall, bei dem 4D-Splats Shots übernahmen, die zuvor eine Kombination aus traditioneller Photogrammetrie, Platten-Arbeit und CG-Rekonstruktion erforderten. Andere Studios sind seitdem bei episodischer und ICVFX-Arbeit öffentlich gefolgt.

Der Marktrahmen ist unterstützend. Branchenschätzungen setzen den globalen Virtual-Production-Markt bei rund 2,9 Milliarden USD im Jahr 2025 an, mit Prognosen in Richtung 18,5 Milliarden USD bis 2035, und Gaussian Splatting wird weithin als bevorzugte Methode zur Erstellung der photorealistischen Umgebungen charakterisiert, die LED-Volume-Bühnen antreiben. DJI Terra V5.0+ Flagship verarbeitet Gaussian-Splatting-Rekonstruktionen mit rund 500 Bildern pro Stunde auf Workstation-Hardware; Filmsets erfordern typischerweise 300–1.000+ Bilder von einer DSLR- oder Drohnenkamera. Die Zeit vom Set-Capture zum Asset hat sich für viele Umgebungen von Tagen manueller Erfassung auf unter eine Stunde komprimiert.

Für render farms stellen Splats ein anderes Kosten-pro-Frame-Profil vor. Polygonale Szenen skalieren vorhersehbar mit Sample-Anzahl und Shader-Komplexität; Splat-traced Szenen haben ein Speicherbandbreiten-Profil, das näher am Volumetric-Rendering liegt — VRAM ist wichtiger, und Engines wie V-Ray 7 entwickeln ihre Splat-Tracing-Pfade noch schnell weiter. Wir behandeln sie operativ als eine Job-Klasse, die separates Benchmarking benötigt, nicht als „nur einen weiteren Geometrietyp".

Gaussian-Splatting-Pipeline — Drohnen- oder DSLR-Aufnahme → Rekonstruktion → Unreal Engine Echtzeit-Wiedergabe + V-Ray 7 ray-traced Compositing

OpenUSD als Industrie-Austauschstandard

Pixars Universal Scene Description (USD), 2016 als Open Source freigegeben, ist seit fast einem Jahrzehnt der Kandidat für den langsam entstehenden Standard. Im Jahr 2026 ist „Kandidat" nicht mehr das richtige Wort. Die Alliance for OpenUSD (AOUSD), gegründet von Pixar mit Adobe, Apple, Autodesk und NVIDIA im Jahr 2023, liegt auf Kurs, OpenUSDs grundlegende Spezifikationen bis Ende 2025 zu formalisieren, und SIGGRAPH 2024 demonstrierte OpenUSDs Expansion über traditionelle Medien und Entertainment hinaus in Robotik, Simulation autonomer Fahrzeuge und industrielle Visualisierung.

Das technische Update, das für render-farm-Betreiber am wichtigsten ist, ist die Hinzufügung von Vulkan-Unterstützung zum Hydra Storm-Renderer von OpenUSD (angekündigt in OpenUSD 24.08, beigetragen von Pixar, Autodesk und Adobe unter dem AOUSD-Dach gemäß Khronos-Group-Berichterstattung). HgiVulkan bringt die Hydra-Schnittstelle auf Funktionsparität mit den bestehenden OpenGL- und Metal-Backends und erweitert USD/Hydra auf Android-Mobilgeräte, was ein breiteres Plattformziel erschließt, ohne den bestehenden Mac/Linux/Windows-Footprint zu opfern.

Was das praktisch bedeutet:

- Asset-Austausch zwischen DCCs (Maya, Houdini, Cinema 4D, Blender, 3ds Max) ist erheblich robuster als beim Einsatz von FBX oder per-DCC-Export. Wir sehen Jahr für Jahr weniger „Broken-Transform"-Support-Tickets, da Studios USD als Round-Trip-Format konsolidieren.

- Renderer-übergreifende Interoperabilität verbessert sich — Hydra-Render-Delegates von V-Ray, Karma, Arnold, Cycles und anderen sind zunehmend für interaktives Lookdev und Batch-Rendering geeignet, obwohl die Parität mit der nativen Szenenbeschreibung jedes Renderers Engine-für-Engine variiert.

- Pipeline-Tooling-Investitionen verlagern sich von per-DCC-Importern/Exportern zu USD-nativen Asset-Publishing-Systemen. Studios, die USD-Infrastruktur in 2023–2024 aufgebaut haben, ernten operative Kosteneinsparungen; Studios, die das nicht getan haben, behandeln es als Capex-Priorität für 2026–2027.

OpenUSD löst 2026 nicht jedes Austausch-Problem — Textur- und Material-Übersetzung über Hydra-Delegates bleibt unvollkommen, und per-Renderer-Erweiterungen schaffen Vendor-Lock-Risiken, die OpenUSDs Offenheit eigentlich eliminieren sollte. Der Trend ist jedoch eindeutig: USD ist der Asset-Format-Konsens, den die Branche vor zehn Jahren noch nicht hatte.

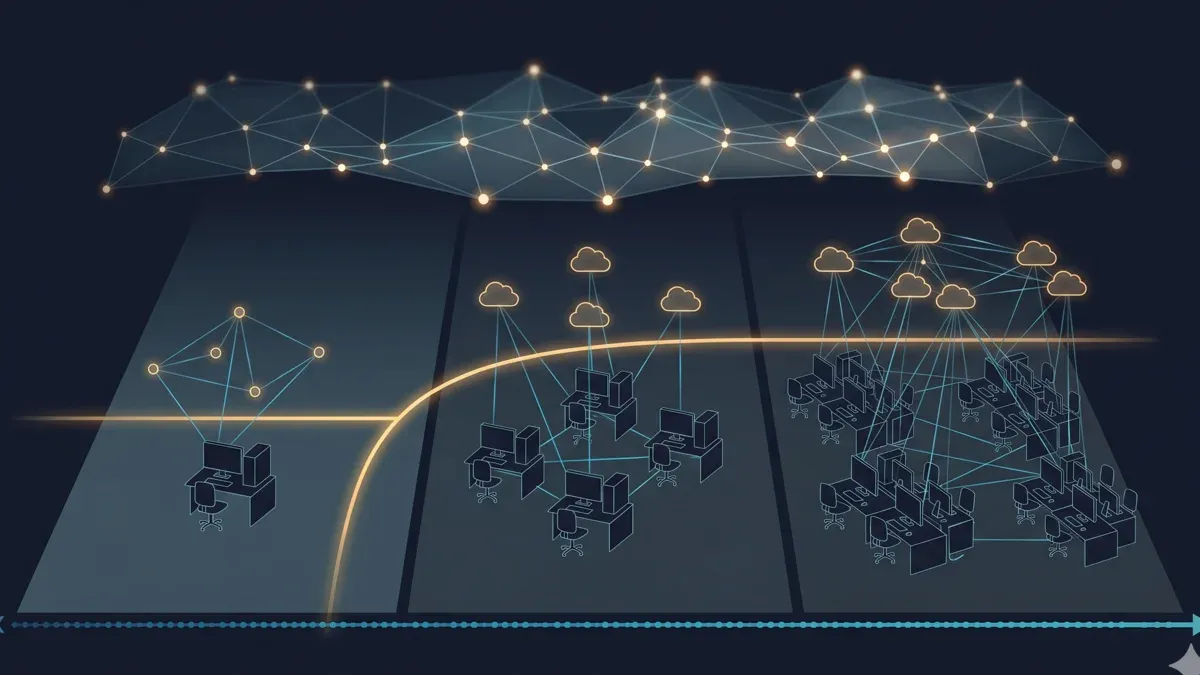

Cloud-Rendering-Wirtschaftlichkeit für Indie- und Mid-Tier-Studios

Die dritte, still transformierende Entwicklung im Jahr 2026 betrifft die Kostenseite. Cloud Rendering wurde 2024 primär als Überlaufkapazität für Studios mit eigenen Render-Walls gerahmt. Im Jahr 2026 ist es die Standard-Infrastruktur für Indie-Teams und einen wachsenden Anteil von Mid-Tier-Studios — nicht als Notfallplan, sondern als Kern ihrer Pipeline.

Drei Kräfte treiben das an:

GPU-Preisvolatilität auf der Hardware-Seite. Die NVIDIA RTX 5090 kam zum UVP von 1.999 USD auf den Markt, aber die tatsächlichen Einzelhandelspreise im Jahr 2026 lagen zwischen 2.500 und 3.800 USD aufgrund von GDDR7-Speicherengpässen und KI-Computing-Nachfrage, die die Verbraucherversorgung verdrängte. Für ein kleines Studio, das einen Acht-GPU-Render-Node aufbaut, hat dieses Delta über die Karten hinaus zuzüglich Mainboard, Netzteil, Kühlung und Rack das Capex-Argument für selbst gehostetes GPU-Computing destabilisiert.

Cloud-GPU-Preiskompression auf der Opex-Seite. Cloud-GPU-Preise sind schneller gesunken als die Einzelhandelskartenpreise, besonders bei Anbietern der zweiten Reihe. Branchenberichte zitieren Thunder Compute mit rund 0,66 USD pro A100 GPU-Stunde gegenüber 4,10 USD bei Tier-1-Clouds. Diese Spanne ist breiter als vor 18 Monaten, was den Infrastruktur-Zugangsabstand zwischen großen und kleinen Studios bei Echtzeit-Iteration und Final-Frame-Durchsatz verringert.

KI-Denoising komprimiert das erforderliche Computing-Volumen. Dies ist der am meisten unterschätzte Faktor. Wenn ein Archviz-Job, der 2023 4.000 Samples benötigte, jetzt mit KI-Denoising 500 braucht, ist die Cloud-Rechnung für diesen Job für die gleiche Qualität rund 8-mal kleiner — was den Cloud-vs.-On-Prem-Gleichgewichtspunkt erheblich verschiebt.

Der Gleichgewichtspunkt existiert weiterhin. Lokale Render-Walls machen bei über 400+ Render-Stunden pro Monat mit konsistentem hohen Volumen wirtschaftlich Sinn, wo die Kosten pro Stunde für eigene Hardware unter Cloud-Preise fallen. Darunter ist die Cloud strukturell günstiger. Die detaillierte Kalkulation haben wir in unserer Build-versus-Cloud-Gesamtkostenanalyse und unserem Preisleitfaden behandelt.

Was 2026 neu ist, ist die Verteilung der Studios auf beiden Seiten dieser Kurve. Die 400-Stunden-Linie trennte früher „Freelance/Indie" von „kleines Studio". Heute trennt sie zunehmend „kleines Studio" von „Mid-Tier", weil mehr kleine Studios zu einem Cloud-first-Stack gewechselt haben. Mid-Tier- und große Studios bauen weiterhin hybride Infrastruktur: eigenes Computing für vorhersehbare Grundlast plus Cloud für Spitzenlasten.

Der operativ wichtigste Hebel ist, ob die gewählte Cloud vollständig verwaltet oder Infrastructure-as-a-Service (IaaS) ist. Die Pipelines sehen oberflächlich ähnlich aus, aber die Artist-Zeit-pro-Job unterscheidet sich erheblich — behandelt in unserer vollständig verwalteten vs. DIY-Analyse.

Auf unserer Farm betreiben wir 20.000+ CPU-Kerne (Dual Intel Xeon E5-2699 V4-Nodes mit 96–256 GB RAM) und eine dedizierte GPU-Flotte aus NVIDIA RTX 5090-Karten mit jeweils 32 GB VRAM, mit Cinema 4D + Redshift, V-Ray, Corona, Arnold, Octane und Cycles, vorinstalliert und auf Plattformebene lizenziert. Als offizieller Chaos-Render-Partner und offizieller Maxon-Partner ist die Lizenzierung für V-Ray, Corona und Redshift eingeschlossen statt nutzerverwaltend. Der Punkt ist nicht das Spezifikationsblatt — sondern dass das operative Modell (kein Remote Desktop, kein Installations-Aufwand, keine License-Server-Konflikte) das ist, was bestimmt, ob Cloud Rendering tatsächlich Artist-Zeit spart, unabhängig vom Anbieter.

Cloud-Rendering-Entscheidungsrahmen für 2026 — Stunden pro Monat vs. Studiogröße vs. Verwaltung-vs.-IaaS-Wahl

Was diese Trends für Studios im Jahr 2026 bedeuten

Die fünf Trends als Gesamtbild statt als fünf separate Geschichten zu lesen, verändert die strategischen Schlussfolgerungen.

Pipeline-Lernen hat sich konvergiert. Vor drei Jahren musste ein TD, der eine Team-Schulung plante, zwischen einer Vertiefung in Maya/Houdini, dem Erlernen von Unreal Engine, dem Aufbau von USD-Tooling oder der Investition in KI-Workflow-Integration wählen. Im Jahr 2026 sind das keine getrennten Wege mehr — ein kompetenter Pipeline-TD braucht praktische Kenntnisse in allen vier Bereichen, und dasselbe gilt für den Senior-Lookdev/Lighting-Artist, dessen Arbeit nun Offline-Path-traced-Finals, Echtzeit-Lookdev und KI-unterstützte Lookdev-Passes umfasst.

Compute-Architektur ist heterogener geworden, nicht weniger. Die Erzählung von 2020 besagte, dass GPU-Rendering CPU-Rendering ersetzen würde. Die Realität 2026 ist, dass CPU noch rund 70 % unseres Render-Job-Mix ausmacht, während GPU den Anteil für Redshift, Octane, V-Ray GPU und Gaussian-Splatting-Arbeit steigert. Ein Hardwareplan, der auf das eine oder andere setzt, wird irgendwo zu klein dimensioniert sein.

Die Offline-render farm hat sich von Volumen zu Komplexität verlagert. Studios, die das mit ihrer Infrastrukturplanung verbinden — Cloud-Burst für Path-traced-Finals bei gleichzeitigem In-House-Betrieb von Echtzeit- und KI-beschleunigter Iteration — profitieren von beiden Schichten. Studios, die jeden Shot entweder durch rein offline oder rein Echtzeit zwingen, zahlen für ein Modell und nutzen das andere.

Indie- und Mid-Tier-Studios haben beim Infrastruktur-Zugang aufgeholt. Die Hürde für die Produktion photorealistischer, komplexer VFX-Arbeit im Jahr 2026 sind zunehmend Fähigkeiten und Pipeline-Reife, nicht GPU-Zugang. Große Studios können sich nicht mehr auf rohen Computing-Vorteil als Burggraben verlassen, und Indie-Studios können mit der operativen Disziplin, die dazu passt, über ihre Hardwareklasse hinauswachsen.

Echtzeit und Offline koexistieren als unterschiedliche Werkzeuge, nicht als Nachfolgemuster. Der Branchendiskurs rahmt Echtzeit oft als den eventuellen Ersatz für Offline; fünf Jahre Evidenz legen nahe, dass das nicht der Verlauf ist. Echtzeit hat die Arbeit, die es besitzt, ausgeweitet; Offline hat die Komplexität, die es besitzt, ausgeweitet; beide wachsen. Planen Sie für kompositorische Heterogenität statt für einen Übergang zu einem einzigen Stack.

FAQ

Q: Was sind die größten VFX-Branchentrends im Jahr 2026? A: Fünf Entwicklungen prägen die Branche: Echtzeit-Rendering, das die Final-Pixel-Schwelle überschreitet (Unreal Engine 5 und Virtual Production), KI, die vom Denoising in Pipeline-interne Aufgaben wie generative Previs und Rotoscoping vorrückt, Gaussian Splatting, das als erstklassiger Asset-Typ in VFX-Produktions-Tools einzieht, OpenUSD, das zum Austauschstandard der Branche heranreift, und Cloud Rendering, das zur Standard-Infrastruktur für Indie- und Mid-Tier-Studios statt zur Überlaufkapazität für große Studios wird.

Q: Wie verändert KI die VFX-Rendering-Pipeline im Jahr 2026? A: KI sitzt 2026 in mehreren Phasen innerhalb der Produktionspipeline. KI-Denoising (OptiX, Intel Open Image Denoise) ist über V-Ray, Arnold, Redshift, Cycles und Karma hinweg Standard und reduziert die erforderliche Sample-Anzahl von rund 2.000–4.000 auf 200–500 für vergleichbare Qualität. Generative KI-Tools wie Stable Diffusion XL und RunwayML sind in Vorproduktions-Lookdev und Client-Comps integriert. Image-to-3D- und Gaussian-Splatting-Rekonstruktion hat sich von der Forschung zum versandten Produktions-Tooling entwickelt. KI-gestütztes Rotoscoping, Matchmove-Bereinigung und Simulations-Previews komprimieren still das mittlere Pipeline-Segment.

Q: Wird Unreal Engine 5 im Jahr 2026 für Final-Pixel-Rendering eingesetzt? A: Ja — Unreal Engine 5's Movie Render Queue liefert Final-Pixel-Shots für In-Camera-VFX auf LED-Volumes, mittelbudgetierte Broadcast- und Werbearbeiten sowie einen wachsenden Anteil an episodischen und Kinoproduktionen. Die Technik wurde von ILMs StageCraft bei The Mandalorian im Jahr 2019 entwickelt und hat sich seitdem auf niedrigere Tier-Produktionen ausgeweitet. Photorealistische Film-Finals-Arbeit, die Path-traced Lichttransport, Deep-EXR-Mehrschicht-Output und Per-Shot-Iterationszyklen erfordert, läuft weiterhin primär auf Offline-Renderern wie V-Ray, Arnold, Redshift und Karma — Echtzeit und Offline schichten sich auf verschiedene Pipeline-Phasen auf, ersetzen sich nicht gegenseitig.

Q: Was ist Gaussian Splatting und warum ist es für VFX im Jahr 2026 wichtig? A: Gaussian Splatting kodiert eine 3D-Szene als Millionen kleiner anisotroper Gaussians statt als polygonale Geometrie plus Texturen und erzeugt photorealistische visuelle Qualität bei Echtzeit-Rendering-Geschwindigkeiten (100+ FPS in Unreal Engine). Anfang 2026 liefert Nuke 17 native Splat-Unterstützung, Houdini 21 enthält eine technische Vorschau, OpenUSD 26.03 fügte ein erstklassiges Schema hinzu, und V-Ray 7 kann Splat-Daten neben traditioneller Geometrie ray-tracen. Framestore verwendete 4D Gaussian Splatting, um etwa 40 Final-Pixel-Shots bei Superman (2025) zu liefern. Die Set-Capture-to-Asset-Zeit hat sich für viele Umgebungen von Tagen auf unter eine Stunde komprimiert.

Q: Wie verändert OpenUSD Studio-Pipelines im Jahr 2026? A: OpenUSD (Universal Scene Description), 2016 von Pixar als Open Source freigegeben, konsolidiert sich zum Austauschstandard der Branche. Die Alliance for OpenUSD — Pixar, Adobe, Apple, Autodesk, NVIDIA, gegründet 2023 — liegt auf Kurs, OpenUSDs grundlegende Spezifikationen bis Ende 2025 zu formalisieren. In OpenUSD 24.08 wurde Vulkan-Unterstützung zum Hydra Storm-Renderer hinzugefügt, was die Plattform auf ein breiteres Gerätespektrum einschließlich Android erweitert. Der Asset-Austausch zwischen Maya, Houdini, Cinema 4D, Blender und 3ds Max ist erheblich robuster als beim Einsatz von FBX, und die Renderer-übergreifende Interoperabilität über Hydra-Render-Delegates verbessert sich von Jahr zu Jahr.

Q: Sollten Indie- und Mid-Tier-Studios im Jahr 2026 Cloud Rendering nutzen? A: Für die meisten Arbeitslasten unter rund 400 Render-Stunden pro Monat mit konsistentem Volumen ist Cloud Rendering strukturell günstiger als eine lokale Render-Wall aufzubauen und zu pflegen — und diese Linie verschiebt sich mit sinkenden Cloud-GPU-Preisen und KI-Denoising, das die erforderliche Sample-Anzahl komprimiert, kontinuierlich nach oben. Der größere Hebel für die Studio-Wirtschaftlichkeit ist, ob die gewählte Cloud vollständig verwaltet ist (kein Remote Desktop, kein Installations-Aufwand, Lizenzierung auf Plattformebene) oder Infrastructure-as-a-Service (IaaS). Über 400 Stunden konsistentes monatliches Volumen hinaus übertreffen hybride Modelle — eigenes Computing für die Grundlast plus Cloud für Spitzen — typischerweise beide Extreme.

Q: Wie haben die Hollywood-Streiks von 2023 die VFX-Branche für den Ausblick 2026 beeinflusst? A: Die WGA- und SAG-AFTRA-Streiks von 2023 reduzierten das vorgelagerte Produktionsvolumen, das den Großteil des Jahres 2024 und Teile des Jahres 2025 in die Pipelines der VFX-Anbieter einfloss. VFX Voice charakterisiert den Einstieg in das Jahr 2026 als Balance zwischen Unsicherheit und Chance — Pipelines füllen sich wieder, angetrieben durch Streaming- und Kinoprojekte, aber freiberufliche und Vertragsbeschäftigung bleibt ungleich verteilt, besonders in den britischen und Vancouver-Clustern, die die schwersten Entlassungen verzeichneten. Mehrere Mid-Tier-Unternehmen haben sich in Virtual-Production-Dienstleistungen oder Immersive-Divisions verlagert, um Einnahmen zu diversifizieren, und haben damit die Käuferzusammensetzung, die render-farm-Betreiber bedienen, strukturell verändert.

Q: Welche Rendering-Hardware sollten Studios für 2026 einplanen? A: Planen Sie für Heterogenität. CPU-Rendering besitzt weiterhin den Großteil des Produktions-Render-Job-Volumens — Archviz mit V-Ray und Corona, Animation mit Arnold und Pipelines, bei denen Speicher-pro-Thread mehr zählt als reine FLOPS — während GPU den Anteil für Redshift, Octane, V-Ray GPU und Gaussian-Splatting-Arbeit steigert. NVIDIA RTX 5090-Einzelhandelspreise lagen 2026 aufgrund von GDDR7-Engpässen und KI-Computing-Nachfrage zwischen 2.500 und 3.800 USD und haben das Capex-Argument für selbst gehostetes GPU-Computing für kleinere Studios destabilisiert. Cloud-GPU-Preise bei Anbietern der zweiten Reihe haben sich erheblich komprimiert (Branchenberichte zitieren rund 0,66 USD pro A100 GPU-Stunde gegenüber 4,10 USD bei Tier-1-Clouds) und verringern den Infrastruktur-Zugangsabstand zwischen großen und kleinen Studios.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.