Tendências da Indústria VFX em 2026: Tempo Real, IA, Gaussian Splatting, OpenUSD e Economia da Nuvem

Visão geral

Introdução

O VFX em 2026 tem uma estrutura fundamentalmente diferente do VFX de 2022. Cinco mudanças estão a remodelar simultaneamente a economia da renderização: os motores de tempo real a cruzar o limiar do pixel final, a IA a passar da eliminação de ruído para o interior do pipeline, o Gaussian Splatting a entrar nas ferramentas de produção como um tipo de ativo de primeira classe, o OpenUSD a consolidar-se como o padrão de intercâmbio da indústria, e a renderização na nuvem a tornar-se o padrão — e não o excedente — para os estúdios fora do topo da hierarquia.

Nos últimos anos temos acompanhado estas tendências a chegarem gradualmente à Super Renders Farm. Já não são experimentais; manifestam-se em trabalhos de longa-metragem concluídos, em lançamentos de ferramentas publicados e na nossa própria composição de trabalhos. Este artigo é um levantamento de tendências da indústria dirigido a decisores de estúdios, técnicos de pipeline (TDs) e artistas a planear onde investir tempo de aprendizagem e orçamento — não é uma comparação de fornecedores, nem um guia de compras.

Tendências da indústria VFX 2026 — convergência de motores de tempo real, denoising por IA, Gaussian Splatting, OpenUSD e renderização na nuvem

Panorama da indústria em 2026

A dimensão do mercado de VFX em 2026 varia consideravelmente consoante o âmbito. A Mordor Intelligence avalia o mercado combinado de animação e VFX em cerca de 220,69 mil milhões USD em 2026, com uma CAGR de 11,86 % até 2031, mas este valor absorve longas-metragens de animação, séries animadas de TV, motion design e visualização. As estimativas de VFX puro são menores e mais disputadas: a Research Nester dimensiona a indústria de efeitos visuais em 27,59 mil milhões USD em 2026; relatórios de âmbito mais restrito situam-se em torno de 13,23 mil milhões USD. O delta metodológico é relevante porque os números de manchete mais elevados absorvem mercados adjacentes que não partilham as estruturas de custos específicas do VFX.

Um valor mais revelador para os estúdios é o da camada de renderização especificamente. Os analistas do setor projetam que o mercado de renderização 3D crescerá de cerca de 4,30 mil milhões USD em 2025 para 13,92 mil milhões USD até 2031 (uma CAGR de ~21,6 %), com a quota da renderização GPU a subir de cerca de 55,8 % em 2024 para ~60 % em 2026. A mudança de composição é o sinal mais claro nos dados: a camada de renderização está a crescer mais depressa do que o mercado VFX que a contém, e dentro dessa camada a quota GPU é a componente com maior crescimento composto.

A segunda variável é a recuperação pós-greve. As greves da WGA e da SAG-AFTRA em 2023 reduziram o volume de produção upstream que fluiu para os pipelines dos fornecedores de VFX durante grande parte de 2024 e parte de 2025. A VFX Voice (o jornal da Visual Effects Society) caracteriza a entrada em 2026 como um equilíbrio entre incerteza e oportunidade — os pipelines estão a encher novamente, mas o emprego freelance mantém-se irregular. A terceira variável é a consolidação do segmento médio: várias instalações pivotaram para serviços de produção virtual ou divisões imersivas durante a recessão, alterando a composição de compradores do lado das render farms.

A renderização em tempo real cruza o limiar do pixel final

A grande história do tempo real em 2026 é que a fronteira entre "tempo real para previs" e "offline para pixel final" deixou de existir como barreira. A VFX Voice e os órgãos de cobertura do NAB Show 2025 caracterizam a renderização em tempo real próxima como uma das mudanças tecnológicas mais consequentes da indústria — a par da geração de imagens assistida por IA — porque altera quais os trabalhos que precisam de ser colocados em fila e quais podem ser revistos em direto.

O Unreal Engine 5, com geometria virtualizada Nanite e iluminação global Lumen, é o extremo visível dessa mudança. A técnica não é nova — o StageCraft da ILM renderizou The Mandalorian em Unreal Engine a partir de 2019 para filmar ambientes diversificados num único estúdio — mas em 2026 a mesma abordagem está a atingir produções de segundo nível e trabalho de broadcast, e não apenas séries de streaming de topo de orçamento. A cobertura do NAB Show 2025 (ProductionHUB, VP-Land, Nitro Media Group) colocou a produção virtual no centro do evento pelo terceiro ano consecutivo, com a Sony a apresentar o sistema de rastreamento de câmara sem marcadores Ocellus e ferramentas de compensação de cor fora do eixo Crystal LED que reduzem materialmente o custo de operar um volume LED.

A implicação económica não é que a renderização offline desapareça — é que o volume de trabalho que se qualifica para o tempo real aumentou. As placas de fundo para VFX em câmara (ICVFX) em palcos LED são trabalho em tempo real. Previs e postvis são trabalho em tempo real. Cada vez mais, planos de herói completos em comerciais de médio orçamento e peças de broadcast estão também a ser entregues através da Movie Render Queue do Unreal Engine 5.

O que fica offline em 2026 é o trabalho de finais de filme fotorrealistas em que o transporte de luz por path tracing, a saída multi-camada deep-EXR e os ciclos de iteração artística por plano permanecem dominantes. V-Ray, Arnold, Redshift e Karma continuam todos a evoluir no lado offline: o V-Ray 7 adicionou suporte de Gaussian Splat com ray tracing (ver secção seguinte), o Karma XPU continua a amadurecer, e os lançamentos do Redshift em 2026 focaram-se em volumétricos e complexidade de shaders. Estes motores e a pilha de tempo real já não estão em competição de soma zero; estão a acumular-se em diferentes fases do pipeline.

Do lado da render farm, o crescimento do tempo real não reduziu visivelmente os volumes de renderização offline — alterou a sua composição. Os trabalhos finais de pixel offline tendem para cenas de maior complexidade (volumétricos, composição com splat traçado em profundidade, cabelo e roupa com ray tracing), enquanto planos mais simples que antes justificavam tempo de renderização offline estão a migrar para o tempo real. A render farm offline de 2026 é um motor de complexidade, não um motor de volume. Para o planeamento de infraestruturas, isso significa que o custo por frame importa mais do que o throughput de nós por segundo — abordado no nosso guia de custo por frame.

A IA move-se para o interior do pipeline

A IA no VFX em 2024 era sobretudo um debate sobre ferramentas generativas nas fases de argumento e conceito. A IA no VFX em 2026 é uma realidade no interior do pipeline em várias categorias, cada uma a um nível de maturidade diferente.

O denoising por IA é um requisito básico. O NVIDIA OptiX AI Denoiser e o Intel Open Image Denoise (OIDN) estão integrados em todos os motores de produção principais — V-Ray, Arnold, Redshift, Cycles, Karma. O Intel OIDN recebeu um Prémio de Realização Técnica da Academy of Motion Picture Arts and Sciences em 2025, um sinal de mercado útil: a tecnologia atingiu uma escala de produção que satisfaz os critérios da Academia. Relatórios da indústria e benchmarks agregados de render farms indicam que cenas que historicamente exigiam 2.000–4.000 amostras para uma saída limpa podem atingir qualidade comparável com 200–500 amostras com denoising por IA. Na nossa render farm, a redução média do tempo de renderização em trabalhos que utilizam denoising por IA face a trabalhos equivalentes de 2024 que convergiam exclusivamente por contagem de amostras situa-se entre 40–60 %, dependendo do motor e do tipo de cena. A variância é maioritariamente determinada por volumétricos intensos ou profundidade de campo agressiva, onde os denoisers de IA ainda deixam artefactos residuais que requerem um reforço por contagem de amostras.

A IA generativa em previs e conceito é a segunda categoria. O Stable Diffusion XL e o Midjourney fazem agora parte dos ciclos de lookdev de pré-produção em múltiplos estúdios, utilizados para iteração rápida de mood boards antes da escultura 3D completa. O RunwayML e ferramentas similares tratam de composições rápidas para clientes. A integração no pipeline ainda é improvisada — a maioria dos estúdios executa a IA generativa como uma via paralela em vez de uma fase incorporada — mas o fluxo de trabalho estabilizou o suficiente para o vermos referenciado nos briefings de clientes que recebemos.

A reconstrução de imagem para 3D e NeRF/Gaussian Splatting é a terceira categoria — passou de curiosidade de investigação para ferramentas de produção, abordada em detalhe na secção seguinte.

A IA para rotoscopia, limpeza de matchmove e pré-visualizações de simulação é a categoria mais silenciosamente transformadora. Estas tarefas a meio do pipeline consumiam historicamente uma proporção desproporcionada do tempo de artistas juniores, e as ferramentas que as aceleram alteram a economia dos estúdios porque libertam horas, não minutos.

O que a IA em 2026 não fez foi substituir o julgamento artístico nas fases de lookdev, composição ou revisão diretorial. O padrão nos estúdios que adotaram estas ferramentas mais cedo é que as dimensões das equipas se mantiveram constantes ou cresceram ligeiramente, enquanto o throughput de projetos por artista aumentou. Os estúdios que adotaram renderização na nuvem a par de ferramentas assistidas por IA em 2025–2026 relataram concluir mais projetos no mesmo período sem reduzir o número de colaboradores.

O Gaussian Splatting entra no VFX de produção

O Gaussian Splatting — e a sua extensão temporal, o 4D Gaussian Splatting — passou de novidade em artigos de investigação para ferramentas de produção lançadas mais depressa do que a maioria dos supervisores de pipeline esperava. A técnica codifica uma cena 3D como milhões de pequenos Gaussianos anisotrópicos em vez de geometria poligonal e texturas; o resultado é uma qualidade visual fotorrealista a velocidades de renderização em tempo real, com cenas a renderizar rotineiramente acima de 100 FPS no Unreal Engine.

No início de 2026, os splats têm suporte de primeira classe em toda a pilha de produção: o Nuke 17 inclui suporte nativo de Gaussian Splat, o Houdini 21 inclui uma pré-visualização técnica, o OpenUSD 26.03 adicionou um schema de primeira classe, e o V-Ray 7 já consegue traçar dados de splat com ray tracing a par de geometria tradicional. As integrações de compositing e de motor são importantes porque movem os splats de "ilhas de produção virtual exclusivas do Unreal" para o pipeline VFX mais abrangente.

O ponto de referência de produção é o trabalho da Framestore em Superman (2025), em que o estúdio utilizou 4D Gaussian Splatting para entregar aproximadamente 40 planos de pixel final. É o primeiro caso amplamente relatado em que os splats 4D trataram de planos que anteriormente exigiam uma combinação de fotogrametria tradicional, trabalho de placa e reconstrução CG. Outros estúdios seguiram publicamente em trabalho episódico e ICVFX.

O contexto de mercado é favorável. As estimativas do setor situam o mercado global de produção virtual em aproximadamente 2,9 mil milhões USD em 2025, com projeções para 18,5 mil milhões USD até 2035, e o Gaussian Splatting é amplamente caracterizado como um método preferido para criar os ambientes fotorrealistas que alimentam os palcos de volume LED. O DJI Terra V5.0+ Flagship processa reconstruções de Gaussian Splatting a cerca de 500 imagens por hora em hardware de estação de trabalho; conjuntos de qualidade cinematográfica exigem tipicamente 300–1.000+ imagens de uma DSLR ou drone. O tempo de captura no set até ao ativo passou de dias de digitalização manual para menos de uma hora para muitos ambientes.

Para as render farms, os splats introduzem um perfil de custo por frame diferente. As cenas poligonais escalam previsivelmente com a contagem de amostras e a complexidade dos shaders; as cenas com splat tracing têm um perfil de largura de banda de memória mais próximo da renderização volumétrica — a VRAM importa mais, e motores como o V-Ray 7 ainda estão a evoluir rapidamente os seus percursos de splat tracing. Tratamo-lo operacionalmente como uma classe de trabalho que necessita de benchmarking separado, e não como "apenas mais um tipo de geometria".

Pipeline de Gaussian Splatting — captura por drone ou DSLR → reconstrução → reprodução em tempo real no Unreal Engine + compositing com ray tracing V-Ray 7

OpenUSD como padrão de intercâmbio da indústria

O Universal Scene Description (USD) da Pixar, tornado open-source em 2016, tem sido o candidato a padrão de referência durante quase uma década. Em 2026, "candidato" já não é a palavra certa. A Alliance for OpenUSD (AOUSD), formada pela Pixar com a Adobe, a Apple, a Autodesk e a NVIDIA em 2023, está no caminho de formalizar as especificações fundacionais do OpenUSD até ao final de 2025, e o SIGGRAPH 2024 demonstrou a expansão do OpenUSD para além dos meios de comunicação e entretenimento tradicionais para a robótica, a simulação de veículos autónomos e a visualização industrial.

A atualização técnica mais relevante para os operadores de render farms é a adição de suporte Vulkan ao motor de renderização Hydra Storm do OpenUSD (anunciada no OpenUSD 24.08, contribuída pela Pixar, Autodesk e Adobe sob o âmbito da AOUSD, de acordo com os relatórios do Khronos Group). O HgiVulkan coloca a interface Hydra em paridade de funcionalidades com os backends OpenGL e Metal existentes e estende o USD/Hydra a dispositivos Android, abrindo um leque de plataformas mais amplo sem sacrificar a plataforma existente Mac/Linux/Windows.

O que isto significa na prática:

- O intercâmbio de ativos entre DCCs (Maya, Houdini, Cinema 4D, Blender, 3ds Max) é materialmente menos frágil do que quando se depende de FBX ou exportação por DCC. Observamos menos tickets de suporte de "transformação quebrada" de ano para ano à medida que os estúdios consolidam o USD como formato de ida e volta.

- A interoperabilidade entre motores está a melhorar — os delegados de renderização Hydra do V-Ray, Karma, Arnold, Cycles e outros são cada vez mais viáveis tanto para lookdev interativo como para renderização em lote, embora a paridade com a descrição de cena nativa de cada motor varie de motor para motor.

- O investimento em ferramentas de pipeline está a passar de importadores/exportadores por DCC para sistemas de publicação de ativos nativos em USD. Os estúdios que construíram infraestrutura USD em 2023–2024 estão a colher poupanças de custos operacionais; os que ainda não o fizeram estão a tratá-lo como uma prioridade de capex para 2026–2027.

O OpenUSD não resolve todos os problemas de intercâmbio em 2026 — a tradução de texturas e materiais entre delegados Hydra continua imperfeita, e as extensões por motor criam riscos de dependência de fornecedor que a abertura do USD pretendia eliminar. A tendência é inequívoca, porém: o USD é o consenso de formato de ativos que a indústria não tinha há dez anos.

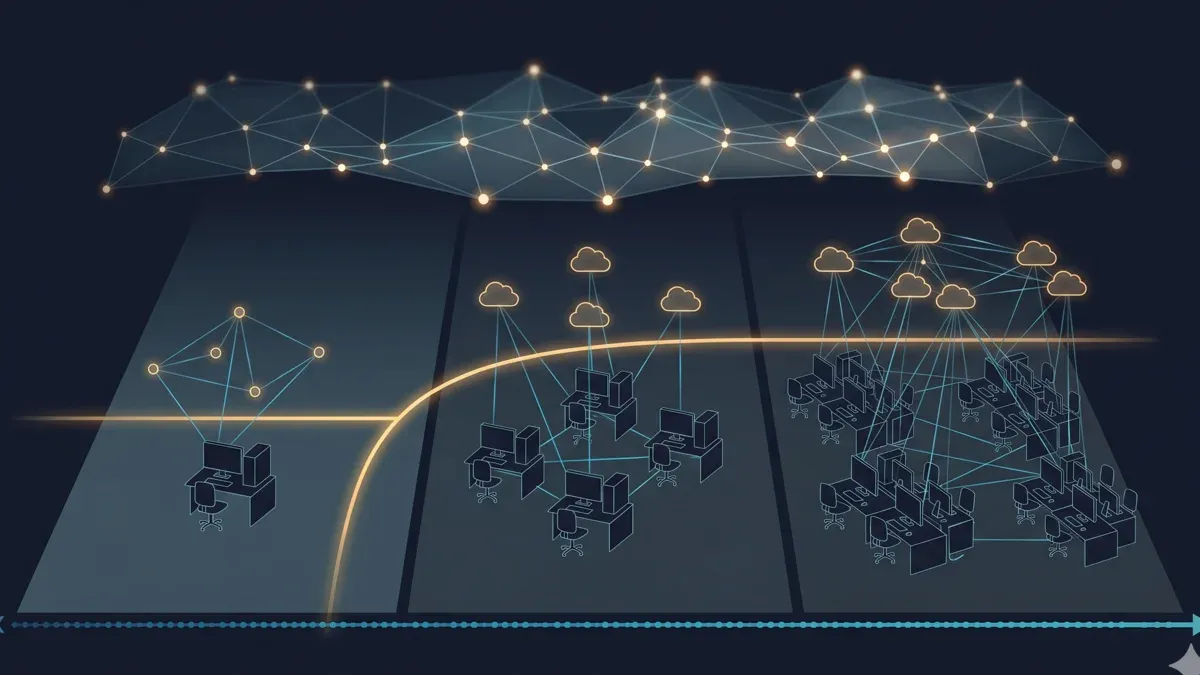

Economia da renderização na nuvem para estúdios independentes e de médio porte

A terceira mudança silenciosamente transformadora de 2026 é do lado dos custos. A renderização na nuvem em 2024 era enquadrada principalmente como capacidade de excedente para estúdios com as suas próprias render walls. Em 2026, é a infraestrutura padrão para equipas independentes e uma quota crescente de estúdios de médio porte — não como plano de contingência, mas como núcleo do seu pipeline.

Três forças impulsionam esta tendência:

A volatilidade dos preços das GPUs do lado do hardware. A NVIDIA RTX 5090 foi lançada a um preço de tabela de 1.999 USD, mas os preços reais de retalho em 2026 têm variado entre 2.500–3.800 USD devido a escassez de memória GDDR7 e procura de computação para IA a deslocar a oferta para consumidores. Para um estúdio pequeno a construir um nó de renderização de oito GPUs, esse delta multiplicado pelas placas mais placa-mãe, PSU, arrefecimento e rack desestabilizou a argumentação de capex para computação GPU auto-alojada.

A compressão de preços de GPU na nuvem do lado do opex. Os preços de GPU na nuvem caíram mais depressa do que os preços das placas de retalho, particularmente nos fornecedores de segundo nível. A cobertura da indústria cita a Thunder Compute a cerca de 0,66 USD por hora-GPU A100 face a 4,10 USD nos fornecedores de primeiro nível. Essa diferença é maior do que há 18 meses atrás, reduzindo a lacuna de acesso à infraestrutura entre estúdios grandes e pequenos.

O denoising por IA a comprimir o volume de computação necessário. Este é o fator menos reconhecido. Se um trabalho de visualização arquitetónica que necessitava de 4.000 amostras em 2023 agora precisa de 500 com denoising por IA, a fatura de nuvem para esse trabalho é cerca de 8× menor para a mesma qualidade — o que altera materialmente o ponto de equilíbrio nuvem versus instalações próprias.

O ponto de equilíbrio ainda existe. As render walls locais fazem sentido económico acima de cerca de 400+ horas de renderização por mês de volume consistente e elevado, onde o custo por hora do hardware próprio fica abaixo das tarifas da nuvem. Abaixo disso, a nuvem é estruturalmente mais barata. Abordámos a matemática detalhada na nossa análise de custo total entre construir versus nuvem e no nosso guia de preços.

O que há de novo em 2026 é a distribuição dos estúdios de cada lado dessa curva. A linha das 400 horas costumava separar "freelance/independente" de "estúdio pequeno". Agora separa cada vez mais "estúdio pequeno" de "médio porte" porque mais estúdios pequenos migraram para uma pilha com prioridade na nuvem. Os estúdios de médio e grande porte ainda constroem infraestruturas híbridas: computação própria para a linha de base previsível mais nuvem para picos.

O alavancador operacional mais importante é se a nuvem escolhida é totalmente gerida ou Infrastructure-as-a-Service (IaaS). Os pipelines parecem superficialmente semelhantes, mas o tempo de artista por trabalho difere materialmente — abordado na nossa análise de render farm totalmente gerida versus DIY.

Na nossa render farm, operamos mais de 20.000 núcleos de CPU (nós Dual Intel Xeon E5-2699 V4 com 96–256 GB de RAM) e uma frota de GPU dedicada de placas NVIDIA RTX 5090 com 32 GB de VRAM cada, com Cinema 4D + Redshift, V-Ray, Corona, Arnold, Octane e Cycles pré-instalados e licenciados ao nível da plataforma. Enquanto parceiro oficial de renderização da Chaos e parceiro oficial da Maxon, o licenciamento de V-Ray, Corona e Redshift está incluído e não é gerido pelo utilizador. O ponto não é a folha de especificações — é que o modelo operacional (sem ambiente de trabalho remoto, sem instalação de software, sem contenção de servidor de licenças) é o que determina se a renderização na nuvem poupa efetivamente tempo de artista, independentemente do fornecedor.

Estrutura de decisão de renderização na nuvem para 2026 — horas por mês versus dimensão do estúdio versus escolha gerida versus IaaS

O que estas tendências significam para os estúdios em 2026

Ler as cinco tendências como uma imagem única em vez de cinco histórias separadas altera as conclusões estratégicas.

A aprendizagem de pipeline convergiu. Há três anos, um TD a planear a formação da equipa tinha de escolher entre aprofundar Maya/Houdini, aprender Unreal Engine, construir ferramentas USD ou investir na integração de fluxos de trabalho de IA. Em 2026, estes já não são caminhos distintos — um TD de pipeline competente precisa de fluência funcional em todos os quatro, e o mesmo se aplica ao artista sénior de lookdev/iluminação cujo trabalho abrange agora finais de path tracing offline, lookdev em tempo real e passes de lookdev assistidos por IA.

A arquitetura de computação tornou-se mais heterogénea, não menos. A narrativa de 2020 dizia que a renderização GPU substituiria a renderização CPU. A realidade de 2026 é que a CPU ainda detém cerca de 70 % da nossa composição de trabalhos de renderização, enquanto a GPU cresce em quota para trabalhos em Redshift, Octane, V-Ray GPU e Gaussian Splatting. Um plano de hardware que assuma um ou outro estará subdimensionado nalgum ponto.

A render farm offline passou do volume para a complexidade. Os estúdios que articulam isso com o planeamento de infraestruturas — pico na nuvem para finais de path tracing enquanto executam iteração em tempo real e assistida por IA internamente — obtêm o benefício de ambas as camadas. Os estúdios que tentam forçar todos os planos por via exclusivamente offline ou exclusivamente em tempo real acabam por pagar por um modelo e usar o outro.

Os estúdios independentes e de médio porte alcançaram o acesso à infraestrutura. A barreira para produzir trabalho VFX fotorrealista e complexo em 2026 é cada vez mais a competência e a maturidade do pipeline, não o acesso às GPUs. As grandes instalações já não podem contar com a vantagem de computação bruta como fosso de proteção, e os estúdios independentes podem competir acima do seu peso de hardware com a disciplina operacional adequada.

O tempo real e o offline coexistem como ferramentas diferentes, não como padrão de sucessão. O discurso da indústria enquadra frequentemente o tempo real como o eventual substituto do offline; cinco anos de evidências sugerem que não é essa a trajetória. O tempo real expandiu o trabalho que detém; o offline expandiu a complexidade que detém; ambos estão a crescer. Planeie para heterogeneidade composicional em vez de transição para uma única pilha.

FAQ

Q: Quais são as maiores tendências da indústria VFX em 2026? A: Cinco mudanças estão a remodelar a indústria: a renderização em tempo real a cruzar o limiar do pixel final (Unreal Engine 5 e produção virtual), a IA a passar do denoising para tarefas no interior do pipeline como previs generativo e rotoscopia, o Gaussian Splatting a entrar nas ferramentas VFX de produção como tipo de ativo de primeira classe, o OpenUSD a consolidar-se como padrão de intercâmbio da indústria, e a renderização na nuvem a tornar-se infraestrutura padrão para estúdios independentes e de médio porte em vez de capacidade de excedente para os grandes.

Q: Como está a IA a transformar o pipeline de renderização VFX em 2026? A: A IA em 2026 situa-se no interior do pipeline de produção em múltiplas fases. O denoising por IA (OptiX, Intel Open Image Denoise) é padrão em V-Ray, Arnold, Redshift, Cycles e Karma, reduzindo as contagens de amostras necessárias de cerca de 2.000–4.000 para 200–500 com qualidade comparável. Ferramentas de IA generativa como o Stable Diffusion XL e o RunwayML estão integradas no lookdev de pré-produção e em composições para clientes. A reconstrução de imagem para 3D e Gaussian Splatting passou da investigação para ferramentas de produção lançadas. A rotoscopia assistida por IA, a limpeza de matchmove e as pré-visualizações de simulação estão silenciosamente a comprimir a parte intermédia do pipeline.

Q: O Unreal Engine 5 é utilizado para renderização de pixel final em 2026? A: Sim — a Movie Render Queue do Unreal Engine 5 está a entregar planos de pixel final para VFX em câmara em volumes LED, trabalho de broadcast e comerciais de médio orçamento, e uma quota crescente de conteúdo episódico e teatral. A técnica foi pioneirizada pelo StageCraft da ILM em The Mandalorian em 2019 e tem escalado para baixo desde então. O trabalho de finais de filme fotorrealistas que exige transporte de luz por path tracing, saída multi-camada deep-EXR e ciclos de iteração por plano ainda corre principalmente em motores offline como V-Ray, Arnold, Redshift e Karma — o tempo real e o offline estão a acumular-se em diferentes fases do pipeline, não a substituir-se mutuamente.

Q: O que é o Gaussian Splatting e porque é que importa para o VFX em 2026? A: O Gaussian Splatting codifica uma cena 3D como milhões de pequenos Gaussianos anisotrópicos em vez de geometria poligonal e texturas, produzindo qualidade visual fotorrealista a velocidades de renderização em tempo real (acima de 100 FPS no Unreal Engine). No início de 2026, o Nuke 17 inclui suporte nativo de splat, o Houdini 21 inclui uma pré-visualização técnica, o OpenUSD 26.03 adicionou um schema de primeira classe, e o V-Ray 7 consegue traçar dados de splat com ray tracing a par de geometria tradicional. A Framestore utilizou 4D Gaussian Splatting para entregar aproximadamente 40 planos de pixel final em Superman (2025). O tempo de captura no set até ao ativo passou de dias para menos de uma hora para muitos ambientes.

Q: Como está o OpenUSD a transformar os pipelines dos estúdios em 2026? A: O OpenUSD (Universal Scene Description), tornado open-source pela Pixar em 2016, está a consolidar-se como padrão de intercâmbio da indústria. A Alliance for OpenUSD — Pixar, Adobe, Apple, Autodesk, NVIDIA, formada em 2023 — está no caminho de formalizar as especificações fundacionais do OpenUSD até ao final de 2025. O suporte Vulkan foi adicionado ao motor de renderização Hydra Storm no OpenUSD 24.08, alargando a plataforma a um leque mais amplo de dispositivos incluindo Android. O intercâmbio de ativos entre Maya, Houdini, Cinema 4D, Blender e 3ds Max é materialmente menos frágil do que confiar em FBX, e a interoperabilidade entre motores via delegados de renderização Hydra está a melhorar de ano para ano.

Q: Os estúdios independentes e de médio porte devem utilizar renderização na nuvem em 2026? A: Para a maioria dos trabalhos abaixo de cerca de 400 horas de renderização por mês de volume consistente, a renderização na nuvem é estruturalmente mais barata do que construir e manter uma render wall local — e essa linha continua a subir à medida que os preços de GPU na nuvem caem e o denoising por IA comprime as contagens de amostras necessárias. O maior alavancador para a economia dos estúdios é se a nuvem escolhida é totalmente gerida (sem ambiente de trabalho remoto, sem instalação de software, licenciamento tratado ao nível da plataforma) ou Infrastructure-as-a-Service (IaaS). Acima de 400 horas de volume mensal consistente, os modelos híbridos — computação própria para a linha de base mais nuvem para picos — superam tipicamente qualquer um dos extremos.

Q: Como afetaram as greves de Hollywood de 2023 as perspetivas da indústria VFX para 2026? A: As greves da WGA e da SAG-AFTRA em 2023 reduziram o volume de produção upstream que fluiu para os pipelines dos fornecedores de VFX durante grande parte de 2024 e parte de 2025. A VFX Voice caracteriza a entrada em 2026 como um equilíbrio entre incerteza e oportunidade — os pipelines estão a encher novamente impulsionados por projetos de streaming e teatrais, mas o emprego freelance e por contrato mantém-se irregular, particularmente nos clusters do Reino Unido e de Vancouver que absorveram os despedimentos mais pesados. Várias instalações de médio porte pivotaram para serviços de produção virtual ou divisões imersivas para diversificar a receita, alterando estruturalmente a composição de compradores que os operadores de render farms servem.

Q: Que hardware de renderização devem os estúdios planear para 2026? A: Planeie para heterogeneidade. A renderização CPU ainda detém a maioria do volume de trabalhos de renderização de produção — visualização arquitetónica com V-Ray e Corona, animação com Arnold, e pipelines em que a memória por thread importa mais do que FLOPS brutos — enquanto a GPU cresce em quota para trabalhos em Redshift, Octane, V-Ray GPU e Gaussian Splatting. Os preços de retalho da NVIDIA RTX 5090 variaram entre 2.500–3.800 USD em 2026 devido a escassez de GDDR7 e procura de computação para IA, desestabilizando a argumentação de capex para computação GPU auto-alojada em estúdios mais pequenos. Os preços de GPU na nuvem nos fornecedores de segundo nível comprimiram significativamente (a cobertura da indústria cita cerca de 0,66 USD por hora-GPU A100 face a 4,10 USD nos fornecedores de primeiro nível), reduzindo a lacuna de acesso à infraestrutura entre estúdios grandes e pequenos.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.