Tendenze del settore VFX nel 2026: Real-Time, AI, Gaussian Splatting, OpenUSD e cloud economics

Panoramica

Introduzione

Il VFX nel 2026 ha una struttura profondamente diversa da quello del 2022. Cinque cambiamenti stanno ridisegnando contemporaneamente l'economia del rendering: i motori in tempo reale che attraversano la soglia del final-pixel, l'AI che passa dal denoising all'interno della pipeline, il Gaussian Splatting che entra negli strumenti di produzione come tipo di asset di prima classe, OpenUSD che si consolida come standard di interscambio del settore, e il cloud rendering che diventa l'infrastruttura predefinita — non più di riserva — per gli studi al di fuori del livello apicale.

Negli ultimi anni abbiamo osservato l'arrivo di queste tendenze in modo frammentato presso Super Renders Farm. Non sono più sperimentali: emergono in lavori di produzione consegnati, in rilasci di strumenti pubblicati e nel nostro stesso mix di commesse. Questo articolo è un'analisi delle tendenze del settore rivolta a responsabili decisionali di studio, pipeline TD e artisti che pianificano dove investire tempo di formazione e budget — non un confronto tra fornitori, non una guida all'acquisto.

Tendenze del settore VFX 2026 — convergenza di motori in tempo reale, AI denoising, Gaussian Splatting, OpenUSD e cloud rendering

Il quadro del settore nel 2026

Le stime delle dimensioni del mercato VFX nel 2026 variano notevolmente in base all'ambito considerato. Mordor Intelligence valuta il mercato combinato di animazione e VFX a circa 220,69 miliardi di USD nel 2026, con un CAGR dell'11,86% fino al 2031, ma quella cifra include film d'animazione, serie animate, motion design e visualizzazione. Le stime esclusivamente VFX sono più contenute e più controverse: Research Nester dimensiona il settore degli effetti visivi a 27,59 miliardi di USD nel 2026; report di ambito più ristretto si attestano attorno a 13,23 miliardi di USD. Il divario metodologico è rilevante perché i titolari delle cifre più grandi assorbono mercati adiacenti che non condividono le strutture di costo specifiche del VFX.

Un dato più significativo per gli studi è il segmento del rendering specificamente. Gli analisti del settore proiettano il mercato del rendering 3D in crescita da circa 4,30 miliardi di USD nel 2025 a 13,92 miliardi di USD entro il 2031 (un CAGR di circa il 21,6%), con la quota del rendering GPU che sale da circa il 55,8% nel 2024 a circa il 60% entro il 2026. Lo spostamento del mix è il segnale più chiaro nei dati: il segmento del rendering cresce più rapidamente del mercato VFX che lo contiene, e all'interno di quel segmento è la quota GPU a crescere in modo composto.

La seconda variabile è la ripresa post-sciopero. Gli scioperi WGA e SAG-AFTRA del 2023 hanno ridotto il volume di produzione a monte che confluiva a valle nelle pipeline dei fornitori VFX nel corso di gran parte del 2024 e di parte del 2025. VFX Voice (la rivista della Visual Effects Society) descrive l'ingresso nel 2026 come un equilibrio tra incertezza e opportunità — le pipeline si stanno riempiendo nuovamente, ma l'occupazione freelance rimane irregolare. La terza variabile è il consolidamento del segmento medio: diverse strutture hanno virato verso servizi di virtual production o divisioni immersive durante il periodo di contrazione, modificando la composizione degli acquirenti sul lato delle render farm.

Il rendering in tempo reale supera la soglia del final-pixel

La notizia principale sul fronte del tempo reale nel 2026 è che il muro tra "real-time per il previs" e "offline per il pixel finale" ha cessato di essere un muro. VFX Voice e le testate che hanno coperto il NAB Show 2025 descrivono il rendering quasi in tempo reale come uno degli spostamenti tecnologici più rilevanti del settore — insieme alla generazione di immagini assistita da AI — perché cambia quali lavori devono essere accodati e quali possono essere revisionati in diretta.

Unreal Engine 5, con la geometria virtualizzata Nanite e l'illuminazione globale Lumen, è la manifestazione visibile di questo cambiamento. La tecnica non è nuova — lo StageCraft di ILM ha reso The Mandalorian in Unreal Engine a partire dal 2019 per girare ambienti diversi in un unico palcoscenico — ma nel 2026 lo stesso approccio raggiunge le produzioni di secondo livello e il lavoro broadcast, non solo le serie streaming con budget massimi. La copertura del NAB Show 2025 (ProductionHUB, VP-Land, Nitro Media Group) ha posto la virtual production al centro della manifestazione per il terzo anno consecutivo, con Sony che ha introdotto il sistema di tracking delle telecamere marker-free Ocellus e gli strumenti di compensazione del colore fuori asse Crystal LED, che riducono materialmente il costo di gestione di un volume LED.

L'implicazione economica non è che il rendering offline scompaia — è che il volume di lavoro che si qualifica per il tempo reale si è espanso. I backing plate per gli in-camera VFX (ICVFX) su palcoscenici LED sono lavoro in tempo reale. Il previs e il postvis sono lavoro in tempo reale. In misura crescente, anche i full hero shot in spot commerciali e pezzi broadcast a budget medio vengono consegnati tramite il Movie Render Queue di Unreal Engine 5.

Ciò che rimane offline nel 2026 è il lavoro di final-pixel cinematografico fotorealistico, dove il light transport path-traced, l'output multi-layer deep-EXR e i cicli di iterazione per shot degli artisti rimangono dominanti. V-Ray, Arnold, Redshift e Karma continuano a evolversi sul lato offline: V-Ray 7 ha aggiunto il supporto Gaussian Splat ray-traceable (si veda la sezione successiva), Karma XPU continua a maturare, e i rilasci Redshift del 2026 si sono concentrati sui volumetrici e sulla complessità degli shader. Questi motori e lo stack in tempo reale non sono più in competizione a somma zero; si stratificano su fasi diverse della pipeline.

Sul lato delle render farm, la crescita del tempo reale non ha ridotto visibilmente i volumi di rendering offline — ne ha cambiato la composizione. I lavori offline final-pixel tendono verso scene di maggiore complessità (volumetrici, compositing splat-traced in profondità, hair e cloth ray-traced) mentre i shot più semplici che un tempo giustificavano il tempo di rendering offline stanno migrando verso il tempo reale. La render farm offline nel 2026 è un motore di complessità, non di volume. Per la pianificazione dell'infrastruttura, ciò significa che il costo per frame conta più della velocità effettiva in nodi al secondo — argomento trattato nella nostra guida al costo per frame.

L'AI si sposta all'interno della pipeline

L'AI nel VFX nel 2024 era principalmente un dibattito sugli strumenti generativi nelle fasi di script e concept. L'AI nel VFX nel 2026 è una realtà all'interno della pipeline in diverse categorie, ciascuna a un diverso livello di maturità.

L'AI denoising è lo standard di riferimento. NVIDIA OptiX AI Denoiser e Intel Open Image Denoise (OIDN) sono integrati in ogni motore di rendering di produzione principale — V-Ray, Arnold, Redshift, Cycles, Karma. Intel OIDN ha ricevuto un Technical Achievement Award dall'Academy of Motion Picture Arts and Sciences nel 2025, segnale di mercato significativo: la tecnologia ha raggiunto una scala di produzione che soddisfa i criteri dell'Academy. I report del settore e i benchmark aggregati delle render farm indicano che le scene che storicamente richiedevano da 2.000 a 4.000 campioni per un output pulito possono raggiungere una qualità comparabile con 200–500 campioni grazie all'AI denoising. Sulla nostra farm, la riduzione media del tempo di rendering sui lavori che sfruttano l'AI denoising rispetto a lavori equivalenti del 2024 che convergevano esclusivamente tramite conteggio dei campioni è nell'intervallo del 40–60%, a seconda del motore e del tipo di scena. La varianza è determinata principalmente da volumetrici pesanti o da depth-of-field aggressiva, dove i denoiser AI lasciano ancora artefatti residui che richiedono un backup tramite conteggio dei campioni.

L'AI generativa nel previs e nel concept è la seconda categoria. Stable Diffusion XL e Midjourney sono ora parte dei cicli di lookdev di pre-produzione in diversi studi, utilizzati per iterazioni rapide di mood board prima della scultura 3D completa. RunwayML e strumenti simili gestiscono compositing rapidi per i clienti. L'integrazione nella pipeline è ancora ad hoc — la maggior parte degli studi gestisce l'AI generativa come binario parallelo piuttosto che come fase integrata — ma il flusso di lavoro si è stabilizzato abbastanza da essere citato nei brief dei clienti che riceviamo.

Image-to-3D e ricostruzione NeRF/Gaussian Splatting è la terza categoria — passata da curiosità di ricerca a strumentazione di produzione consegnata, trattata in dettaglio nella sezione successiva.

L'AI per rotoscoping, pulizia del matchmove e anteprime di simulazione è la categoria più silenziosamente trasformativa. Questi compiti nella parte centrale della pipeline hanno storicamente consumato una quota sproporzionata di tempo degli artisti junior, e gli strumenti che li accelerano spostano l'economia degli studi perché liberano ore, non minuti.

Ciò che l'AI nel 2026 non ha fatto è sostituire il giudizio degli artisti nelle fasi di lookdev, compositing o revisione direttoriale. Il modello che emerge negli studi che hanno adottato prima questi strumenti è che le dimensioni dei team sono rimaste costanti o sono cresciute leggermente mentre il throughput di progetto per artista è aumentato. Gli studi che hanno adottato cloud rendering insieme a strumenti assistiti da AI nel 2025–2026 hanno riferito di completare più progetti nello stesso arco di tempo senza ridurre l'organico.

Il Gaussian Splatting entra nella produzione VFX

Il Gaussian Splatting — e la sua estensione temporale, il 4D Gaussian Splatting — è passato da novità di paper di ricerca a strumentazione di produzione consegnata più rapidamente di quanto la maggior parte dei supervisori di pipeline si aspettasse. La tecnica codifica una scena 3D come milioni di piccoli Gaussian anisotropici al posto della geometria poligonale con texture; il risultato è una qualità visiva fotorealistica a velocità di rendering in tempo reale, con scene che girano abitualmente a 100+ FPS in Unreal Engine.

All'inizio del 2026, gli splat hanno supporto di prima classe nello stack di produzione: Nuke 17 include il supporto nativo per i Gaussian Splat, Houdini 21 include un'anteprima tecnica, OpenUSD 26.03 ha aggiunto uno schema di prima classe, e V-Ray 7 può ora eseguire il ray tracing dei dati splat accanto alla geometria tradizionale. Le integrazioni con il compositing e con i motori di rendering contano perché spostano gli splat al di fuori delle "isole" di virtual production esclusivamente Unreal e all'interno della pipeline VFX più ampia.

Il riferimento produttivo è il lavoro di Framestore su Superman (2025), dove lo studio ha utilizzato il 4D Gaussian Splatting per consegnare circa 40 shot final-pixel. È il primo caso ampiamente riportato in cui gli splat 4D hanno gestito shot che in precedenza richiedevano una combinazione di fotogrammetria tradizionale, lavoro su plate e ricostruzione CG. Da allora altri studi hanno seguito pubblicamente su lavori episodici e ICVFX.

Il contesto di mercato è favorevole. Le stime del settore collocano il mercato globale della virtual production a circa 2,9 miliardi di USD nel 2025, con proiezioni verso 18,5 miliardi di USD entro il 2035, e il Gaussian Splatting è ampiamente caratterizzato come metodo preferito per creare gli ambienti fotorealistici che alimentano i palcoscenici con volume LED. DJI Terra V5.0+ Flagship elabora ricostruzioni Gaussian Splatting a circa 500 immagini per ora su hardware da workstation; i set di qualità cinematografica richiedono tipicamente 300–1.000+ immagini da una DSLR o da un drone. Il tempo di acquisizione sul set e creazione dell'asset si è compresso da giorni di scansione manuale a meno di un'ora per molti ambienti.

Per le render farm, gli splat introducono un profilo di costo per frame diverso. Le scene poligonali scalano in modo prevedibile con il conteggio dei campioni e la complessità degli shader; le scene con splat-traced hanno un profilo di larghezza di banda della memoria più vicino al rendering volumetrico — la VRAM conta di più, e motori come V-Ray 7 stanno ancora evolvendo rapidamente i loro percorsi di splat-tracing. Li trattiamo operativamente come una classe di lavoro che richiede benchmark separati, non come "solo un altro tipo di geometria."

Pipeline Gaussian Splatting — acquisizione drone o DSLR → ricostruzione → riproduzione in tempo reale in Unreal Engine + compositing ray-traced in V-Ray 7

OpenUSD come standard di interscambio del settore

Universal Scene Description (USD) di Pixar, open-source dal 2016, è stata la candidata allo standard in combustione lenta per quasi un decennio. Nel 2026, "candidata" non è più la parola giusta. L'Alliance for OpenUSD (AOUSD), formata da Pixar insieme ad Adobe, Apple, Autodesk e NVIDIA nel 2023, è sulla buona strada per formalizzare le specifiche fondamentali di OpenUSD entro la fine del 2025, e il SIGGRAPH 2024 ha dimostrato l'espansione di OpenUSD al di là dei media e dell'intrattenimento tradizionali verso la robotica, la simulazione di veicoli autonomi e la visualizzazione industriale.

L'aggiornamento tecnico che conta di più per gli operatori di render farm è l'aggiunta del supporto Vulkan al renderer Hydra Storm di OpenUSD (annunciato in OpenUSD 24.08, contribuito da Pixar, Autodesk e Adobe sotto l'ombrello AOUSD per segnalazione del Khronos Group). HgiVulkan porta l'interfaccia Hydra alla parità di funzionalità con i backend OpenGL e Metal esistenti ed estende USD/Hydra ai dispositivi mobili Android, aprendo un target di piattaforma più ampio senza sacrificare il footprint Mac/Linux/Windows esistente.

Cosa significa questo in pratica:

- L'interscambio di asset tra DCC (Maya, Houdini, Cinema 4D, Blender, 3ds Max) è materialmente meno fragile rispetto all'utilizzo di FBX o export per-DCC. Rileviamo meno ticket di supporto per "transform interrotto" anno dopo anno man mano che gli studi consolidano USD come formato di andata e ritorno.

- L'interoperabilità tra motori di rendering sta migliorando — i render delegate Hydra di V-Ray, Karma, Arnold, Cycles e altri sono sempre più praticabili sia per il lookdev interattivo che per il rendering in batch, sebbene la parità con la descrizione di scena nativa di ciascun motore vari da motore a motore.

- Gli investimenti in strumentazione della pipeline si stanno spostando dagli importatori/esportatori per-DCC ai sistemi di pubblicazione di asset nativi USD. Gli studi che hanno costruito infrastrutture USD nel 2023–2024 stanno raccogliendo risparmi sui costi operativi; quelli che non l'hanno fatto lo trattano come una priorità di investimento per il 2026–2027.

OpenUSD non risolve ogni problema di interscambio nel 2026 — la traduzione di texture e materiali tra i delegate Hydra rimane imperfetta, e le estensioni per-motore creano rischi di vendor lock che l'apertura di USD avrebbe dovuto eliminare. La tendenza è tuttavia inequivocabile: USD è il consenso sul formato degli asset che il settore non aveva del tutto dieci anni fa.

Cloud rendering economics per studi indie e di fascia media

Il terzo cambiamento silenziosamente trasformativo del 2026 riguarda il lato dei costi. Il cloud rendering nel 2024 era inquadrato principalmente come capacità di overflow per gli studi con render wall propri. Nel 2026, è l'infrastruttura predefinita per i team indie e per una quota crescente di studi di fascia media — non come piano di riserva, ma come nucleo della loro pipeline.

Tre forze trainano questo cambiamento:

La volatilità dei prezzi GPU sul lato hardware. La NVIDIA RTX 5090 è stata lanciata a un prezzo MSRP di 1.999 USD, ma i prezzi al dettaglio nel 2026 sono variati tra 2.500 e 3.800 USD a causa della carenza di memoria GDDR7 e della domanda di calcolo AI che ha spiazzato l'offerta consumer. Per un piccolo studio che costruisce un nodo di rendering a otto GPU, quel delta moltiplicato per le schede più scheda madre, PSU, raffreddamento e rack ha destabilizzato il caso per il capex di calcolo GPU self-hosted.

La compressione del prezzo delle GPU cloud sul lato opex. I prezzi delle GPU cloud sono scesi più rapidamente dei prezzi delle schede al dettaglio, in particolare sui provider di secondo livello. La copertura del settore cita Thunder Compute a circa 0,66 USD per GPU-ora A100 rispetto a 4,10 USD sui cloud di primo livello. Questo spread è più ampio rispetto a 18 mesi fa, riducendo il divario di accesso all'infrastruttura tra studi grandi e piccoli per l'iterazione in tempo reale e il throughput del frame finale.

L'AI denoising che comprime il volume di calcolo necessario. Questo è il fattore meno apprezzato. Se un lavoro di archviz che richiedeva 4.000 campioni nel 2023 ora ne richiede 500 con l'AI denoising, il costo cloud per quel lavoro è circa 8 volte inferiore per la stessa qualità — il che cambia materialmente il punto di pareggio tra cloud e on-prem.

Il punto di pareggio esiste ancora. Le render wall locali hanno senso economico oltre circa 400+ ore di rendering al mese di volume elevato consistente, dove il costo per ora dell'hardware proprio scende al di sotto delle tariffe cloud. Al di sotto di quella soglia, il cloud offre un vantaggio strutturale di costo. Abbiamo trattato la matematica dettagliata nella nostra analisi del costo totale build-versus-cloud e nella nostra guida ai prezzi.

Ciò che è nuovo nel 2026 è la distribuzione degli studi su entrambi i lati di quella curva. La soglia delle 400 ore separava un tempo "freelance/indie" da "piccolo studio." Oggi separa sempre più "piccolo studio" da "fascia media" perché più piccoli studi si sono spostati verso uno stack cloud-first. Gli studi di fascia media e grande costruiscono ancora infrastrutture ibride: calcolo proprio per il baseline prevedibile più cloud per i picchi.

La leva operativa che conta di più è se il cloud scelto è completamente gestito o Infrastructure-as-a-Service (IaaS). Le pipeline sembrano superficialmente simili ma il tempo-artista-per-commessa differisce materialmente — argomento trattato nella nostra analisi completamente gestito vs. fai da te.

Sulla nostra farm, operiamo 20.000+ core CPU (nodi Dual Intel Xeon E5-2699 V4 con 96–256 GB di RAM) e una flotta GPU dedicata di schede NVIDIA RTX 5090 con 32 GB di VRAM ciascuna, con Cinema 4D + Redshift, V-Ray, Corona, Arnold, Octane e Cycles preinstallati e con licenza a livello di piattaforma. In qualità di partner di rendering ufficiale Chaos e partner ufficiale Maxon, le licenze per V-Ray, Corona e Redshift sono incluse piuttosto che gestite dall'utente. Il punto non è la scheda tecnica — è che il modello operativo (nessun desktop remoto, nessuna gestione degli installer, nessuna contesa per il server di licenze) è ciò che determina se il cloud rendering fa davvero risparmiare tempo agli artisti, indipendentemente dal provider.

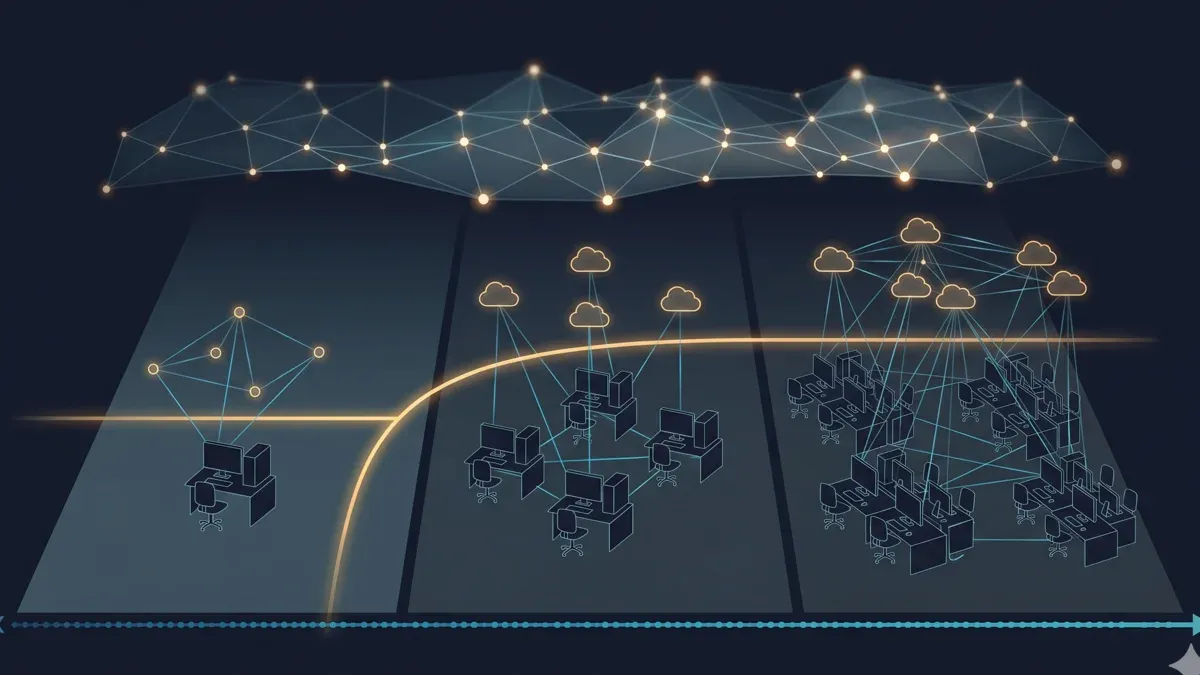

Framework decisionale per il cloud rendering nel 2026 — ore al mese vs dimensione dello studio vs scelta completamente gestito vs IaaS

Cosa significano queste tendenze per gli studi nel 2026

Leggere le cinque tendenze come un quadro unico piuttosto che come cinque storie separate cambia le conclusioni strategiche.

La formazione sulla pipeline ha convergito. Tre anni fa un TD che pianificava la formazione del team doveva scegliere tra approfondire Maya/Houdini, imparare Unreal Engine, costruire strumentazione USD o investire nell'integrazione del flusso di lavoro AI. Nel 2026, queste non sono più vie distinte — un TD di pipeline competente necessita di una fluenza funzionale in tutte e quattro, e lo stesso vale per il senior lookdev/lighting artist il cui lavoro ora abbraccia final-pixel offline path-traced, lookdev in tempo reale e passaggi di lookdev assistiti da AI.

L'architettura di calcolo è diventata più eterogenea, non meno. La narrativa del 2020 sosteneva che il rendering GPU avrebbe sostituito il rendering CPU. La realtà del 2026 è che la CPU possiede ancora circa il 70% del nostro mix di lavori di rendering, mentre la GPU guadagna quota per i lavori con Redshift, Octane, V-Ray GPU e Gaussian Splatting. Un piano hardware che presuppone l'uno o l'altro risulterà sottodimensionato da qualche parte.

La render farm offline si è spostata dal volume alla complessità. Gli studi che abbinano questo alla pianificazione dell'infrastruttura — burst cloud per i final-pixel path-traced mentre si eseguono iterazioni in tempo reale e assistite da AI internamente — ottengono il vantaggio di entrambi i livelli. Gli studi che cercano di far passare ogni shot esclusivamente attraverso offline puro o real-time puro finiscono per pagare per un modello e usare l'altro.

Gli studi indie e di fascia media hanno recuperato sull'accesso all'infrastruttura. La barriera per produrre lavoro VFX fotorealistico e complesso nel 2026 è sempre più la competenza e la maturità della pipeline, non l'accesso alle GPU. Le grandi strutture non possono più contare sul vantaggio grezzo del calcolo come fossato, e gli studi indie possono superare la propria categoria hardware con la disciplina operativa per abbinarsi.

Il tempo reale e l'offline coesistono come strumenti diversi, non come schema successore. Il discorso del settore spesso inquadra il tempo reale come l'eventuale sostituto dell'offline; cinque anni di evidenza suggeriscono che questa non è la traiettoria. Il tempo reale ha ampliato il lavoro che possiede; l'offline ha ampliato la complessità che possiede; entrambi stanno crescendo. Si pianifichi per l'eterogeneità composizionale piuttosto che per la transizione verso uno stack unico.

FAQ

Q: Quali sono le principali tendenze del settore VFX nel 2026? A: Cinque cambiamenti stanno ridisegnando il settore: il rendering in tempo reale che supera la soglia del final-pixel (Unreal Engine 5 e virtual production), l'AI che passa dal denoising a compiti all'interno della pipeline come previs generativo e rotoscoping, il Gaussian Splatting che entra negli strumenti di produzione VFX come tipo di asset di prima classe, OpenUSD che si consolida come standard di interscambio del settore, e il cloud rendering che diventa infrastruttura predefinita per studi indie e di fascia media piuttosto che capacità di overflow per quelli grandi.

Q: In che modo l'AI sta cambiando la pipeline di rendering VFX nel 2026? A: L'AI nel 2026 si trova all'interno della pipeline di produzione in più fasi. L'AI denoising (OptiX, Intel Open Image Denoise) è standard su V-Ray, Arnold, Redshift, Cycles e Karma, riducendo il conteggio dei campioni richiesti da circa 2.000–4.000 a 200–500 per qualità comparabile. Gli strumenti AI generativi come Stable Diffusion XL e RunwayML sono integrati nel lookdev di pre-produzione e nei compositing per i clienti. La ricostruzione image-to-3D e Gaussian Splatting è passata dalla ricerca a strumentazione di produzione consegnata. Rotoscoping, pulizia del matchmove e anteprime di simulazione assistiti da AI stanno comprimendo silenziosamente la parte centrale della pipeline.

Q: Unreal Engine 5 viene utilizzato per il rendering del pixel finale nel 2026? A: Sì — il Movie Render Queue di Unreal Engine 5 consegna shot final-pixel per ICVFX su volumi LED, lavori broadcast e commerciali a budget medio, e una quota crescente di contenuti episodici e cinematografici. La tecnica è stata pionierizzata da StageCraft di ILM su The Mandalorian nel 2019 e da allora si è diffusa ai livelli inferiori. Il lavoro cinematografico fotorealistico final-pixel che richiede light transport path-traced, output multi-layer deep-EXR e cicli di iterazione per shot continua a girare principalmente su motori offline come V-Ray, Arnold, Redshift e Karma — il tempo reale e l'offline si stratificano su fasi diverse della pipeline, non si sostituiscono a vicenda.

Q: Cos'è il Gaussian Splatting e perché è rilevante per il VFX nel 2026? A: Il Gaussian Splatting codifica una scena 3D come milioni di piccoli Gaussian anisotropici al posto della geometria poligonale con texture, producendo qualità visiva fotorealistica a velocità di rendering in tempo reale (100+ FPS in Unreal Engine). All'inizio del 2026, Nuke 17 include il supporto nativo per gli splat, Houdini 21 include un'anteprima tecnica, OpenUSD 26.03 ha aggiunto uno schema di prima classe, e V-Ray 7 può eseguire il ray tracing dei dati splat accanto alla geometria tradizionale. Framestore ha utilizzato il 4D Gaussian Splatting per consegnare circa 40 shot final-pixel su Superman (2025). Il tempo di acquisizione sul set e creazione dell'asset si è compresso da giorni a meno di un'ora per molti ambienti.

Q: Come sta cambiando OpenUSD le pipeline degli studi nel 2026? A: OpenUSD (Universal Scene Description), open-source di Pixar dal 2016, si sta consolidando come standard di interscambio del settore. L'Alliance for OpenUSD — Pixar, Adobe, Apple, Autodesk, NVIDIA, formata nel 2023 — è sulla buona strada per formalizzare le specifiche fondamentali di OpenUSD entro la fine del 2025. Il supporto Vulkan è stato aggiunto al renderer Hydra Storm in OpenUSD 24.08, estendendo la piattaforma a una gamma più ampia di dispositivi incluso Android. L'interscambio di asset tra Maya, Houdini, Cinema 4D, Blender e 3ds Max è materialmente meno fragile rispetto all'utilizzo di FBX, e l'interoperabilità tra motori di rendering tramite i render delegate Hydra sta migliorando anno dopo anno.

Q: Gli studi indie e di fascia media dovrebbero utilizzare il cloud rendering nel 2026? A: Per la maggior parte dei carichi di lavoro al di sotto di circa 400 ore di rendering al mese di volume consistente, il cloud rendering presenta un vantaggio strutturale di costo rispetto alla costruzione e al mantenimento di una render wall locale — e quella soglia continua a spostarsi verso l'alto man mano che i prezzi delle GPU cloud scendono e l'AI denoising comprime il conteggio dei campioni necessari. La leva più importante per l'economia degli studi è se il cloud scelto è completamente gestito (nessun desktop remoto, nessuna gestione degli installer, licenze gestite a livello di piattaforma) o Infrastructure-as-a-Service (IaaS). Oltre le 400 ore di volume mensile consistente, i modelli ibridi — calcolo proprio per il baseline più cloud per i picchi — tipicamente superano entrambi gli estremi.

Q: In che modo gli scioperi hollywoodiani del 2023 hanno influenzato le prospettive del settore VFX nel 2026? A: Gli scioperi WGA e SAG-AFTRA del 2023 hanno ridotto il volume di produzione a monte che confluiva a valle nelle pipeline dei fornitori VFX nel corso di gran parte del 2024 e di parte del 2025. VFX Voice descrive l'ingresso nel 2026 come un equilibrio tra incertezza e opportunità — le pipeline si stanno riempiendo nuovamente grazie a progetti streaming e cinematografici, ma l'occupazione freelance e contrattuale rimane irregolare, in particolare nei cluster del Regno Unito e di Vancouver che hanno assorbito i licenziamenti più pesanti. Diverse strutture di fascia media hanno virato verso servizi di virtual production o divisioni immersive per diversificare le entrate, cambiando strutturalmente la composizione degli acquirenti che le render farm servono.

Q: Quale hardware di rendering dovrebbero pianificare gli studi nel 2026? A: Si pianifichi per l'eterogeneità. Il rendering CPU possiede ancora la maggior parte del volume di lavori di rendering di produzione — archviz con V-Ray e Corona, animazione con Arnold, e pipeline dove la memoria per thread conta più dei FLOPS grezzi — mentre la GPU guadagna quota per i lavori con Redshift, Octane, V-Ray GPU e Gaussian Splatting. I prezzi al dettaglio della NVIDIA RTX 5090 sono variati tra 2.500 e 3.800 USD nel 2026 a causa della carenza di GDDR7 e della domanda di calcolo AI, destabilizzando il caso per il capex di calcolo GPU self-hosted per gli studi più piccoli. I prezzi delle GPU cloud sui provider di secondo livello si sono compressi significativamente (la copertura del settore cita circa 0,66 USD per GPU-ora A100 rispetto a 4,10 USD sui cloud di primo livello), riducendo il divario di accesso all'infrastruttura tra studi grandi e piccoli.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.