GPU Rendering vs CPU Rendering: Ein Praxisratgeber für Cloud-Renderfarm-Nutzer

Überblick

Einleitung

Die Frage GPU Rendering versus CPU Rendering taucht in fast jedem Gespräch auf, das wir mit Künstlern führen, die Cloud-Renderfarmen evaluieren. Es klingt wie eine einfache Entweder-oder-Entscheidung, aber in der Praxis hängt die Antwort von Ihrer Render-Engine, der Szenenkomplexität, den Speicheranforderungen und dem Budget ab. Keiner der Ansätze ist universell überlegen — jeder hat echte Kompromisse, die relevant sind, wenn Sie Geld für Cloud Rendering ausgeben.

Auf unserer Farm betreiben wir sowohl CPU- als auch GPU-Infrastruktur — über 20.000 CPU-Kerne zusammen mit einer dedizierten GPU-Flotte, ausgestattet mit NVIDIA RTX 5090-Karten (je 32 GB VRAM). Diese duale Konfiguration ist kein Zufall. Etwa 70 % der Jobs, die wir verarbeiten, sind CPU-basiert (V-Ray, Corona, Arnold CPU), während die verbleibenden 30 % auf GPU laufen (Redshift, Octane, V-Ray GPU). Diese Aufteilung spiegelt die Realität des Produktions-Renderings im Jahr 2026 wider: CPU Rendering bleibt das Arbeitstier für Architekturvisualisierung und VFX-Compositing, während GPU Rendering eine starke Position im Motion Design, Lookdev und der Echtzeit-Previsualisierung eingenommen hat.

Dieser Ratgeber erläutert die praktischen Unterschiede zwischen GPU und CPU Rendering aus der Perspektive einer Cloud-Renderfarm — mit Schwerpunkt auf Rendergeschwindigkeit, Kosten pro Frame, Speicherbeschränkungen, Engine-Kompatibilität und den Szenarien, in denen jeder Ansatz am sinnvollsten ist. Wenn Sie zwischen einem CPU- oder GPU-Workflow für Cloud Rendering entscheiden müssen, ist dies der Vergleich, den wir uns gewünscht hätten, als wir selbst anfingen, verteiltes Rendering zu betreiben.

Wie CPU Rendering funktioniert

CPU Rendering verwendet die Kerne Ihres Prozessors, um jeden Pixel im finalen Bild zu berechnen. Engines wie V-Ray (CPU-Modus), Corona Renderer und Arnold (CPU-Modus) verfolgen Lichtpfade sequenziell über alle verfügbaren Kerne. Moderne Server-CPUs — wie die Dual Intel Xeon E5-2699 V4-Prozessoren in unserer Flotte — bieten 44 Kerne pro Maschine, und Renderfarmen skalieren durch die Verteilung von Frames auf Hunderte solcher Maschinen gleichzeitig.

Der wesentliche Vorteil des CPU Renderings liegt im Speicherzugriff. CPUs arbeiten mit dem Systemspeicher (RAM), der auf Renderfarm-Nodes typischerweise zwischen 96 GB und 256 GB liegt. Dadurch kann CPU Rendering äußerst komplexe Szenen bewältigen — massive Archviz-Projekte mit Millionen von Polygonen, vollständig displaced Landschaften, schwere Partikelsimulationen — ohne an Speichergrenzen zu stoßen.

CPU Rendering profitiert außerdem von jahrzehntelanger Optimierung. V-Rays CPU-Pfad wurde seit den frühen 2000er Jahren verfeinert, und das Ökosystem an Plugins rund um CPU-Renderer (Forest Pack, RailClone, Tyflow, Phoenix FD) ist ausgereift und bewährt. Wenn Sie einen CPU-Renderjob an eine Cloud-Renderfarm übermitteln, arbeiten Sie mit einer Pipeline, die über Hunderttausende von Produktions-Frames hinweg erprobt wurde.

Stärken des CPU Renderings:

- Szenen, die 16–32 GB Textur- und Geometriedaten überschreiten

- Produktions-Workflows, die stark von CPU-exklusiven Plugins abhängen

- Animationssequenzen, bei denen konsistente, vorhersehbare Kosten pro Frame wichtig sind

- Archviz und VFX-Compositing, wo Farbgenauigkeit pro Pixel entscheidend ist

Wie GPU Rendering funktioniert

GPU Rendering nutzt die massiv-parallele Architektur von Grafikkarten. Während eine CPU möglicherweise 44 Kerne besitzt, verfügt eine einzelne NVIDIA RTX 5090 über Tausende von CUDA-Kernen. Diese sind nicht so leistungsfähig wie einzelne CPU-Kerne, aber für die inhärent parallele Aufgabe des Raytracing — das Berechnen von Millionen unabhängiger Lichtpfade — führt die schiere Kernanzahl direkt zu Geschwindigkeit.

Moderne GPU-Render-Engines wie Redshift, Octane und V-Ray GPU nutzen diese Parallelverarbeitung zusammen mit dedizierten RT-(Raytracing-)Kernen und Tensor-Kernen für KI-beschleunigtes Denoising. Auf unserer GPU-Flotte erleben wir, dass Frames, die auf der CPU 15–20 Minuten benötigen, auf einer einzelnen RTX 5090 in 2–4 Minuten fertig sind — ein Geschwindigkeitsvorteil von etwa 5–8×, je nach Szenenkomplexität.

GPU Rendering hat jedoch eine harte Einschränkung: VRAM. Die RTX 5090 bietet 32 GB VRAM, und Ihre gesamte Szene — Geometrie, Texturen, Displacement Maps, Licht-Caches — muss in diesen Speicher passen. Überschreitet eine Szene den verfügbaren VRAM, kommt es entweder zu einem Out-of-Memory-Fehler, oder die Engine greift auf den Systemspeicher zurück (bei Engines, die dies unterstützen, wie Redshift), was den Geschwindigkeitsvorteil erheblich mindert.

Stärken des GPU Renderings:

- Iterativer Lookdev und Beleuchtungs-Workflows, die schnelles Feedback erfordern

- Motion Design und Kurzfilm-Animationen mit moderater Szenenkomplexität

- Projekte, die bereits auf GPU-native Engines aufgebaut sind (Redshift, Octane)

- Szenen, die in VRAM-Grenzen passen und von KI-Denoising profitieren

Geschwindigkeitsvergleich: CPU vs GPU Renderzeit

Rohe Geschwindigkeit ist der auffälligste Unterschied, aber ein echter Äpfel-zu-Äpfeln-Vergleich ist schwieriger als es aussieht. Die Renderzeit hängt von der Engine, der Szene, den Sampling-Einstellungen und der Denoiser-Konfiguration ab. Folgendes haben wir über Tausende von Produktionsjobs auf unserer Farm beobachtet:

| Kennzahl | CPU Rendering | GPU Rendering |

|---|---|---|

| Typische Frame-Zeit (Archviz Innenraum) | 8–25 Minuten | 2–6 Minuten |

| Typische Frame-Zeit (Produktvisualisierung) | 5–15 Minuten | 1–4 Minuten |

| Typische Frame-Zeit (VFX-Compositing) | 15–45 Minuten | 5–15 Minuten |

| Skalierungsmodell | Mehr Maschinen = mehr Frames/Stunde | Mehr GPUs pro Frame ODER mehr Maschinen |

| KI-Denoising | Verfügbar (V-Ray, Corona) | Nativ + schneller (RT/Tensor-Kerne) |

| Zeit bis zum ersten Pixel | Langsamer (Szenen-Parsing) | Schneller (parallele Initialisierung) |

Diese Zahlen stammen aus echten Produktionsjobs — nicht aus synthetischen Benchmarks. Das tatsächliche Verhältnis variiert erheblich. Ein einfacher Produktshot kann eine 10×-Beschleunigung auf GPU erzielen, während ein dichtes Archviz-Exterior mit Forest Pack-Vegetation möglicherweise nur 3× schafft — oder überhaupt nicht in den VRAM passt.

Der entscheidende Aspekt: Renderfarm-Geschwindigkeit ist nicht nur die Zeit pro Frame. Auf einer CPU-Renderfarm können Sie 500 Frames auf 500 Maschinen verteilen und alle gleichzeitig rendern. Die Gesamtzeit für eine 500-Frame-Animation entspricht in etwa der Zeit für einen einzelnen Frame. GPU-Farmen funktionieren genauso, aber die Kosten pro Maschine sind höher, sodass sich die Wirtschaftlichkeit anders entwickelt.

Kostenvergleich: GPU Rendering vs CPU Rendering

Bei den Kosten wird der Vergleich praktisch. Die Hardware-Ökonomie von GPU vs CPU Rendering ist grundlegend verschieden, und diese Unterschiede schlagen sich direkt in den Cloud-Renderfarm-Preisen nieder.

Hardware-Kosten-Realität:

Basierend auf unseren Infrastrukturkosten kostet ein einzelner GPU-Rendernode (mit RTX 5090) in Bezug auf die Hardware-Investition etwa 8–10× so viel wie ein CPU-Rendernode. Das bedeutet, GPU-Renderzeit wird auf praktisch jeder Cloud-Renderfarm mit einem Aufpreis berechnet.

Kosten pro Frame — die Kennzahl, auf die es wirklich ankommt:

| Szenario | CPU-Kosten/Frame | GPU-Kosten/Frame | Gewinner |

|---|---|---|---|

| Einfacher Produktshot (leichte Szene) | 0,15–0,40 $ | 0,08–0,20 $ | GPU |

| Archviz Innenraum (moderat) | 0,30–0,80 $ | 0,15–0,45 $ | GPU |

| Dichtes Archviz-Exterior (schwere Vegetation) | 0,50–1,50 $ | Passt ggf. nicht in VRAM | CPU |

| VFX-Compositing (schwere Simulationsdaten) | 0,80–2,50 $ | 0,40–1,20 $ | GPU (wenn es passt) |

| Animation (1.000+ Frames, moderat) | 150–500 $ gesamt | 80–250 $ gesamt | GPU |

Diese Spannen sind Näherungswerte und hängen von Render-Einstellungen, Auflösung und Farm-Preisgestaltung ab. Das Muster ist jedoch klar: Wenn eine Szene komfortabel in den GPU-Speicher passt, ist GPU Rendering pro Frame in der Regel günstiger, weil die schnellere Renderzeit den höheren Stundensatz mehr als ausgleicht. Wenn Szenen jedoch VRAM-Grenzen überschreiten, wird CPU zur einzig praktikablen Option — der Versuch, einen GPU-Workflow für eine zu große Szene zu erzwingen, führt zu fehlgeschlagenen Renders und verschwendetem Budget.

Auf unserer Farm erleben wir das täglich. Motion-Design-Studios, die Redshift-Animationen rendern, zahlen pro Frame auf GPU konsequent weniger. Archviz-Studios, die mit komplexen urbanen Szenen und schwerer Vegetation arbeiten, benötigen konsequent CPU — und die Kosten pro Frame sind höher, aber die Renders werden tatsächlich abgeschlossen.

Die VRAM-Frage: Wenn der Speicher entscheidet

VRAM ist der mit Abstand wichtigste Faktor, der Projekte zum CPU Rendering drängt, und es lohnt sich, dies genau zu verstehen.

Was VRAM verbraucht:

| Asset-Typ | Typischer VRAM-Verbrauch |

|---|---|

| 4K-Textur (unkomprimiert) | 64 MB |

| 4K-Textur (GPU-komprimiert) | 16–32 MB |

| 1 Million Polygone | ~40–80 MB |

| Displacement Map (dicht) | 200–500 MB pro Objekt |

| Volumetrische Daten (Rauch/Feuer) | 500 MB – 4 GB |

| Forest Pack Scatter (10 Mio. Instanzen) | 2–8 GB |

Ein typischer Archviz-Innenraum mit 50 hochauflösenden Texturen, detaillierten Möbeln und Tuchsimulation könnte 8–12 GB VRAM beanspruchen. Das passt komfortabel auf eine RTX 5090 (32 GB). Fügen Sie jedoch eine Außenansicht mit Forest Pack-Vegetation, ein paar Millionen gestreuter Pflanzen und einen volumetrischen Nebel-Pass hinzu, befinden Sie sich im Bereich von 40–60 GB — weit jenseits einer einzelnen GPU.

Engine-spezifischer VRAM-Umgang:

- Redshift: Unterstützt Out-of-Core Rendering (Auslagerung auf Systemspeicher), aber mit erheblicher Geschwindigkeitseinbuße — eine Szene, die in 3 Minuten rendert, wenn sie in VRAM passt, kann 20 Minuten dauern, wenn auf RAM ausgelagert wird

- Octane: Historisch strikte VRAM-Grenzen; neuere Versionen unterstützen Out-of-Core, aber die Leistung nimmt ab

- V-Ray GPU: Der Hybrid-CPU+GPU-Modus kann VRAM durch Systemspeicher ergänzen, aber der reine GPU-Modus liefert die höchste Geschwindigkeit

- Arnold GPU: Verwendet ein Unified-Memory-Modell auf unterstützten Plattformen, das ein reibungsloseres Überlaufen von VRAM auf Systemspeicher ermöglicht

Wenn Sie Szenen entwickeln, die regelmäßig 20 GB an Asset-Daten überschreiten, ist es wahrscheinlich besser, Ihren Workflow von Anfang an auf CPU Rendering auszulegen. Eine GPU-optimierte Szene für CPU anzupassen ist unkompliziert; der umgekehrte Weg erfordert oft erhebliche Textur- und Geometrieoptimierungen.

Render-Engine-Kompatibilität

Ihre Wahl der Render-Engine bestimmt häufig, ob Sie einen GPU- oder CPU-Pfad einschlagen — und der Wechsel der Engine mitten im Projekt ist selten praktikabel.

| Render-Engine | CPU-Unterstützung | GPU-Unterstützung | Primärer Modus | Hinweise |

|---|---|---|---|---|

| V-Ray 7 | Vollständig | Vollständig | Beide gleichermaßen | Hybrid-Modus verfügbar; offizieller Chaos-Partner |

| Corona Renderer | Vollständig | Nein | Nur CPU | Chaos-Produkt; kein GPU-Fahrplan angekündigt |

| Arnold | Vollständig | Vollständig | CPU traditionell, GPU wächst | Autodesk-Ökosystem |

| Redshift | Nein | Vollständig | Nur GPU | Offizieller Maxon-Partner; Out-of-Core für große Szenen |

| Octane | Nein | Vollständig | Nur GPU | OTOY; stark im Motion Design |

| Cycles (Blender) | Vollständig | Vollständig | GPU in der Community bevorzugt | Open-Source; CUDA + OptiX Unterstützung |

Die praktische Schlussfolgerung: Wenn Sie Corona verwenden, sind Sie auf CPU — ohne Ausnahme. Wenn Sie Redshift oder Octane verwenden, sind Sie auf GPU. V-Ray, Arnold und Cycles bieten Ihnen echte Flexibilität, je nach Projekt zu wählen.

Für Studios, die mehrere Engines für unterschiedliche Projekte einsetzen, ist eine Renderfarm, die sowohl CPU als auch GPU unterstützt, unverzichtbar — ob Sie eine V-Ray Cloud-Renderfarm für CPU-Jobs oder eine GPU Cloud-Renderfarm für Redshift- und Octane-Arbeit benötigen. Wir betreiben beide Flotten gezielt, weil unsere Nutzer diese Flexibilität benötigen — ein Archviz-Team könnte morgens V-Ray CPU-Jobs und nachmittags Redshift GPU-Jobs einreichen.

Wann Sie GPU Rendering wählen sollten

GPU Rendering ist die richtige Wahl, wenn:

- Ihre Render-Engine GPU-nativ ist — Redshift- und Octane-Nutzer haben keine CPU-Option, und diese Engines sind speziell für GPU-Architektur optimiert

- Ihre Szenen in den VRAM passen — Wenn Ihre schwerste Szene weniger als 24–28 GB beansprucht (mit Puffer auf einer 32-GB-Karte), ist GPU fast immer schneller und günstiger

- Sie schnelle Iteration benötigen — Der Geschwindigkeitsvorteil von GPU ist am wertvollsten in Lookdev- und Beleuchtungsphasen, wo Sie Dutzende von Test-Frames rendern

- Sie Motion Design betreiben — Kurzfilm-Animationen mit stilisierten oder moderat-komplexen Szenen sind GPUs Spezialgebiet

- KI-Denoising Teil Ihrer Pipeline ist — GPU-Engines nutzen Tensor-Kerne für schnelleres, qualitativ hochwertigeres Denoising

Wann Sie CPU Rendering wählen sollten

CPU Rendering ist die richtige Wahl, wenn:

- Ihre Szenen den GPU-Speicher überschreiten — Jede Szene, die über 28–30 GB Daten hinausgeht, benötigt CPU (oder akzeptiert erhebliche GPU-Leistungseinbußen)

- Ihre Plugins massive Geometrie erzeugen — Forest Pack-, RailClone- und Phoenix FD-Szenen mit Millionen gestreuter Instanzen oder schweren Simulationsdaten überschreiten oft den GPU-VRAM und machen CPU zur praktischen Wahl

- Sie vorhersehbare Kosten in großem Maßstab benötigen — CPU Rendering-Kosten sind für große Animationsbatches linearer und vorhersehbarer

- Farbgenauigkeit nicht verhandelbar ist — Einige Studios in VFX-Compositing und Filmproduktion bevorzugen CPU-Pfade wegen ihres deterministischen Sampling-Verhaltens

- Ihre Engine CPU-exklusiv ist — Corona Renderer-Nutzer haben keine GPU-Alternative

- Sie massive Archviz-Szenen rendern — Stadtmaßstäbliche Projekte mit schweren Vegetations-Scatters sind CPU-Territorium

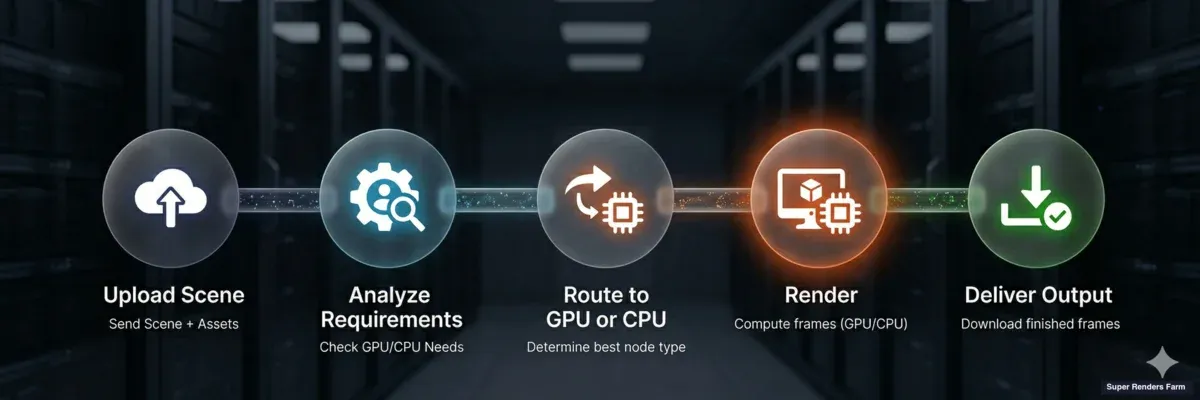

Der hybride Ansatz: Beide nutzen

In der Praxis entscheiden sich viele Studios nicht für das eine oder das andere — sie setzen beides strategisch ein. So strukturieren erfolgreiche Studios ihre Workflows nach unserer Beobachtung:

Lookdev-Phase (GPU): Nutzen Sie GPU Rendering für schnelle Iteration bei Materialien, Beleuchtung und Komposition. Schnelle Feedback-Schleifen sparen Stunden kreativer Zeit.

Test-Renders (GPU): Reichen Sie niedrig aufgelöste oder einzelne Frame-Tests bei einer GPU-Renderfarm ein, um Einstellungen zu validieren, bevor Sie sich auf eine vollständige Sequenz festlegen.

Produktions-Renders (CPU oder GPU je nach Szene): Führen Sie die vollständige Animation auf dem Rechentyp durch, der den Speicher- und Engine-Anforderungen der Szene entspricht.

Schwere Szenen (CPU): Leiten Sie jeden Frame, der VRAM-Limits überschreitet, an CPU-Nodes weiter. Die meisten verwalteten Renderfarmen, einschließlich unserer, übernehmen das Job-Routing basierend auf Szenenanforderungen — sodass die CPU/GPU-Aufteilung auf Infrastrukturebene stattfindet und nicht manuelles Eingreifen des Künstlers erfordert.

Hybrid GPU and CPU cloud rendering workflow — scene upload, analysis, routing to GPU or CPU nodes, render, delivery

Dieser hybride Ansatz ist zunehmend verbreitet. V-Ray 7s Hybrid-Rendering-Modus, der die Arbeit gleichzeitig auf CPU und GPU verteilt, ist eine technische Umsetzung dieser Philosophie auf Engine-Ebene. Auf einer Cloud-Renderfarm findet das Hybrid auf Infrastrukturebene statt — verschiedene Jobs werden je nach Anforderungen an verschiedene Hardware weitergeleitet.

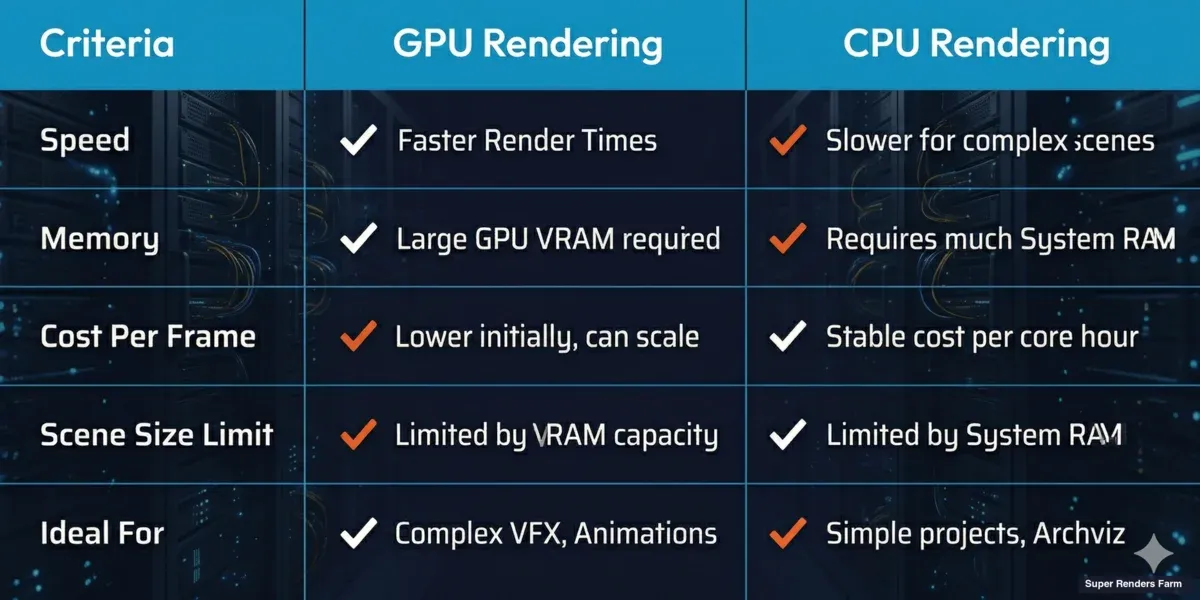

Zusammenfassung: GPU vs CPU Rendering auf einen Blick

| Faktor | CPU Rendering | GPU Rendering |

|---|---|---|

| Geschwindigkeit | Moderat (skaliert mit Kernen) | Schnell (typisch 5–8× Vorteil) |

| Speicher | 96–256 GB Systemspeicher (RAM) | 32 GB VRAM (RTX 5090) |

| Kosten pro Stunde | Niedriger | Höher (~3–5×) |

| Kosten pro Frame | Höher (langsamere Frames) | Niedriger (wenn Szene in VRAM passt) |

| Plugin-Ökosystem | Ausgereift, umfassend | Wächst, einige Lücken |

| Szenengrößen-Limit | Praktisch keins | VRAM-begrenzt |

| Engines | V-Ray, Corona, Arnold, Cycles | Redshift, Octane, V-Ray GPU, Arnold GPU, Cycles |

| Ideal für | Archviz, schwere VFX, große Szenen | Motion Design, Lookdev, moderate Szenen |

| KI-Denoising | Verfügbar | Schneller (dedizierte Hardware) |

GPU rendering vs CPU rendering comparison — speed, memory, cost, and ideal use cases

Weder GPU- noch CPU Rendering wird verschwinden. Der Trend geht zu mehr GPU-Nutzung, da VRAM zunimmt und Engines ausgereifter werden, aber CPU Rendering bleibt für die schwersten Produktions-Workflows unverzichtbar. Die praktische Frage lautet nicht „welches ist überlegen?" — sondern „welches passt zu meinen spezifischen Szenen, meiner Engine und meinem Budget?"

Einen tieferen Einblick in die Funktionsweise der Renderfarm-Preisgestaltung für GPU- und CPU-Jobs bietet unser Kosten-pro-Frame-Überblick. Wenn Sie neu im Cloud Rendering sind, erklärt unser Cloud Rendering Erklärungs-Ratgeber die Grundlagen des verteilten Renderings.

FAQ

Q: Was ist der Hauptunterschied zwischen GPU Rendering und CPU Rendering? A: GPU Rendering nutzt die massiv-parallele Architektur von Grafikkarten (Tausende von CUDA-Kernen), um Pixel gleichzeitig zu berechnen, während CPU Rendering Prozessorkerne (typischerweise 16–44 Kerne pro Maschine) mit Zugang zu deutlich größerem Systemspeicher verwendet. GPU ist pro Frame in der Regel schneller, aber durch VRAM limitiert; CPU verarbeitet größere Szenen, braucht aber länger pro Frame.

Q: Ist GPU Rendering immer schneller als CPU Rendering? A: Nicht immer. GPU Rendering ist typischerweise 5–8× schneller bei Szenen, die in VRAM-Grenzen passen. Wenn eine Szene den verfügbaren VRAM überschreitet, scheitern GPU-Engines entweder oder fallen mit erheblichen Leistungseinbußen auf Systemspeicher zurück. In diesen Fällen kann CPU Rendering tatsächlich schneller abschließen, da keine Speicherengpässe auftreten.

Q: Wie viel kostet GPU Rendering im Vergleich zu CPU auf einer Renderfarm? A: GPU-Nodes kosten aufgrund der höheren Hardware-Investition etwa 3–5× mehr pro Stunde als CPU-Nodes. Da GPU Frames jedoch schneller rendert, sind die Kosten pro Frame für Szenen, die in den GPU-Speicher passen, oft niedriger. Eine detaillierte Preisanalyse finden Sie in unserem Renderfarm-Kosten-pro-Frame-Ratgeber.

Q: Was passiert, wenn meine Szene den GPU-VRAM überschreitet? A: Das hängt von der Engine ab. Redshift unterstützt Out-of-Core Rendering, lagert Daten auf den Systemspeicher aus — mit Geschwindigkeitseinbuße. Octane und V-Ray GPU haben ähnliche Fallback-Mechanismen. Wenn die Szene den VRAM erheblich überschreitet (2× oder mehr), ist CPU Rendering die praktikable Lösung. Auf unserer Farm werden Szenen, die VRAM-Limits überschreiten, wenn möglich automatisch an CPU-Nodes weitergeleitet.

Q: Welche Render-Engines unterstützen nur GPU Rendering? A: Redshift und Octane sind GPU-exklusive Render-Engines ohne CPU-Rendering-Option. V-Ray, Arnold und Blenders Cycles unterstützen sowohl CPU- als auch GPU-Modi. Corona Renderer ist CPU-exklusiv ohne GPU-Rendering-Unterstützung.

Q: Kann ich sowohl GPU als auch CPU Rendering auf einer Cloud-Renderfarm nutzen? A: Ja. Farmen, die sowohl CPU- als auch GPU-Infrastruktur betreiben, ermöglichen es Ihnen, verschiedene Jobs an die entsprechende Hardware weiterzuleiten. Auf unserer Farm können Sie V-Ray CPU-Jobs neben Redshift GPU-Jobs einreichen, ohne separate Workflows zu verwalten. Einige Engines wie V-Ray 7 unterstützen auch Hybrid-Rendering, das CPU und GPU gleichzeitig auf einer einzelnen Maschine nutzt.

Q: Ist GPU Rendering gut für Architekturvisualisierung? A: Das hängt vom Szenenmaßstab ab. Moderate Archviz-Innenräume (unter 24–28 GB Szenendaten) rendern auf GPU effizient. Aber große Außenszenen mit schweren Vegetations-Scatters, hochauflösenden Texturen und Displacement Maps überschreiten häufig die VRAM-Grenzen und machen CPU zur zuverlässigeren Wahl für komplexe Archviz-Arbeit.

Q: Wie hängt Echtzeit-Raytracing mit GPU Rendering für die Produktion zusammen? A: Echtzeit-Raytracing (verwendet in Game-Engines wie Unreal Engine 5) und Produktions-GPU Rendering nutzen beide dieselbe GPU-Hardware — RT-Kerne und CUDA-Kerne. Allerdings priorisiert Produktions-Rendering Qualität über Geschwindigkeit und verwendet weit mehr Samples pro Pixel. Die Hardware-Fortschritte, die durch Echtzeit-Raytracing vorangetrieben werden (größerer VRAM, schnellere RT-Kerne), kommen direkt Produktions-GPU-Renderern wie Redshift und Octane zugute.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.