O Que É Renderização? Guia Completo de Computação Gráfica

Visão geral

O Que É Renderização em Gráficos Computacionais?

Todas as imagens que se veem num filme Pixar, cada frame de um walkthrough arquitectónico e cada explosão num videojogo partilham uma origem comum: renderização. No essencial, renderização é o processo de conversão de dados tridimensionais — geometria, materiais, iluminação e informação de câmara — numa imagem bidimensional que os humanos conseguem visualizar num ecrã ou imprimir.

Pense nisso como fotografia, mas inteiramente virtual. Um fotógrafo tradicional arruma uma cena, posiciona uma câmara, ajusta a iluminação e pressiona o obturador. Renderização segue a mesma lógica: um artista 3D constrói uma cena digital, coloca uma câmara virtual, define fontes de luz e depois instrui o computador para «tirar a foto». A diferença é que cada fotão de luz, cada reflexão de superfície e cada sombra devem ser calculados matematicamente em vez de capturados opticamente.

Renderização aparece em quase toda a indústria visual. Estúdios de cinema usam-na para criar personagens e ambientes fotorrealistas. Escritórios de arquitectura produzem apresentações de cliente que parecem indistinguíveis de fotografias. Programadores de jogos geram milhões de frames por segundo para manter a gameplay fluida. Investigadores médicos visualizam estruturas anatómicas complexas. Designers de produtos iteram protótipos sem fabricar uma única unidade física.

Este guia percorre como funciona a renderização, as principais técnicas envolvidas, o software que a alimenta, e o que acontece quando uma única estação de trabalho já não é suficiente.

Renderização em Tempo Real vs Renderização Offline

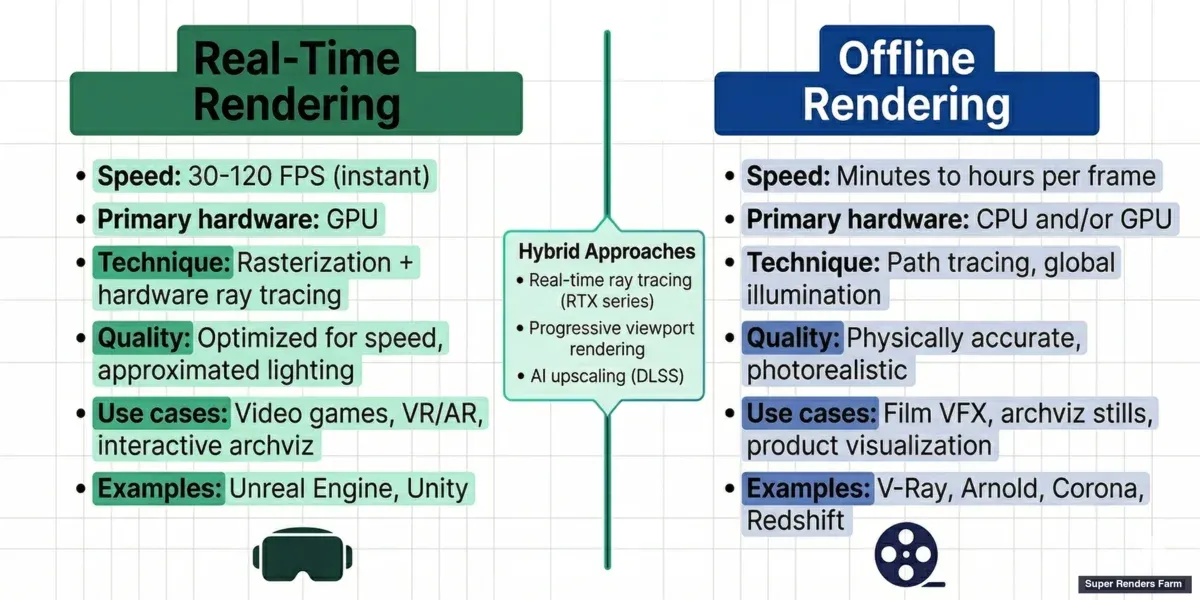

Renderização divide-se em dois paradigmas fundamentais baseados em requisitos de velocidade: tempo real e offline.

Renderização em tempo real produz imagens com rapidez suficiente para utilização interactiva — tipicamente 30 a 120 frames por segundo. Videojogos, realidade virtual, realidade aumentada e visualizações arquitectónicas interactivas dependem de renderização em tempo real. A GPU processa a maioria dos cálculos, utilizando algoritmos optimizados que priorizam velocidade sobre precisão física absoluta. Tecnologias como rasterização (projectando triângulos 3D num ecrã 2D) e ray tracing acelerado por hardware (introduzido pela arquitectura NVIDIA RTX) tornam isto possível.

Renderização offline (também chamada pré-renderização) prioriza qualidade de imagem sobre velocidade. Um único frame pode levar minutos, horas ou mesmo dias a computar. Filmes de longa duração, animação de transmissão, imagens arquitectónicas estáticas e visualização de produtos típicamente usam renderização offline. O objectivo é fotorrealismo ou um aspecto artístico específico, e o tempo de computação extra permite simulação de luz fisicamente exacta — iluminação global, caustics, subsurface scattering e efeitos volumétricos que os motores em tempo real aproximam mas não conseguem replicar completamente.

Abordagens híbridas estão a tornar-se cada vez mais comuns. Ray tracing em tempo real em GPUs modernas (série NVIDIA RTX, AMD RDNA 3+) traz alguns efeitos de qualidade offline para fluxos de trabalho interactivos. Renderização progressiva em previsualizações de viewport — disponível em motores como V-Ray e Redshift — permite aos artistas ver um resultado aproximado em segundos que refina ao longo do tempo. Técnicas assistidas por IA como NVIDIA DLSS usam redes neurais para aumentar a escala de renderizações em resolução inferior, efectivamente multiplicando performance sem perda de qualidade proporcional.

Real-time rendering vs offline rendering comparison — speed, quality, and use cases for games, film, and architecture

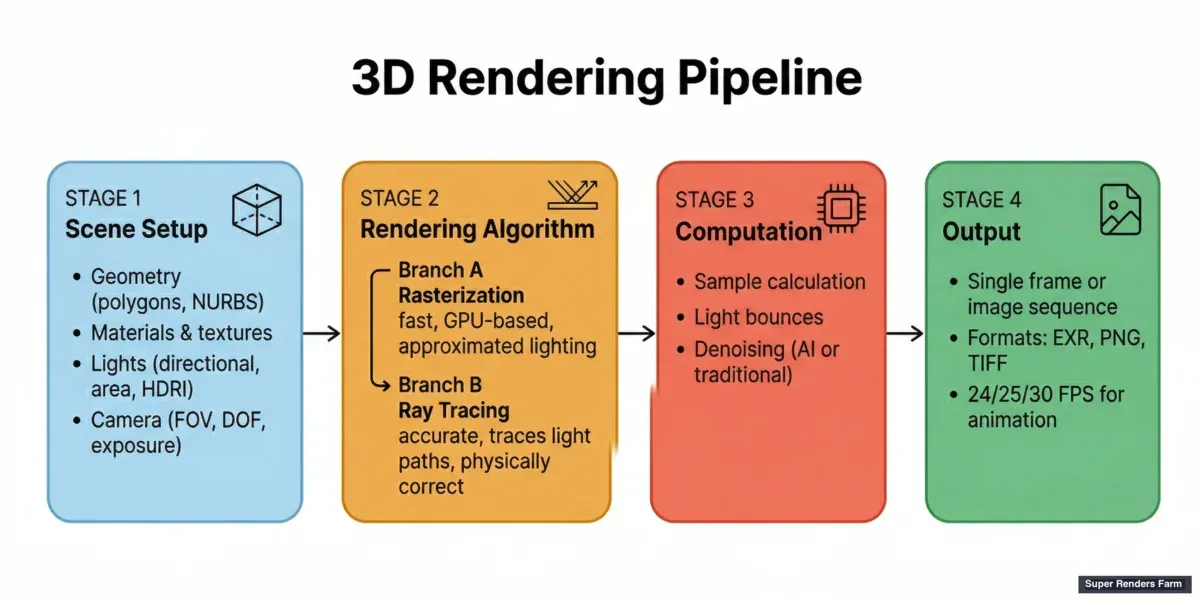

Como Funciona a Renderização: O Pipeline Técnico

Compreender o pipeline de renderização ajuda a desmistificar o que acontece entre clicar em «Renderizar» e ver uma imagem final.

Configuração de cena vem primeiro. O artista define geometria (as formas 3D — polígonos, NURBS, superfícies de subdivisão), aplica materiais e texturas (como as superfícies parecem — cor, reflectividade, rugosidade, transparência), coloca luzes (direccionais, ponto, área, mapas de ambiente) e posiciona uma câmara virtual (campo de visão, profundidade de campo, exposição).

O algoritmo de renderização processa então esta cena. As duas famílias dominantes de algoritmos são:

Rasterização projecta cada triângulo 3D na cena no ecrã 2D, determinando quais pixels cobre e qual cor esses pixels deveriam ser. É extremamente rápida — GPUs modernas conseguem rasterizar biliões de triângulos por segundo — mas processa iluminação indirecta e reflexões através de aproximações (mapas de sombra, reflexões no espaço do ecrã, sondas de luz). Rasterização alimenta virtualmente toda a renderização em tempo real.

Ray tracing simula luz mais precisamente traçando o caminho de rayos individuais da câmara através de cada pixel e para a cena. Quando um ray atinge uma superfície, consegue refratar, refractar ou dispersar, gerando rayos secundários que interagem com outros objectos. Path tracing é uma forma específica de ray tracing que segue rayos através de múltiplos saltos para convergir num resultado fisicamente exacto. Ray tracing processa reflexões, refrações, sombras suaves e iluminação global naturalmente mas requer significativamente mais computação.

Outras técnicas existem para casos de uso específicos. Radiosity calcula a transferência de energia de luz entre superfícies e excela em inter-reflexões difusas suaves em cenas arquitectónicas. Photon mapping processa caustics (os padrões de luz focados que se veem no fundo de uma piscina) mais eficientemente do que pure path tracing.

Saída é o passo final. Uma única imagem renderizada chama-se frame. Para animação, o renderizador produz uma sequência de frames — tipicamente 24, 25 ou 30 por segundo para filme e transmissão, ou superior para trabalho em câmara lenta. Formatos de saída incluem EXR (gama dinâmica alta, standard da indústria para compositing VFX), PNG (sem perda, adequado para stills), TIFF e JPEG.

3D rendering pipeline diagram — scene setup, rendering algorithm, and output stages

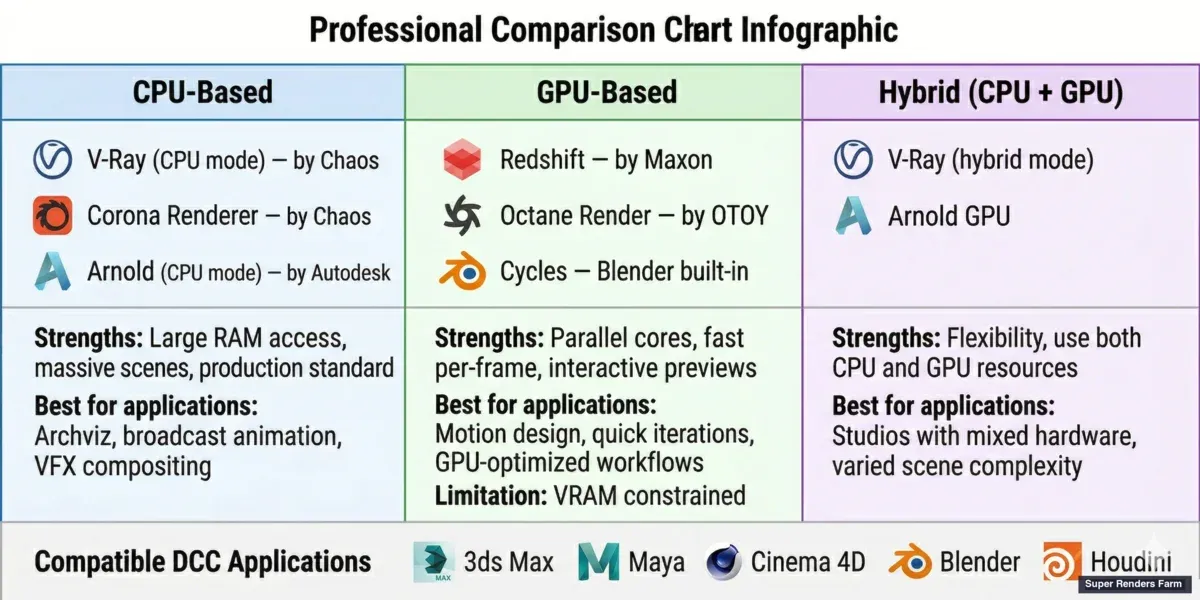

Motores de Renderização: O Software Que Faz o Trabalho

Um motor de renderização é o componente de software que executa o algoritmo de renderização. A maioria das aplicações 3D incluem um renderizador incorporado mas também suportam motores de terceiros que oferecem capacidades especializadas.

Motores de renderização baseados em CPU executam principalmente no processador. Conseguem alavancar grandes quantidades de RAM do sistema, tornando-os adequados para cenas com geometria maciça ou datasets de textura. Exemplos incluem V-Ray (modo CPU), Corona Renderer e Arnold. V-Ray e Corona são desenvolvidos por Chaos, enquanto Arnold é um produto Autodesk. Renderização em CPU tem sido o standard de produção durante décadas e permanece a força de trabalho para visualização arquitectónica, animação de transmissão e compositing VFX.

Motores de renderização baseados em GPU executam na placa gráfica, explorando os milhares de núcleos paralelos da GPU para acelerar renderização dramaticamente. Redshift (um produto Maxon), Octane Render, V-Ray GPU e Cycles (o motor incorporado do Blender) caem todos nesta categoria. Renderização em GPU é tipicamente mais rápida por frame mas é constrangida pela VRAM disponível — cenas que excedem a memória da GPU devem recair em renderização fora-do-núcleo ou processamento de CPU.

Motores híbridos conseguem utilizar recursos tanto de CPU como GPU. V-Ray, por exemplo, oferece modos de renderização tanto CPU como GPU e consegue combiná-los num único render. Arnold também adicionou suporte GPU em versões recentes.

CPU vs GPU render engines comparison — V-Ray, Corona, Arnold, Redshift, Octane, and Cycles

Estes motores inserem-se em aplicações 3D principais: Autodesk 3ds Max, Autodesk Maya, Maxon Cinema 4D, Blender e SideFX Houdini. A escolha do motor depende dos requisitos do projecto — velocidade, qualidade, espaço de memória e compatibilidade de pipeline. Para uma comparação mais profunda de como V-Ray é executado em diferentes hosts 3D, veja nossa comparação V-Ray para Blender vs 3ds Max.

Desafios Comuns de Renderização

Mesmo com hardware poderoso e software maduro, renderização apresenta desafios recorrentes em produção.

Tempos de renderização longos são o estrangulamento mais universal. Um único frame de um interior arquitectónico complexo com iluminação global, texturas de alta resolução e vegetação detalhada (Forest Pack, RailClone) consegue levar 20 minutos a várias horas numa estação de trabalho de topo. Multiplique isso por milhares de frames para uma animação, e uma única máquina rapidamente fica impraticável. Nosso guia de optimização de tempo de renderização aborda técnicas práticas para reduzir tempos de renderização por frame sem sacrificar qualidade.

Limitações de memória constrangem o que uma cena consegue conter. Renderização em GPU é especialmente sensível a limites de VRAM — uma cena que se encaixa confortavelmente em 64 GB de RAM do sistema consegue falhar numa GPU com 24 GB de VRAM. Mapas de displacement, vegetação de alta polycount, sistemas de partículas e mapas de textura 8K+ contribuem todos para pressão de memória. Compreender a diferença entre renderização em GPU e CPU ajuda no planeamento de um pipeline.

Ruído e artefactos aparecem quando o renderizador não computou amostras de luz suficientes. Path tracing produz ruído que diminui conforme mais amostras são calculadas, mas alcançar um resultado limpo leva tempo. Denoisers — tanto tradicionais (p.ex., Intel Open Image Denoise) como alimentados por IA (NVIDIA OptiX, denoiser incorporado de V-Ray) — conseguem reduzir ruído visível sem requerer a contagem completa de amostras, mas denoising agressivo consegue desfocar detalhes finos.

Gestão de cores assegura que imagens renderizadas parecem consistentes em diferentes monitores e em compositing. ACES (Academy Color Encoding System) tornou-se o standard de pipeline de cores em filme e visualização de topo, enquanto sRGB permanece comum para saída web e jogo.

Para uma referência abrangente de resolução de problemas, nosso guia para problemas e soluções comuns de renderização aborda os problemas que equipas de produção encontram com maior frequência.

Render Farms: Escalando Renderização Além de Uma Única Máquina

Quando as exigências de renderização de um projecto excedem o que uma única estação de trabalho consegue entregar — milhares de frames de animação, um prazo apertado, ou cenas demasiado complexas para hardware local — o próximo passo é uma render farm.

Uma render farm é uma colecção de computadores em rede (chamados nós) que dividem o trabalho de renderização entre si. Em vez de uma máquina gastar 100 horas renderizando 1.000 frames sequencialmente, uma farm com 100 nós consegue completar o mesmo trabalho em aproximadamente 1 hora renderizando frames em paralelo. Este conceito de renderização distribuída é como estúdios de todos os tamanhos encontram prazos de produção sem comprar centenas de máquinas imediatamente.

Existem duas abordagens principais. Construir uma render farm privada significa comprar, albergar e manter seu próprio hardware — uma opção que faz sentido para estúdios com necessidades de renderização consistentes de alto volume e pessoal técnico para gerir infraestrutura. Render farms na nuvem fornecem a mesma capacidade de renderização paralela como um serviço: carrega sua cena, a farm renderiza-a através de muitos nós simultaneamente, e descarrega os frames terminados. Nenhuma compra de hardware, nenhuma manutenção, nenhumas máquinas ociosas entre projectos. Para uma explicação mais ampla de renderização baseada na nuvem, veja nosso guia de renderização na nuvem.

Render farms na nuvem propriamente ditas vêm em dois modelos. Farms self-service (IaaS) dão acesso remoto a máquinas virtuais — instala-se software, gerem-se licenças e resolvem-se problemas de forma autónoma. Farms totalmente geridas lidam com todo o pipeline: instalação de software, compatibilidade de plugins, gestão de licenças e suporte técnico. Carrega um ficheiro de cena, configura definições de renderização e recebe frames terminados. Para mais sobre como estes modelos diferem, veja nossa comparação de render farms totalmente geridas vs DIY.

Super Renders Farm opera como uma render farm na nuvem totalmente gerida, suportando motores de renderização principais — V-Ray, Corona, Arnold, Redshift, Octane e Cycles — através de 3ds Max, Maya, Cinema 4D, Blender, Houdini, After Effects e NukeX. Como um Chaos e Maxon parceiro de renderização oficial, SuperRenders inclui renderização licenciada para motores suportados sem custo adicional. A infraestrutura funciona em 20.000+ núcleos de CPU e uma frota de GPU dedicada com NVIDIA RTX 5090 (32 GB VRAM por placa), tratando de ambas as cargas de trabalho arquitectónicas pesadas em CPU e pipelines de design de movimento acelerados por GPU.

Para uma desagregação detalhada de quanto renderização custa numa base por frame, veja nosso guia de custo de render farm. Estúdios considerando se renderização na nuvem se encaixa no seu orçamento conseguem também achar nosso guia sobre o que é uma render farm na nuvem útil como ponto de partida.

O Futuro da Renderização

Várias tendências estão a moldar aonde renderização se dirige a seguir.

Renderização assistida por IA está já pronta para produção. Denoisers de IA reduzem o número de amostras necessárias para uma imagem limpa, cortando tempos de renderização significativamente. NVIDIA DLSS 4, lançado ao lado da série RTX 50, usa Multi-Frame Generation para produzir múltiplos frames gerados por IA por frame nativo renderizado. Redes de upscaling reconstroem imagens de alta resolução de renderizações de baixa resolução com perda de qualidade mínima visível. Estas ferramentas não substituem os algoritmos de renderização subjacentes — aceleram-nos.

Renderização neural representa uma mudança mais fundamental. Técnicas como Neural Radiance Fields (NeRF) e 3D Gaussian Splatting treinam redes neurais para representar cenas inteiras, permitindo síntese de visão novel sem renderização tradicional baseada em geometria. Como Jensen Huang tem enfatizado em keynotes recentes, renderização neural representa uma direção importante para a indústria. Pipelines de produção actuais usam renderização neural principalmente para previsualização e layout em vez de saída de qualidade final, mas a lacuna está a fechar.

Fluxos de trabalho nativos na nuvem estão a mover renderização de uma tarefa de máquina local para um serviço integrado na nuvem. Estúdios cada vez mais enviam cenas directamente para render farms na nuvem de dentro das suas aplicações 3D em vez de exportar e carregar manualmente. Isto reduz fricção e torna renderização distribuída acessível para freelancers e pequenos estúdios, não apenas grandes instalações.

Ray tracing em tempo real continua a melhorar. Cada geração de GPU traz ray tracing de hardware mais perto de qualidade offline a taxas de frame interactivas. Para aplicações não-interactivas como archviz e visualização de produtos, motores em tempo real estão a começar a produzir resultados que anteriormente requeriam renderizadores offline.

FAQ

O que é a diferença entre renderização e modelação?

A modelação é o processo de criação da geometria 3D — as formas, superfícies e estrutura de objectos numa cena. Renderização é o que acontece após modelação: o computador calcula como a luz interage com essas superfícies para produzir uma imagem final 2D. Modelação define como a cena parece estruturalmente; renderização define como parece visualmente.

Quanto tempo leva a renderização?

Tempos de renderização variam enormemente dependendo de complexidade de cena, resolução, motor de renderização e hardware. Um shot de produto simples consegue renderizar em segundos numa GPU moderna. Um interior arquitectónico complexo com iluminação global consegue levar 20 minutos a várias horas por frame numa estação de trabalho de topo. Projectos de animação com milhares de frames frequentemente usam render farms para paralelizar a carga de trabalho e encontrar prazos.

O que é a diferença entre renderização em CPU e GPU?

Renderização em CPU usa o processador do computador e RAM do sistema, tornando-a adequada para cenas intensivas em memória com grandes datasets de textura. Renderização em GPU usa os núcleos de processamento paralelo da placa gráfica para velocidades por frame mais rápidas mas é limitada pela VRAM disponível. Muitos motores de renderização modernos suportam ambos — a escolha depende da complexidade da cena, requisitos de memória e pressão de prazos.

O que é ray tracing?

Ray tracing é uma técnica de renderização que simula luz traçando o caminho de rayos individuais da câmara através da cena. Quando rayos atingem superfícies, saltam, refractam ou dispersam — produzindo reflexões, sombras e iluminação fisicamente exactas. Path tracing estende isto seguindo rayos através de múltiplos saltos para calcular iluminação global. Ray tracing produz resultados mais realistas que rasterização mas requer mais computação.

Preciso de um computador poderoso para renderizar?

Para cenas simples e trabalho em tempo real, uma estação de trabalho de gama média com uma GPU moderna processa renderização confortavelmente. Para renderização de qualidade de produção offline — especialmente sequências de animação ou stills de alta resolução — hardware mais poderoso reduz tempos de espera significativamente. Render farms na nuvem oferecem uma alternativa: em vez de investir em hardware local caro, consegue descarregar renderização para infraestrutura remota e pagar apenas pelo tempo de computação usado.

O que é uma render farm?

Uma render farm é uma rede de computadores que trabalham em conjunto para renderizar frames em paralelo. Em vez de uma máquina renderizar uma animação de 1.000 frames sequencialmente, centenas de máquinas conseguem cada uma renderizar frames diferentes simultaneamente, reduzindo tempo total de renderização de dias para horas. Render farms conseguem ser construídas internamente ou acedidas como um serviço na nuvem. Leia nosso guia completo para render farms na nuvem para uma explicação completa.

Que formatos de ficheiro a renderização produz?

Formatos de saída comuns incluem EXR (gama dinâmica alta, standard para compositing e color grading VFX), PNG (sem perda, adequado para web e impressão), TIFF (sem perda, usado em impressão e arquivo) e JPEG (com perda, tamanho de ficheiro menor para previsualizações). Para animação, frames são tipicamente renderizados como sequências de imagem (um ficheiro por frame) em vez de ficheiros de vídeo, dando aos compositores máxima flexibilidade em pós-produção.

Consegue renderização ser feita na nuvem?

Sim. Render farms na nuvem distribuem sua carga de trabalho de renderização entre muitas máquinas remotas, entregando frames terminados sem requerer investimento de hardware local. Serviços variam de plataformas self-service onde gere suas próprias máquinas virtuais a render farms totalmente geridas que lidam com configuração de software, licenciamento e suporte. Renderização na nuvem é particularmente valiosa para projectos de animação, prazos apertados e estúdios que precisam de capacidade escalável sem manter sua própria infraestrutura.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.