Tendances VFX 2026 : temps réel, IA, Gaussian Splatting, OpenUSD et économies cloud

Aperçu

Introduction

Le VFX en 2026 est structurellement différent du VFX de 2022. Cinq évolutions remodèlent simultanément l'économie du rendu : les moteurs de rendu en temps réel franchissent le seuil du final-pixel, l'IA passe du débruitage vers l'intérieur du pipeline, le Gaussian Splatting entre dans les outils de production comme type d'asset à part entière, OpenUSD arrive à maturité en tant que standard d'échange de l'industrie, et le rendu cloud devient la solution par défaut — et non plus de secours — pour les studios en dehors du premier rang.

Au cours des dernières années, nous avons observé l'arrivée progressive de ces tendances chez Super Renders Farm. Elles ne sont plus expérimentales ; elles apparaissent dans des productions livrées, dans des sorties d'outils publiés, et dans notre propre mix de jobs. Cet article est une étude des tendances de l'industrie destinée aux décideurs de studios, aux TDs pipeline et aux artistes qui planifient où investir leur temps d'apprentissage et leur budget — non pas un comparatif de fournisseurs, ni un guide d'achat.

Tendances VFX 2026 — convergence des moteurs temps réel, du débruitage IA, du Gaussian Splatting, d'OpenUSD et du rendu cloud

Le panorama de l'industrie en 2026

L'estimation de la taille du marché VFX en 2026 varie considérablement selon le périmètre considéré. Mordor Intelligence évalue le marché combiné de l'animation et des VFX à environ 220,69 milliards USD en 2026, avec un TCAC de 11,86 % jusqu'en 2031, mais ce chiffre absorbe les longs métrages animés, les séries animées, le motion design et la visualisation. Les estimations pures VFX sont plus modestes et plus contestées : Research Nester évalue l'industrie des effets visuels à 27,59 milliards USD en 2026 ; des rapports à périmètre plus étroit avoisinent 13,23 milliards USD. L'écart méthodologique est important car les grands chiffres headline absorbent des marchés adjacents qui ne partagent pas les structures de coûts spécifiques aux VFX.

Un chiffre plus parlant pour les studios est celui de la couche rendu spécifiquement. Les analystes du secteur projettent une croissance du marché du rendu 3D d'environ 4,30 milliards USD en 2025 à 13,92 milliards USD d'ici 2031 (un TCAC d'environ 21,6 %), avec une part du rendu GPU passant d'environ 55,8 % en 2024 à environ 60 % d'ici 2026. La transition dans le mix est le signal le plus clair dans les données : la couche rendu croît plus vite que le marché VFX qui la contient, et à l'intérieur de cette couche, c'est la part GPU qui progresse le plus.

La deuxième variable est la reprise post-grèves. Les grèves de la WGA et de la SAG-AFTRA en 2023 ont réduit le volume de production en amont qui se répercutait en aval dans les pipelines des prestataires VFX pendant la majeure partie de 2024 et une partie de 2025. VFX Voice (la revue de la Visual Effects Society) caractérise l'entrée en 2026 comme un équilibre entre incertitude et opportunité — les pipelines se remplissent à nouveau, mais l'emploi en freelance reste inégal. La troisième variable est la consolidation du milieu de gamme : plusieurs structures se sont repositionnées vers les services de production virtuelle ou des divisions immersives pendant le creux, modifiant la composition des acheteurs côté render farm.

Le rendu en temps réel franchit la ligne du final-pixel

Le principal développement temps réel de 2026 est que le mur entre « temps réel pour la prévisualisation » et « rendu offline pour le final-pixel » a cessé d'en être un. VFX Voice et les médias couvrant le NAB Show 2025 caractérisent le rendu quasi en temps réel comme l'une des évolutions technologiques les plus significatives de l'industrie — au même titre que la génération d'images assistée par IA — car elle change ce qui doit être mis en file d'attente et ce qui peut être prévisualisé en direct.

Unreal Engine 5, avec sa géométrie virtualisée Nanite et son illumination globale Lumen, est la manifestation visible de cette évolution. La technique n'est pas nouvelle — StageCraft d'ILM a rendu The Mandalorian dans Unreal Engine dès 2019 pour tourner dans des environnements variés sur un plateau unique — mais en 2026, la même approche atteint les productions de second rang et les productions broadcast, pas seulement les séries streaming à gros budget. La couverture du NAB Show 2025 (ProductionHUB, VP-Land, Nitro Media Group) a placé la production virtuelle au centre du salon pour la troisième année consécutive, avec l'introduction par Sony du système de tracking de caméra sans marqueur Ocellus et des outils de compensation de couleur hors-axe Crystal LED qui réduisent sensiblement le coût d'exploitation d'un volume LED.

L'implication économique n'est pas que le rendu offline disparaît — c'est que le volume de travail éligible au temps réel a augmenté. Les plates de fond pour les effets visuels in-camera (ICVFX) sur scènes LED constituent du travail temps réel. La prévisualisation et la postvisualisation sont du travail temps réel. De plus en plus, des plans hero complets dans des publicités et des productions broadcast de budget intermédiaire sont également livrés via la Movie Render Queue d'Unreal Engine 5.

Ce qui reste en rendu offline en 2026, c'est le travail de finaux film photoréalistes où le transport lumineux par lancer de rayons, la sortie multi-couches deep-EXR et les cycles d'itération artiste par plan restent dominants. V-Ray, Arnold, Redshift et Karma continuent tous d'évoluer côté offline : V-Ray 7 a ajouté le support des Gaussian Splats par lancer de rayons (voir la section suivante), Karma XPU continue de mûrir, et les sorties Redshift 2026 se sont concentrées sur les volumes et la complexité des shaders. Ces moteurs et la pile temps réel ne sont plus en concurrence à somme nulle ; ils se positionnent sur différentes étapes du pipeline.

Côté render farm, la croissance du temps réel n'a pas réduit visiblement les volumes de rendu offline — elle en a modifié la composition. Les jobs final-pixel offline tendent vers des scènes plus complexes (volumes, compositing avec splats tracés, cheveux et vêtements en lancer de rayons) tandis que les plans plus simples qui justifiaient autrefois un temps de rendu offline migrent vers le temps réel. La render farm offline en 2026 est un moteur de complexité, non de volume. Pour la planification d'infrastructure, cela signifie que le coût par image est plus important que le débit en nœuds par seconde — développé dans notre guide du coût par image.

L'IA entre dans le pipeline

L'IA dans les VFX en 2024 était principalement un débat sur les outils génératifs aux stades du scénario et du concept. L'IA dans les VFX en 2026 est une réalité dans l'intérieur du pipeline, dans plusieurs catégories, chacune à un niveau de maturité différent.

Le débruitage IA est devenu standard. NVIDIA OptiX AI Denoiser et Intel Open Image Denoise (OIDN) sont intégrés dans tous les moteurs de rendu de production mainstream — V-Ray, Arnold, Redshift, Cycles, Karma. Intel OIDN a reçu un Technical Achievement Award de l'Academy of Motion Picture Arts and Sciences en 2025, signal de marché utile : la technologie a atteint une échelle de production répondant aux critères de l'Academy. Les rapports sectoriels et les benchmarks agrégés de render farms indiquent que les scènes qui nécessitaient historiquement 2 000 à 4 000 samples pour une sortie propre atteignent une qualité comparable à 200–500 samples avec le débruitage IA. Sur notre farm, la réduction moyenne du temps de rendu sur les jobs utilisant le débruitage IA par rapport aux jobs équivalents de 2024 convergeant uniquement par comptage de samples est de l'ordre de 40 à 60 %, selon le moteur et le type de scène. La variance est principalement due aux volumes importants ou à une profondeur de champ agressive, où les débruiteurs IA laissent encore des artefacts résiduels nécessitant un renfort par sample count.

L'IA générative en prévisualisation et concept est la deuxième catégorie. Stable Diffusion XL et Midjourney font désormais partie des cycles de lookdev en pré-production dans plusieurs studios, utilisés pour l'itération rapide de moodboards avant la modélisation 3D complète. RunwayML et des outils similaires gèrent les comps client rapides. L'intégration dans le pipeline reste ad hoc — la plupart des studios utilisent l'IA générative en parallèle plutôt que comme étape intégrée — mais le workflow s'est suffisamment stabilisé pour que nous le voyions mentionné dans les briefs clients que nous recevons.

La reconstruction image-vers-3D et NeRF/Gaussian Splatting est la troisième catégorie — passée de la curiosité de recherche à l'outil de production livré, développée en détail dans la section suivante.

L'IA pour la rotoscopie, le nettoyage de matchmove et les prévisualisations de simulation est la catégorie la plus discrètement transformatrice. Ces tâches en milieu de pipeline consommaient historiquement un temps d'artiste junior disproportionné, et les outils qui les accélèrent modifient l'économie des studios car ils libèrent des heures, non des minutes.

Ce que l'IA n'a pas fait en 2026, c'est remplacer le jugement artistique aux stades du lookdev, de la composition ou de la validation de direction artistique. Le schéma constaté dans les studios ayant adopté ces outils en premier est que les effectifs sont restés stables ou ont légèrement augmenté, tandis que le débit de production par artiste a progressé. Les studios ayant adopté le rendu cloud en parallèle avec les outils assistés par IA en 2025-2026 ont rapporté avoir complété plus de projets dans le même délai sans réduire leurs effectifs.

Le Gaussian Splatting entre dans les VFX de production

Le Gaussian Splatting — et son extension temporelle, le 4D Gaussian Splatting — est passé de la nouveauté académique à l'outil de production livré plus vite que la plupart des superviseurs de pipeline ne l'anticipaient. La technique encode une scène 3D sous forme de millions de petits Gaussiens anisotropes plutôt que de géométrie polygonale plus textures ; le résultat est une qualité visuelle photoréaliste à des vitesses de rendu en temps réel, avec des scènes rendues couramment à plus de 100 FPS dans Unreal Engine.

Début 2026, les splats disposent d'un support natif dans la pile de production : Nuke 17 est livré avec un support natif du Gaussian Splat, Houdini 21 inclut une préversion technique, OpenUSD 26.03 a ajouté un schéma de première classe, et V-Ray 7 peut désormais tracer les données de splats par lancer de rayons aux côtés de la géométrie traditionnelle. Les intégrations dans les compositing et les moteurs de rendu sont importantes car elles sortent les splats des îlots « Unreal uniquement » de production virtuelle pour les intégrer dans le pipeline VFX au sens large.

La référence de production est le travail de Framestore sur Superman (2025), où le studio a utilisé le 4D Gaussian Splatting pour livrer environ 40 plans final-pixel. C'est le premier cas largement rapporté où des splats 4D ont traité des plans qui nécessitaient auparavant une combinaison de photogrammétrie traditionnelle, de travail sur plaque et de reconstruction CG. D'autres studios ont depuis suivi publiquement sur des séries épisodiques et des travaux ICVFX.

Le contexte de marché est favorable. Les estimations du secteur placent le marché mondial de la production virtuelle à environ 2,9 milliards USD en 2025 avec des projections vers 18,5 milliards USD d'ici 2035, et le Gaussian Splatting est largement caractérisé comme une méthode privilégiée pour créer les environnements photoréalistes qui alimentent les scènes à volume LED. DJI Terra V5.0+ Flagship traite les reconstructions en Gaussian Splatting à environ 500 images par heure sur du matériel de station de travail ; les décors de qualité cinématographique nécessitent généralement 300 à 1 000+ images issues d'un reflex numérique ou d'un drone. Le temps de capture sur set vers l'asset est passé de plusieurs jours de numérisation manuelle à moins d'une heure pour de nombreux environnements.

Pour les render farms, les splats introduisent un profil de coût par image différent. Les scènes polygonales s'adaptent de manière prévisible au nombre de samples et à la complexité des shaders ; les scènes tracées par splats ont un profil de bande passante mémoire plus proche du rendu volumétrique — la VRAM est plus importante, et des moteurs comme V-Ray 7 font encore évoluer rapidement leurs chemins de traçage des splats. Nous le traitons opérationnellement comme une classe de jobs nécessitant des benchmarks séparés, non comme « juste un autre type de géométrie ».

Pipeline Gaussian Splatting — capture drone ou reflex → reconstruction → lecture temps réel Unreal Engine + compositing V-Ray 7 par lancer de rayons

OpenUSD comme standard d'échange de l'industrie

La Universal Scene Description (USD) de Pixar, open-sourcée en 2016, est candidate lente au statut de standard depuis près d'une décennie. En 2026, le terme « candidat » n'est plus approprié. L'Alliance for OpenUSD (AOUSD), fondée par Pixar avec Adobe, Apple, Autodesk et NVIDIA en 2023, est en bonne voie pour formaliser les spécifications fondamentales d'OpenUSD d'ici fin 2025, et le SIGGRAPH 2024 a démontré l'extension d'OpenUSD au-delà des médias et du divertissement traditionnels vers la robotique, la simulation de véhicules autonomes et la visualisation industrielle.

La mise à jour technique la plus importante pour les opérateurs de render farm est l'ajout du support Vulkan au moteur de rendu Hydra Storm d'OpenUSD (annoncé dans OpenUSD 24.08, contribué par Pixar, Autodesk et Adobe sous l'égide de l'AOUSD, selon les rapports du Khronos Group). HgiVulkan aligne l'interface Hydra avec les backends OpenGL et Metal existants et étend USD/Hydra aux appareils mobiles Android, ouvrant une cible de plateforme plus large sans sacrifier l'empreinte existante Mac/Linux/Windows.

Ce que cela signifie concrètement :

- L'échange d'assets entre DCCs (Maya, Houdini, Cinema 4D, Blender, 3ds Max) est matériellement moins fragile qu'en se reposant sur FBX ou les exports par DCC. Nous constatons moins de tickets de support « transform cassé » d'année en année à mesure que les studios consolident sur USD comme format d'échange.

- L'interopérabilité entre moteurs de rendu s'améliore — les délégués de rendu Hydra de V-Ray, Karma, Arnold, Cycles et autres sont de plus en plus viables pour le lookdev interactif et le rendu par lots, bien que la parité avec la description de scène native de chaque moteur varie selon les moteurs.

- L'investissement dans l'outillage pipeline se déplace des importeurs/exporteurs par DCC vers des systèmes de publication d'assets natifs USD. Les studios qui ont construit une infrastructure USD en 2023-2024 en récoltent les économies opérationnelles ; ceux qui ne l'ont pas fait la traitent comme une priorité d'investissement pour 2026-2027.

OpenUSD ne résout pas tous les problèmes d'échange en 2026 — la traduction des textures et matériaux entre les délégués Hydra reste imparfaite, et les extensions par moteur créent des risques d'enfermement propriétaire qu'OpenUSD était censé éliminer. La tendance est néanmoins sans ambiguïté : USD est le consensus sur le format d'asset que l'industrie n'avait pas vraiment il y a dix ans.

Économies du rendu cloud pour les studios indépendants et intermédiaires

La troisième évolution discrètement transformatrice de 2026 concerne le côté des coûts. Le rendu cloud en 2024 était présenté principalement comme une capacité de débordement pour les studios disposant de leurs propres render walls. En 2026, c'est l'infrastructure par défaut pour les équipes indépendantes et une part croissante des studios intermédiaires — non pas comme plan de secours, mais comme cœur de leur pipeline.

Trois forces conduisent ce changement :

La volatilité des prix GPU côté matériel. L'NVIDIA RTX 5090 a été lancé à 1 999 USD prix fabricant, mais les prix de vente réels en 2026 ont oscillé entre 2 500 et 3 800 USD en raison des pénuries de mémoire GDDR7 et de la demande en calcul IA qui déplace l'offre grand public. Pour un petit studio construisant un nœud de rendu à huit GPU, ce différentiel multiplié par le nombre de cartes, plus carte mère, alimentation, refroidissement et rack, a déstabilisé le modèle économique d'investissement en calcul GPU auto-hébergé.

La compression des prix GPU cloud côté opex. Les prix GPU cloud ont baissé plus vite que les prix des cartes de détail, en particulier chez les fournisseurs de second rang. La couverture sectorielle cite Thunder Compute à environ 0,66 USD par GPU-heure A100 contre 4,10 USD sur les clouds de premier rang. Cet écart est plus large qu'il y a 18 mois, réduisant le fossé d'accès à l'infrastructure entre les grands et les petits studios sur l'itération en temps réel et le débit de frames finaux.

Le débruitage IA comprimant le volume de calcul nécessaire. C'est le facteur le plus sous-estimé. Si un job d'archviz qui nécessitait 4 000 samples en 2023 n'en nécessite plus que 500 avec le débruitage IA, la facture cloud pour ce job est environ 8 fois moins élevée pour la même qualité — ce qui modifie sensiblement le point d'équilibre cloud-vs-sur site.

Le point d'équilibre existe toujours. Les render walls locaux sont économiquement rentables au-delà d'environ 400+ heures de rendu par mois de volume élevé constant, où le coût horaire du matériel possédé descend sous les tarifs cloud. En dessous de ce seuil, le cloud présente un avantage de coût structurel. Nous avons développé la formule détaillée dans notre analyse du coût total build-versus-cloud et notre guide des tarifs.

Ce qui est nouveau en 2026, c'est la distribution des studios de chaque côté de cette courbe. La ligne des 400 heures séparait autrefois « freelance/indépendant » de « petit studio ». Elle sépare désormais de plus en plus « petit studio » de « studio intermédiaire » car davantage de petits studios sont passés à une infrastructure cloud-first. Les studios intermédiaires et grands continuent de construire une infrastructure hybride : calcul propre pour la charge de base prévisible et cloud pour les pics.

Le levier opérationnel le plus important est de savoir si le cloud choisi est entièrement géré ou Infrastructure-as-a-Service (IaaS). Les pipelines semblent superficiellement similaires mais le temps d'artiste par job diffère sensiblement — développé dans notre analyse entièrement géré vs DIY.

Sur notre farm, nous exploitons plus de 20 000 cœurs CPU (nœuds Dual Intel Xeon E5-2699 V4 avec 96-256 Go de RAM) et une flotte GPU dédiée de cartes NVIDIA RTX 5090 avec 32 Go de VRAM chacune, avec Cinema 4D + Redshift, V-Ray, Corona, Arnold, Octane et Cycles pré-installés et licenciés au niveau de la plateforme. En tant que partenaire de rendu officiel Chaos et partenaire officiel Maxon, les licences V-Ray, Corona et Redshift sont incluses plutôt que gérées par l'utilisateur. L'enjeu n'est pas la fiche technique — c'est que le modèle opérationnel (sans bureau à distance, sans gestion d'installation, sans contention de serveur de licences) est ce qui détermine si le rendu cloud économise réellement du temps aux artistes, quel que soit le fournisseur.

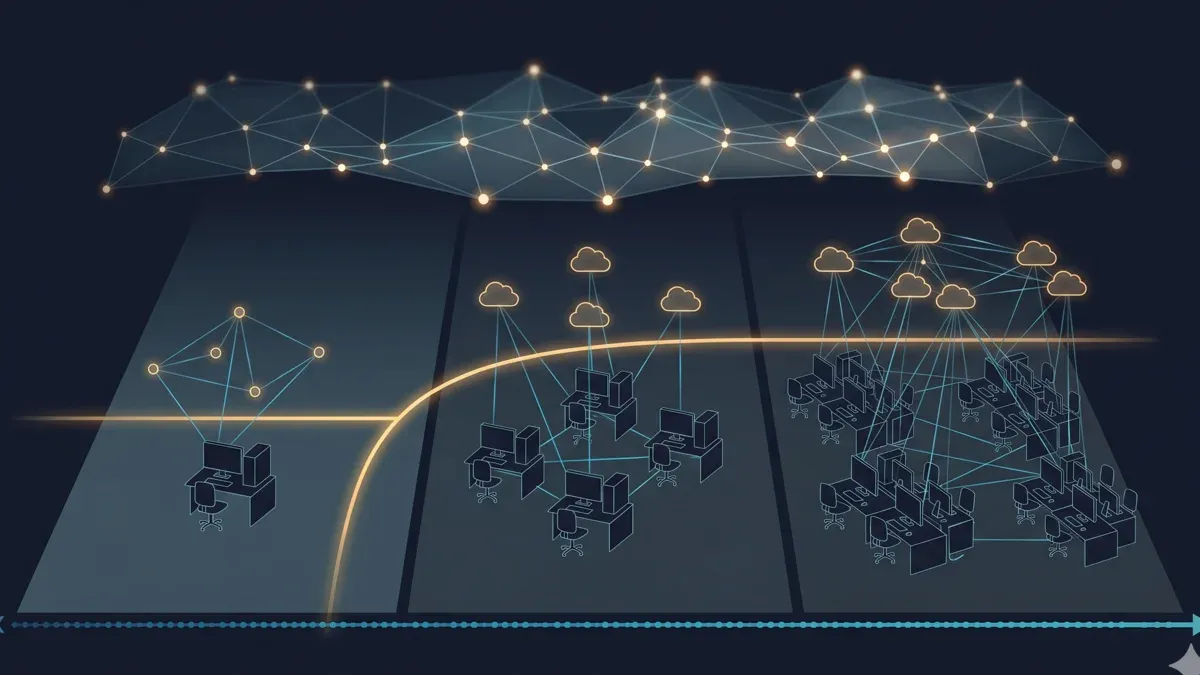

Cadre de décision pour le rendu cloud en 2026 — heures par mois vs taille de studio vs choix entièrement géré ou IaaS

Ce que ces tendances signifient pour les studios en 2026

Lire les cinq tendances comme une image unique plutôt que cinq histoires séparées change les conclusions stratégiques.

La formation pipeline a convergé. Il y a trois ans, un TD planifiant la formation de son équipe devait choisir entre approfondir Maya/Houdini, apprendre Unreal Engine, construire un outillage USD ou investir dans l'intégration de workflows IA. En 2026, ce ne sont plus des voies distinctes — un TD pipeline compétent a besoin d'une maîtrise opérationnelle dans les quatre, et il en va de même pour l'artiste senior lookdev/éclairage dont le travail couvre désormais les finaux path-tracés offline, le lookdev temps réel et les passes de lookdev assistées par IA.

L'architecture de calcul est devenue plus hétérogène, non moins. Le discours de 2020 affirmait que le rendu GPU remplacerait le rendu CPU. La réalité de 2026 est que le CPU détient encore environ 70 % de notre mix de jobs de rendu, tandis que le GPU gagne des parts pour les travaux Redshift, Octane, V-Ray GPU et Gaussian Splatting. Un plan matériel qui mise sur l'un ou l'autre sera sous-dimensionné quelque part.

La render farm offline est passée du volume à la complexité. Les studios qui alignent cela avec leur planification d'infrastructure — cloud burst pour les finaux path-tracés tandis que l'itération temps réel et assistée par IA se fait en interne — bénéficient des deux couches. Les studios qui tentent de faire passer chaque plan par un mode soit purement offline, soit purement temps réel finissent par payer pour un modèle et utiliser l'autre.

Les studios indépendants et intermédiaires ont rattrapé leur retard en accès à l'infrastructure. La barrière pour produire un travail VFX photoréaliste et complexe en 2026 est de plus en plus la compétence et la maturité du pipeline, non l'accès aux GPU. Les grandes structures ne peuvent plus s'appuyer sur l'avantage de puissance de calcul brute comme rempart, et les studios indépendants peuvent dépasser leur poids en classe matérielle avec la discipline opérationnelle adéquate.

Le temps réel et l'offline coexistent comme des outils différents, non comme un schéma successeur. Le discours de l'industrie présente souvent le temps réel comme le remplacement éventuel de l'offline ; cinq ans de données probantes suggèrent que ce n'est pas la trajectoire. Le temps réel a élargi le travail qu'il prend en charge ; l'offline a élargi la complexité qu'il prend en charge ; les deux progressent. Planifiez pour une hétérogénéité compositionnelle plutôt que pour une transition vers une seule pile.

FAQ

Q: Quelles sont les principales tendances de l'industrie VFX en 2026 ? A: Cinq évolutions remodèlent l'industrie : le rendu en temps réel franchissant le seuil du final-pixel (Unreal Engine 5 et production virtuelle), l'IA passant du débruitage vers des tâches intérieures au pipeline comme la prévisualisation générative et la rotoscopie, le Gaussian Splatting entrant dans les outils VFX de production comme type d'asset de première classe, OpenUSD arrivant à maturité en tant que standard d'échange de l'industrie, et le rendu cloud devenant l'infrastructure par défaut pour les studios indépendants et intermédiaires plutôt qu'une capacité de débordement pour les grandes structures.

Q: Comment l'IA modifie-t-elle le pipeline de rendu VFX en 2026 ? A: L'IA en 2026 est présente à l'intérieur du pipeline de production à plusieurs stades. Le débruitage IA (OptiX, Intel Open Image Denoise) est standard dans V-Ray, Arnold, Redshift, Cycles et Karma, réduisant les comptages de samples nécessaires d'environ 2 000-4 000 à 200-500 pour une qualité comparable. Les outils IA génératifs comme Stable Diffusion XL et RunwayML sont intégrés dans le lookdev de pré-production et les comps client. La reconstruction image-vers-3D et Gaussian Splatting a quitté le stade de la recherche pour rejoindre les outils de production livrés. La rotoscopie assistée par IA, le nettoyage de matchmove et les prévisualisations de simulation compriment discrètement la partie médiane du pipeline.

Q: Unreal Engine 5 est-il utilisé pour le rendu final-pixel en 2026 ? A: Oui — la Movie Render Queue d'Unreal Engine 5 livre des plans final-pixel pour les effets visuels in-camera sur volumes LED, les productions broadcast et commerciales de budget intermédiaire, et une part croissante de contenu épisodique et théâtral. La technique a été pionnière avec StageCraft d'ILM sur The Mandalorian en 2019 et s'est déployée vers le bas de gamme depuis. Le travail de finaux film photoréaliste qui exige le transport lumineux par lancer de rayons, la sortie multi-couches deep-EXR et l'itération par plan continue de fonctionner principalement sur des moteurs de rendu offline comme V-Ray, Arnold, Redshift et Karma — le temps réel et l'offline se positionnent sur différentes étapes du pipeline, sans se remplacer mutuellement.

Q: Qu'est-ce que le Gaussian Splatting et pourquoi est-ce important pour les VFX en 2026 ? A: Le Gaussian Splatting encode une scène 3D sous forme de millions de petits Gaussiens anisotropes plutôt que de géométrie polygonale plus textures, produisant une qualité visuelle photoréaliste à des vitesses de rendu en temps réel (100+ FPS dans Unreal Engine). Début 2026, Nuke 17 est livré avec un support natif des splats, Houdini 21 inclut une préversion technique, OpenUSD 26.03 a ajouté un schéma de première classe, et V-Ray 7 peut tracer les données de splats par lancer de rayons aux côtés de la géométrie traditionnelle. Framestore a utilisé le 4D Gaussian Splatting pour livrer environ 40 plans final-pixel sur Superman (2025). Le temps de capture sur set vers l'asset est passé de plusieurs jours à moins d'une heure pour de nombreux environnements.

Q: Comment OpenUSD transforme-t-il les pipelines de studios en 2026 ? A: OpenUSD (Universal Scene Description), open-sourcé par Pixar en 2016, se consolide en tant que standard d'échange de l'industrie. L'Alliance for OpenUSD — Pixar, Adobe, Apple, Autodesk, NVIDIA, fondée en 2023 — est en bonne voie pour formaliser les spécifications fondamentales d'OpenUSD d'ici fin 2025. Le support Vulkan a été ajouté au moteur de rendu Hydra Storm dans OpenUSD 24.08, étendant la plateforme à une gamme d'appareils plus large incluant Android. L'échange d'assets entre Maya, Houdini, Cinema 4D, Blender et 3ds Max est matériellement moins fragile que de s'appuyer sur FBX, et l'interopérabilité entre moteurs de rendu via les délégués de rendu Hydra s'améliore d'année en année.

Q: Les studios indépendants et intermédiaires devraient-ils utiliser le rendu cloud en 2026 ? A: Pour la plupart des charges de travail en dessous d'environ 400 heures de rendu par mois de volume constant, le rendu cloud présente un avantage de coût structurel par rapport à la construction et la maintenance d'un render wall local — et cette ligne continue de remonter à mesure que les prix GPU cloud baissent et que le débruitage IA comprime les comptages de samples nécessaires. Le levier le plus important pour l'économie du studio est de savoir si le cloud choisi est entièrement géré (sans bureau à distance, sans gestion d'installation, licences gérées au niveau de la plateforme) ou Infrastructure-as-a-Service (IaaS). Au-delà de 400 heures de volume mensuel constant, les modèles hybrides — calcul propre pour la charge de base et cloud pour les pics — surpassent généralement l'un ou l'autre extrême.

Q: Comment les grèves hollywoodiennes de 2023 ont-elles affecté les perspectives VFX pour 2026 ? A: Les grèves de la WGA et de la SAG-AFTRA en 2023 ont réduit le volume de production en amont qui se répercutait en aval dans les pipelines des prestataires VFX pendant la majeure partie de 2024 et une partie de 2025. VFX Voice caractérise l'entrée en 2026 comme un équilibre entre incertitude et opportunité — les pipelines se remplissent à nouveau grâce aux projets de streaming et théâtraux, mais l'emploi en freelance et sous contrat reste inégal, en particulier dans les clusters britanniques et de Vancouver qui ont absorbé les suppressions d'emplois les plus importantes. Plusieurs structures intermédiaires se sont repositionnées vers les services de production virtuelle ou des divisions immersives pour diversifier leurs revenus, modifiant structurellement la composition des acheteurs que les opérateurs de render farm servent.

Q: Quel matériel de rendu les studios devraient-ils planifier pour 2026 ? A: Planifiez pour l'hétérogénéité. Le rendu CPU détient toujours la majorité du volume de jobs de rendu de production — visualisation architecturale avec V-Ray et Corona, animation avec Arnold, et pipelines où la mémoire par thread est plus importante que les FLOPS bruts — tandis que le GPU gagne des parts pour les travaux Redshift, Octane, V-Ray GPU et Gaussian Splatting. Les prix de vente au détail de l'NVIDIA RTX 5090 ont oscillé entre 2 500 et 3 800 USD en 2026 en raison des pénuries de GDDR7 et de la demande en calcul IA, déstabilisant le modèle économique d'investissement en calcul GPU auto-hébergé pour les petits studios. Les prix GPU cloud chez les fournisseurs de second rang ont significativement baissé (la couverture sectorielle cite environ 0,66 USD par GPU-heure A100 contre 4,10 USD sur les clouds de premier rang), réduisant le fossé d'accès à l'infrastructure entre les grands et les petits studios.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.