Was ist Rendering? Ein vollständiger Leitfaden zu Rendering in der Computergrafik

Überblick

Was ist Rendering in der Computergrafik?

Jedes Bild, das du in einem Pixar-Film siehst, jeder Frame einer Architektur-Animation und jede Explosion in einem Videospiel hat eines gemeinsam: Rendering. Im Kern ist Rendering der Prozess, bei dem dreidimensionale Szenendaten — Geometrie, Materialien, Beleuchtung und Kamerainformationen — in ein zweidimensionales Bild umgewandelt werden, das Menschen auf einem Bildschirm sehen oder ausdrucken können.

Stell dir das vor wie Fotografie, aber vollständig virtuell. Ein traditioneller Fotograf arrangiert eine Szene, positioniert eine Kamera, passt die Beleuchtung an und drückt auf den Auslöser. Rendering folgt der gleichen Logik: Ein 3D-Artist erstellt eine digitale Szene, platziert eine virtuelle Kamera, definiert Lichtquellen und instruiert dann den Computer, das Bild zu „machen". Der Unterschied besteht darin, dass jedes Photon Licht, jede Oberflächenreflexion und jeder Schatten mathematisch berechnet werden müssen, anstatt optisch erfasst zu werden.

Rendering kommt in fast jeder visuellen Branche vor. Filmstudios nutzen es, um photorealistische Charaktere und Umgebungen zu schaffen. Architekturbüros produzieren Kundenpräsentationen, die von Fotografien nicht zu unterscheiden sind. Spieleentwickler generieren Millionen von Frames pro Sekunde, um das Gameplay flüssig zu halten. Medizinische Forscher visualisieren komplexe anatomische Strukturen. Produktdesigner iterieren über Prototypen, ohne eine einzige physische Einheit herzustellen.

Dieser Leitfaden erklärt, wie Rendering funktioniert, welche Hauptverfahren beteiligt sind, welche Software es antreibt, und was passiert, wenn eine einzelne Workstation nicht mehr ausreicht.

Echtzeit-Rendering vs. Offline-Rendering

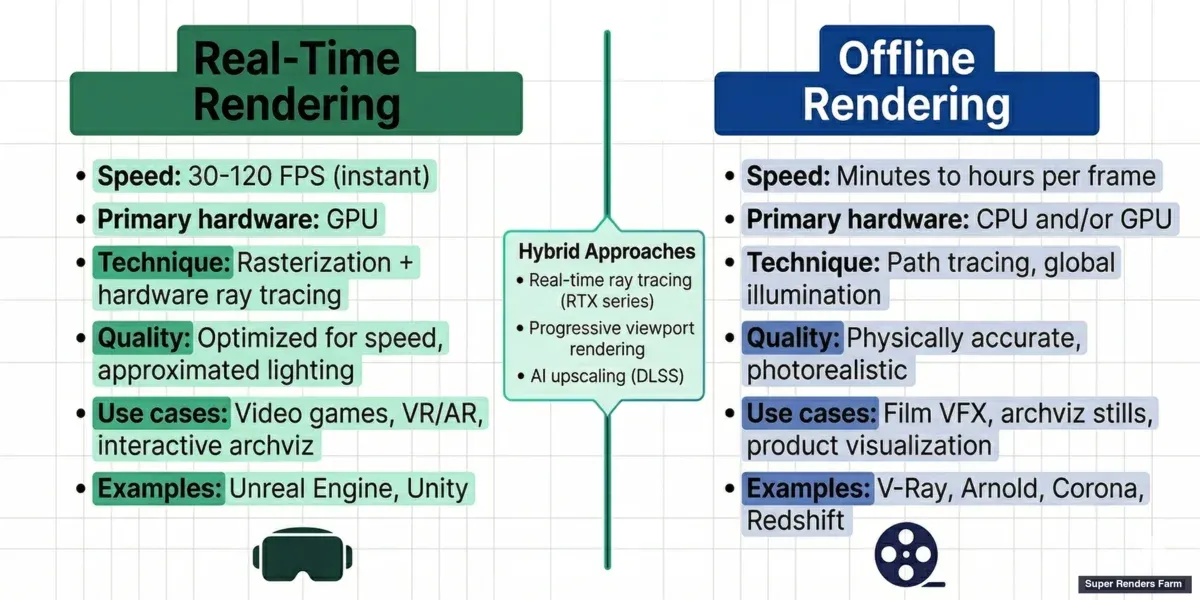

Rendering unterteilt sich in zwei grundlegende Paradigmen basierend auf Geschwindigkeitsanforderungen: Echtzeit und Offline.

Echtzeit-Rendering erzeugt Bilder schnell genug für interaktive Nutzung — typischerweise 30 bis 120 Bilder pro Sekunde. Videospiele, Virtual Reality, Augmented Reality und interaktive Architektur-Visualisierungen hängen alle vom Echtzeit-Rendering ab. Die GPU übernimmt den Großteil der Berechnung und verwendet optimierte Algorithmen, die Geschwindigkeit über absolute physikalische Genauigkeit priorisieren. Technologien wie Rasterisierung (Projektion von 3D-Dreiecken auf einen 2D-Bildschirm) und hardwarebeschleunigtes Ray Tracing (eingeführt mit NVIDIAs RTX-Architektur) machen dies möglich.

Offline-Rendering (auch Pre-Rendering genannt) priorisiert Bildqualität über Geschwindigkeit. Ein einzelner Frame kann Minuten, Stunden oder sogar Tage dauern, um berechnet zu werden. Spielfilme, Broadcast-Animation, Architektur-Standbilder und Produktvisualisierung verwenden typischerweise Offline-Rendering. Das Ziel ist Photorealismus oder ein spezifischer künstlerischer Look, und die zusätzliche Berechnungszeit ermöglicht physikalisch genaue Lichtsimulation — Globale Beleuchtung, Kaustiken, Subsurface Scattering und Volumeneffekte, die Echtzeit-Engines approximieren, aber nicht vollständig replizieren können.

Hybrid-Ansätze werden zunehmend häufiger. Echtzeit-Ray Tracing auf modernen GPUs (NVIDIA RTX-Serie, AMD RDNA 3+) bringt einige Offline-Qualitätseffekte in interaktive Workflows. Progressives Rendering in Viewport-Vorschaubildern — verfügbar in Engines wie V-Ray und Redshift — lässt Künstler ein ungefähres Ergebnis in Sekunden sehen, das sich im Laufe der Zeit verfeinert. KI-gestützte Techniken wie NVIDIA DLSS verwenden neuronale Netze, um Lower-Resolution-Renders hochzuskalieren und multiplizieren die Performance effektiv ohne proportionalen Qualitätsverlust.

Real-time rendering vs offline rendering comparison — speed, quality, and use cases for games, film, and architecture

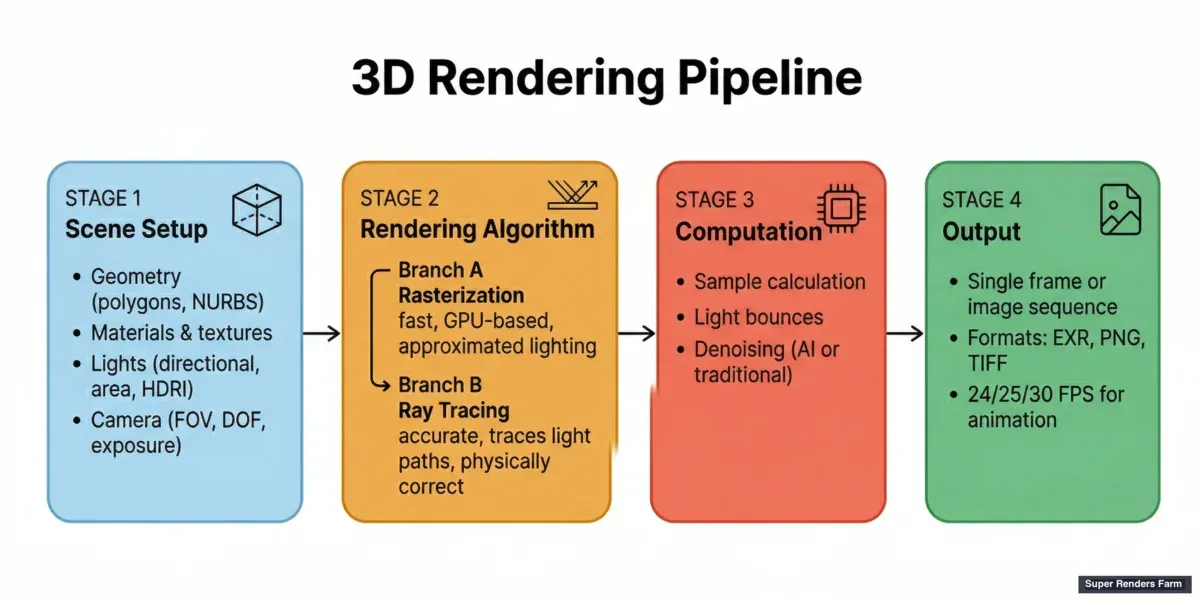

So funktioniert Rendering: Die technische Pipeline

Das Verständnis der Rendering-Pipeline hilft dabei, zu demystifizieren, was zwischen dem Klick auf „Rendern" und dem Sehen eines fertigen Bildes passiert.

Szenenvorbereitung ist der erste Schritt. Der Artist definiert Geometrie (die 3D-Formen — Polygone, NURBS, Subdivision Surfaces), wendet Materialien und Texturen an (wie Oberflächen aussehen — Farbe, Reflektivität, Rauheit, Transparenz), platziert Lichter (direktional, Punkt, Area, Umgebungskarten) und positioniert eine virtuelle Kamera (Sichtfeld, Schärfentiefe, Belichtung).

Der Rendering-Algorithmus verarbeitet diese Szene dann. Die zwei dominanten Algorithmusfamilien sind:

Rasterisierung projiziert jedes 3D-Dreieck in der Szene auf den 2D-Bildschirm und bestimmt, welche Pixel es abdeckt und welche Farbe diese Pixel haben sollten. Sie ist extrem schnell — moderne GPUs können Milliarden von Dreiecken pro Sekunde rasterisieren — aber sie behandelt indirekte Beleuchtung und Reflexionen durch Approximationen (Schattenkarten, Screen-Space-Reflexionen, Licht-Sonden). Rasterisierung treibt praktisch alle Echtzeit-Rendering an.

Ray Tracing simuliert Licht genauer, indem es den Weg einzelner Strahlen von der Kamera durch jeden Pixel in die Szene verfolgt. Wenn ein Strahl eine Oberfläche trifft, kann er abprallen, brechen oder streuen und sekundäre Strahlen erzeugen, die mit anderen Objekten interagieren. Path Tracing ist eine spezifische Form von Ray Tracing, die Strahlen durch viele Sprünge verfolgt, um ein physikalisch genaues Ergebnis zu erreichen. Ray Tracing behandelt Reflexionen, Brechungen, weiche Schatten und globale Beleuchtung natürlich, erfordert aber deutlich mehr Berechnung.

Andere Techniken existieren für spezifische Anwendungsfälle. Radiosity berechnet den Lichtenergietransfer zwischen Oberflächen und eignet sich hervorragend für weiche, diffuse Zwischenreflexionen in Architektur-Szenen. Photon Mapping behandelt Kaustiken (die fokussierten Lichtmuster, die du am Boden eines Schwimmbeckens siehst) effizienter als reines Path Tracing.

Ausgabe ist der letzte Schritt. Ein einzelnes gerendertes Bild wird Frame genannt. Bei Animation erzeugt der Renderer eine Sequenz von Frames — typischerweise 24, 25 oder 30 pro Sekunde für Film und Broadcast, oder höher für Slow-Motion-Arbeiten. Ausgabeformate umfassen EXR (hoher dynamischer Bereich, Industriestandard für VFX-Compositing), PNG (verlustfrei, geeignet für Standbilder), TIFF und JPEG.

3D rendering pipeline diagram — scene setup, rendering algorithm, and output stages

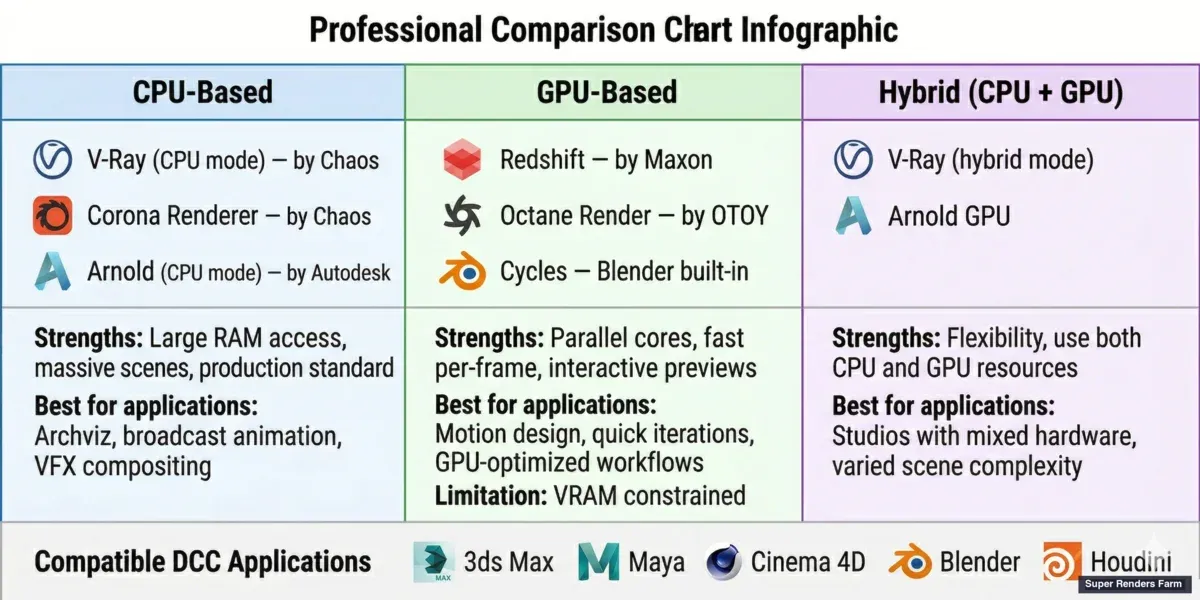

Render-Engines: Die Software, die die Arbeit leistet

Eine Render-Engine ist die Softwarekomponente, die den Rendering-Algorithmus ausführt. Die meisten 3D-Anwendungen werden mit einem eingebauten Renderer geliefert, unterstützen aber auch Third-Party-Engines, die spezialisierte Funktionen bieten.

CPU-basierte Render-Engines laufen hauptsächlich auf dem Prozessor. Sie können große Mengen an System-RAM nutzen, was sie für Szenen mit massiver Geometrie oder großen Texturdatensätzen geeignet macht. Beispiele sind V-Ray (CPU-Modus), Corona Renderer und Arnold. V-Ray und Corona werden von Chaos entwickelt, während Arnold ein Autodesk-Produkt ist. CPU-Rendering ist seit Jahrzehnten der Produktionsstandard und bleibt das Arbeitspferd für Architektur-Visualisierung, Broadcast-Animation und VFX-Compositing.

GPU-basierte Render-Engines laufen auf der Grafikkarte und nutzen die Tausenden paralleler Kerne der GPU, um das Rendering dramatisch zu beschleunigen. Redshift (ein Maxon-Produkt), Octane Render, V-Ray GPU und Cycles (Blenders eingebaute Engine) fallen alle in diese Kategorie. GPU-Rendering ist typischerweise schneller pro Frame, wird aber durch verfügbaren VRAM begrenzt — Szenen, die den GPU-Speicher überschreiten, müssen auf Out-of-Core-Rendering oder CPU-Verarbeitung zurückfallen.

Hybrid-Engines können sowohl CPU- als auch GPU-Ressourcen nutzen. V-Ray bietet beispielsweise sowohl CPU- als auch GPU-Rendering-Modi und kann sie in einem einzigen Render kombinieren. Arnold hat auch GPU-Unterstützung in neueren Versionen hinzugefügt.

CPU vs GPU render engines comparison — V-Ray, Corona, Arnold, Redshift, Octane, and Cycles

Diese Engines verbinden sich mit großen 3D-Anwendungen: Autodesk 3ds Max, Autodesk Maya, Maxon Cinema 4D, Blender und SideFX Houdini. Die Wahl der Engine hängt von den Anforderungen des Projekts ab — Geschwindigkeit, Qualität, Speicherplatz und Pipeline-Kompatibilität. Für einen tieferen Vergleich der V-Ray-Performance auf verschiedenen 3D-Hosts siehe unseren V-Ray für Blender vs. 3ds Max Vergleich.

Häufige Rendering-Herausforderungen

Auch mit leistungsstarker Hardware und ausgereifter Software stellen sich beim Rendering wiederkehrende Herausforderungen in der Produktion.

Lange Renderzeiten sind der universellste Engpass. Ein einzelner Frame eines komplexen Architektur-Interiors mit Globaler Beleuchtung, hochauflösenden Texturen und detaillierter Vegetation (Forest Pack, RailClone) kann 20 Minuten bis mehrere Stunden auf einer High-End-Workstation dauern. Multipliziert mit Tausenden von Frames für eine Animation wird eine einzelne Maschine schnell unpraktisch. Unser Renderzeit-Optimierungsleitfaden behandelt praktische Techniken, um Render-Zeiten pro Frame zu reduzieren, ohne Qualität zu opfern.

Speicherlimitierungen beschränken, was eine Szene enthalten kann. GPU-Rendering ist besonders anfällig für VRAM-Limits — eine Szene, die bequem in 64 GB System-RAM passt, kann auf einer GPU mit 24 GB VRAM fehlschlagen. Displacement Maps, High-Poly-Vegetation, Partikelsysteme und 8K+-Texturen tragen alle zum Speicherdruck bei. Das Verständnis des Unterschieds zwischen GPU- und CPU-Rendering hilft bei der Planung einer Pipeline.

Rauschen und Artefakte entstehen, wenn der Renderer nicht genug Lichtproben berechnet hat. Path Tracing erzeugt Rauschen, das abnimmt, wenn mehr Proben berechnet werden, aber ein sauberes Ergebnis erfordert Zeit. Denoisers — sowohl traditionell (z. B. Intel Open Image Denoise) als auch KI-gestützt (NVIDIA OptiX, V-Rays eingebauter Denoiser) — können sichtbares Rauschen reduzieren, ohne die vollständige Probenanzahl zu benötigen, aber aggressives Denoising kann feine Details verwischen.

Farbmanagement stellt sicher, dass gerenderte Bilder über verschiedene Anzeigen hinweg und in Compositing konsistent aussehen. ACES (Academy Color Encoding System) ist zur Standard-Farb-Pipeline in Film und High-End-Visualisierung geworden, während sRGB für Web- und Spielausgabe weit verbreitet bleibt.

Für eine umfassende Fehlerbeseitigungsreferenz behandelt unser Leitfaden zu häufigen Rendering-Problemen und Lösungen die Probleme, auf die Produktionsteams am häufigsten stoßen.

Renderfarms: Skalierung des Rendering über eine einzelne Maschine hinaus

Wenn die Rendering-Anforderungen eines Projekts das übersteigen, was eine einzelne Workstation liefern kann — Tausende von Animations-Frames, eine enge Deadline oder Szenen zu komplex für lokale Hardware — ist der nächste Schritt eine Renderfarm.

Eine Renderfarm ist eine Sammlung von vernetzten Computern (sogenannte Nodes), die Rendering-Arbeit untereinander aufteilen. Anstatt dass eine Maschine 100 Stunden für das sequenzielle Rendering von 1.000 Frames benötigt, kann eine Farm mit 100 Nodes die gleiche Aufgabe in etwa 1 Stunde abschließen, indem Frames parallel gerendert werden. Dieses Konzept des verteilten Rendering ist, wie Studios aller Größen Produktionsdeadlines erfüllen, ohne Hunderte von Maschinen auf einmal zu kaufen.

Es gibt zwei Hauptansätze. Das Bauen einer privaten Renderfarm bedeutet, deine eigene Hardware zu kaufen, zu beherbergen und zu warten — eine Option, die Sinn macht für Studios mit konsistenten, hochvolumigen Rendering-Anforderungen und technischem Personal zur Verwaltung der Infrastruktur. Cloud-Renderfarms bieten die gleiche parallele Rendering-Kapazität als Service: Du uploadst deine Szene, die Farm rendert sie über viele Nodes gleichzeitig, und du downloadest die fertigen Frames. Keine Hardware-Anschaffung, keine Wartung, keine untätigen Maschinen zwischen Projekten. Für eine umfassendere Erklärung des Cloud-basierten Rendering siehe unseren Cloud Rendering Leitfaden.

Cloud-Renderfarms selbst kommen in zwei Modellen. Self-Service (IaaS) Farms geben dir Remote-Zugang zu virtuellen Maschinen — du installierst Software, verwaltest Lizenzen und behebst Probleme selbst. Vollständig verwaltete Farms kümmern sich um die gesamte Pipeline: Software-Installation, Plugin-Kompatibilität, Lizenz-Management und technischer Support. Du uploadst eine Szenendatei, konfigurierst Render-Einstellungen und erhältst fertige Frames. Für mehr über diese Unterschiede siehe unseren Vergleich von vollständig verwaltete vs. DIY-Renderfarms.

Super Renders Farm arbeitet als vollständig verwaltete Cloud-Renderfarm und unterstützt große Render-Engines — V-Ray, Corona, Arnold, Redshift, Octane und Cycles — über 3ds Max, Maya, Cinema 4D, Blender, Houdini, After Effects und NukeX. Als offizieller Chaos und Maxon Render-Partner umfasst SuperRenders lizenziertes Rendering für unterstützte Engines ohne zusätzliche Kosten. Die Infrastruktur läuft auf 20.000+ CPU-Kernen und einer dedizierten GPU-Fleet mit NVIDIA RTX 5090 (32 GB VRAM pro Karte) und bearbeitet sowohl CPU-intensive Architektur-Visualisierungsarbeitslasten als auch GPU-beschleunigte Motion-Design-Pipelines.

Für eine detaillierte Aufschlüsselung der Rendering-Kosten auf pro-Frame-Basis siehe unseren Renderfarm-Kostenleitfaden. Studios, die erwägen, ob Cloud Rendering in ihr Budget passt, werden möglicherweise auch unseren Leitfaden zu was eine Cloud-Renderfarm ist als Ausgangspunkt hilfreich finden.

Die Zukunft des Rendering

Mehrere Trends gestalten die Richtung des Rendering.

KI-gestütztes Rendering ist bereits produktionsreif. KI-Denoisers reduzieren die Anzahl der Proben, die für ein sauberes Bild benötigt werden, und senken die Renderzeiten erheblich. NVIDIAs DLSS 4, das zusammen mit der RTX 50-Serie veröffentlicht wurde, nutzt Multi-Frame Generation, um mehrere KI-generierte Frames pro nativ gerendertem Frame zu produzieren. Hochskalierungs-Netzwerke rekonstruieren hochauflösende Bilder aus Lower-Resolution-Renders mit minimalem sichtbarem Qualitätsverlust. Diese Tools ersetzen nicht die zugrundeliegenden Rendering-Algorithmen — sie beschleunigen sie.

Neural Rendering stellt eine grundlegendere Verschiebung dar. Techniken wie Neural Radiance Fields (NeRF) und 3D Gaussian Splatting trainieren neuronale Netze, um ganze Szenen zu repräsentieren und ermöglichen Novel-View-Synthese ohne traditionelles geometriebasiertes Rendering. Wie Jensen Huang in jüngsten Keynotes betont hat, stellt Neural Rendering eine wichtige Richtung für die Branche dar. Aktuelle Produktions-Pipelines nutzen Neural Rendering hauptsächlich für Previsualisierung und Layout anstelle der endgültigen Ausgabe, aber die Lücke schließt sich.

Cloud-native Workflows verschieben das Rendering von einer Local-Machine-Aufgabe zu einem integrierten Cloud-Service. Studios senden zunehmend Szenen direkt zu Cloud-Renderfarms von innerhalb ihrer 3D-Anwendungen, anstatt sie manuell zu exportieren und hochzuladen. Dies reduziert Reibung und macht verteiltes Rendering für Freelancer und kleine Studios zugänglich, nicht nur für große Einrichtungen.

Echtzeit-Path-Tracing verbessert sich weiter. Jede GPU-Generation bringt Hardware-Ray-Tracing näher an Offline-Qualität bei interaktiven Frame-Raten. Bei nicht-interaktiven Anwendungen wie Archviz und Produktvisualisierung beginnen Echtzeit-Engines, Ergebnisse zu produzieren, die zuvor Offline-Renderer erforderten.

FAQ

Was ist der Unterschied zwischen Rendering und Modellierung?

Modellierung ist der Prozess, die 3D-Geometrie zu erstellen — die Formen, Oberflächen und Struktur von Objekten in einer Szene. Rendering ist, was nach der Modellierung passiert: Der Computer berechnet, wie Licht mit diesen Oberflächen interagiert, um ein finales 2D-Bild zu produzieren. Modellierung definiert, wie die Szene strukturell aussieht; Rendering definiert, wie sie visuell aussieht.

Wie lange dauert Rendering?

Renderzeiten variieren enorm abhängig von Szenenkomplexität, Auflösung, Render-Engine und Hardware. Ein einfacher Produktshot kann auf einer modernen GPU in Sekunden gerendert werden. Ein komplexes Architektur-Interior mit Globaler Beleuchtung kann 20 Minuten bis mehrere Stunden pro Frame auf einer High-End-Workstation dauern. Animations-Projekte mit Tausenden Frames nutzen oft Renderfarms, um die Arbeitsauslastung zu parallelisieren und Deadlines zu erfüllen.

Was ist der Unterschied zwischen CPU- und GPU-Rendering?

CPU-Rendering nutzt den Prozessor und System-RAM des Computers und eignet sich für speicherintensive Szenen mit großen Texturdatensätzen. GPU-Rendering nutzt die parallelen Verarbeitungskerne der Grafikkarte für schnellere Pro-Frame-Geschwindigkeiten, wird aber durch verfügbaren VRAM begrenzt. Viele moderne Render-Engines unterstützen beide — die Wahl hängt von Szenenkomplexität, Speicheranforderungen und Termindruck ab.

Was ist Ray Tracing?

Ray Tracing ist eine Rendering-Technik, die Licht simuliert, indem sie den Weg einzelner Strahlen von der Kamera durch die Szene verfolgt. Wenn Strahlen Oberflächen treffen, prallen sie ab, brechen oder streuen — was physikalisch genaue Reflexionen, Schatten und Beleuchtung erzeugt. Path Tracing erweitert dies, indem es Strahlen durch viele Sprünge verfolgt, um Globale Beleuchtung zu berechnen. Ray Tracing erzeugt realistischere Ergebnisse als Rasterisierung, erfordert aber mehr Berechnung.

Brauche ich einen leistungsstarken Computer zum Rendern?

Für einfache Szenen und Echtzeit-Arbeit verarbeitet eine Mid-Range-Workstation mit einer modernen GPU das Rendering bequem. Für Production-Qualität-Offline-Rendering — besonders Animations-Sequenzen oder hochauflösende Standbilder — reduziert leistungsstärkere Hardware Wartezeiten erheblich. Cloud-Renderfarms bieten eine Alternative: Anstatt in teure lokale Hardware zu investieren, kannst du das Rendering in Remote-Infrastruktur auslagern und zahlst nur für die verwendete Rechenzeit.

Was ist eine Renderfarm?

Eine Renderfarm ist ein Netzwerk von Computern, die zusammenarbeiten, um Frames parallel zu rendern. Anstatt dass eine Maschine eine 1.000-Frame-Animation sequenziell rendert, können Hunderte Maschinen gleichzeitig unterschiedliche Frames rendern, wodurch die Gesamtrenderzeit von Tagen auf Stunden reduziert wird. Renderfarms können im Haus gebaut oder als Cloud-Service zugegriffen werden. Lies unseren vollständigen Leitfaden zu Cloud-Renderfarms für eine vollständige Erklärung.

Welche Dateiformate produziert Rendering?

Häufige Ausgabeformate umfassen EXR (hoher dynamischer Bereich, Standard für VFX-Compositing und Farbbearbeitung), PNG (verlustfrei, geeignet für Web und Druck), TIFF (verlustfrei, verwendet beim Druck und in Archiven) und JPEG (verlustbehaftet, kleinere Dateigröße für Vorschauen). Bei Animation werden Frames typischerweise als Bildsequenzen (eine Datei pro Frame) anstelle von Videodateien gerendert, was Composern maximale Flexibilität in der Post-Produktion gibt.

Kann Rendering in der Cloud durchgeführt werden?

Ja. Cloud-Renderfarms verteilen deine Rendering-Arbeitsauslastung über viele Remote-Maschinen, liefern fertige Frames ohne lokale Hardware-Investitionsanforderung. Services reichen von Self-Service-Plattformen, bei denen du deine eigenen virtuellen Maschinen verwaltest, bis zu vollständig verwalteten Farms, die Software-Setup, Lizenzierung und Support handhaben. Du uploadst eine Szenendatei, konfigurierst Render-Einstellungen und erhältst fertige Frames. Cloud Rendering ist besonders wertvoll für Animations-Projekte, enge Deadlines und Studios, die skalierbare Kapazität ohne Wartung ihrer eigenen Infrastruktur benötigen.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.