Comment rendre une animation dans Blender : guide complet pour les artistes 3D

Aperçu

Introduction

Rendre une seule image dans Blender est simple. Rendre une animation — des centaines ou des milliers d'images avec une qualité constante, sans scintillement et avec des temps de rendu gérables — représente un défi tout à fait différent. Chaque inefficacité dans vos paramètres de rendu est multipliée par le nombre d'images, et les problèmes invisibles sur un plan fixe (bruit temporel, scintillement de la lumière, fuites mémoire) deviennent évidents en mouvement.

Nous rendons des animations Blender quotidiennement sur notre ferme de rendu, et les problèmes que nous observons le plus souvent se résument aux mêmes erreurs : mauvais format de sortie, nombre de samples non optimisé, denoising qui introduit des artefacts temporels, et mémoire qui augmente image par image jusqu'à ce que le job plante. Ce guide présente l'ensemble du processus de configuration et de rendu d'une animation dans Blender 4.x, des premiers paramètres de rendu jusqu'à la sortie finale — que vous rendiez localement ou que vous envoyiez des images à une ferme de rendu cloud.

Les exemples utilisent Blender 4.2 LTS avec Cycles, bien que nous couvrions les workflows Eevee le cas échéant. Si vous avez besoin d'une référence approfondie sur les paramètres de rendu individuels, notre guide d'optimisation des paramètres de rendu Blender couvre chaque panneau en détail.

Choisir votre moteur de rendu pour l'animation

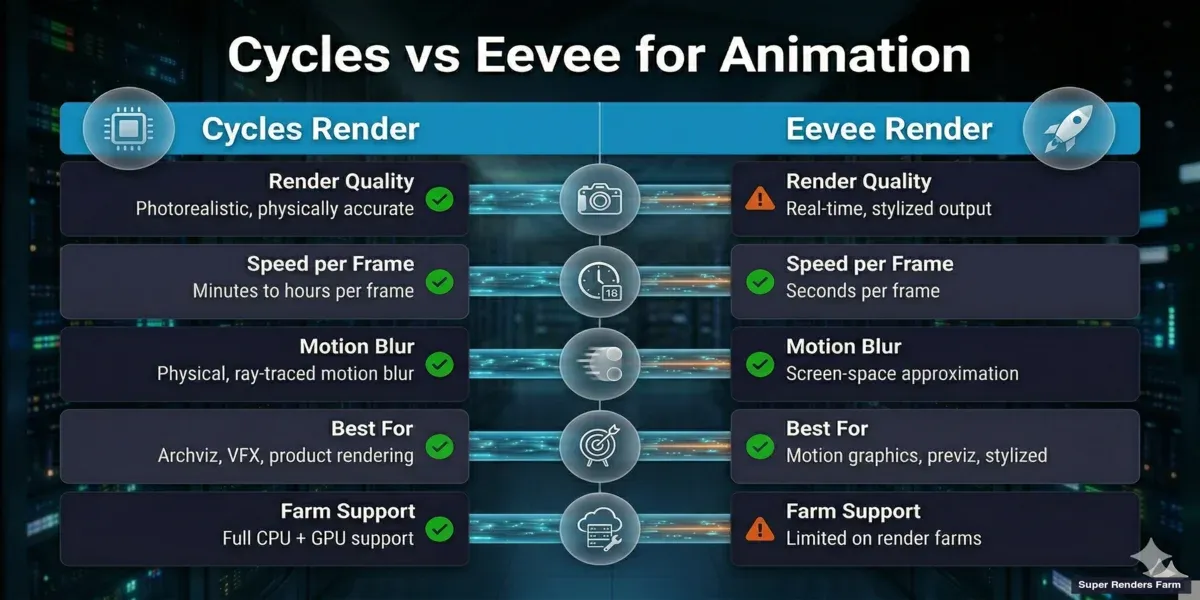

Blender est livré avec deux moteurs de production : Cycles (lancer de rayons) et Eevee (rastérisation). Les deux peuvent rendre des animations, mais ils ont des forces différentes pour le travail en mouvement.

Cycles est le choix privilégié pour l'animation photoréaliste. Il gère l'éclairage complexe, les réflexions, la volumétrie et le flou de mouvement de façon physique — ce qui signifie que vous obtenez des résultats corrects sans rien simuler artificiellement. La contrepartie est le temps de rendu. Une seule image Cycles peut prendre de 2 à 30 minutes selon la complexité, une animation de 300 images pouvant donc prendre entre 10 heures et plusieurs jours sur une seule machine.

Eevee (Eevee Next dans Blender 4.x) rend à des vitesses quasi temps réel grâce à la rastérisation. Il est excellent pour le motion design, l'animation stylisée et le previz. Eevee convient aux animations où le photoréalisme absolu n'est pas requis — séquences de titres, boucles abstraites, survols architecturaux où la vitesse importe plus que la précision du lancer de rayons. Le manuel Blender couvre les deux moteurs en détail.

Quand utiliser lequel :

| Scénario | Moteur recommandé |

|---|---|

| Visite architecturale (photoréaliste) | Cycles |

| Plateau tournant produit avec réflexions/caustiques | Cycles |

| Motion design / séquence de titres | Eevee |

| Animation de personnage (look stylisé) | Eevee |

| Plaques de compositing VFX | Cycles |

| Previz rapide avant le rendu final | Eevee, puis Cycles pour les finals |

| Animation longue durée (1 000+ images, délai serré) | Cycles sur une ferme de rendu |

Un workflow courant que nous observons : les artistes itèrent sur le timing et les mouvements de caméra avec Eevee (quelques secondes par image), puis passent à Cycles pour le rendu final. Cela économise des heures d'attente pendant la phase créative.

Infographie de comparaison — Cycles vs Eevee pour le rendu d'animation dans Blender

Configurer le rendu de votre animation

Avant de cliquer sur Render Animation, configurez ces paramètres essentiels dans le panneau Output Properties.

Plage d'images

Définissez votre image de début et votre image de fin dans Output Properties > Format. Blender utilise par défaut les images 1 à 250. Pour le travail en production, calquez ces valeurs exactement sur votre timeline — rendre des images supplémentaires est une perte de temps, et des images manquantes signifient un nouveau rendu.

Le paramètre Frame Step rend chaque N-ième image. Le régler sur 2 rend les images 1, 3, 5, 7... ce qui est utile pour les rendus de test afin de vérifier le timing à la moitié du coût. Réinitialisez toujours à 1 pour les rendus finals.

Cadence d'images

Faites correspondre au format de livraison cible de votre projet :

| Cas d'utilisation | Cadence |

|---|---|

| Film / cinématique | 24 fps |

| Diffusion européenne (PAL) | 25 fps |

| Diffusion nord-américaine (NTSC) | 30 fps |

| Vidéo web / YouTube | 24 ou 30 fps |

| Ralenti (rendu à vitesse normale) | 60 fps |

| Cinématiques de jeux vidéo | 30 ou 60 fps |

Définissez ceci dans Output Properties > Format > Frame Rate. Modifier la cadence après avoir posé des images clés nécessite un recalage temporel — définissez-la avant de commencer l'animation.

Résolution

Définissez votre résolution de sortie finale dans Output Properties > Format. Résolutions de production courantes :

- 1920 × 1080 (Full HD) — standard pour la plupart des livraisons

- 2560 × 1440 (2K) — de plus en plus courant pour le web

- 3840 × 2160 (4K UHD) — livraison haut de gamme, 4 fois plus de pixels que le HD

Utilisez le curseur Resolution Percentage (100 % par défaut) pour effectuer des rendus de test à résolution réduite. Rendre à 50 % donne un quart des pixels — bien plus rapide pour vérifier la composition et le timing.

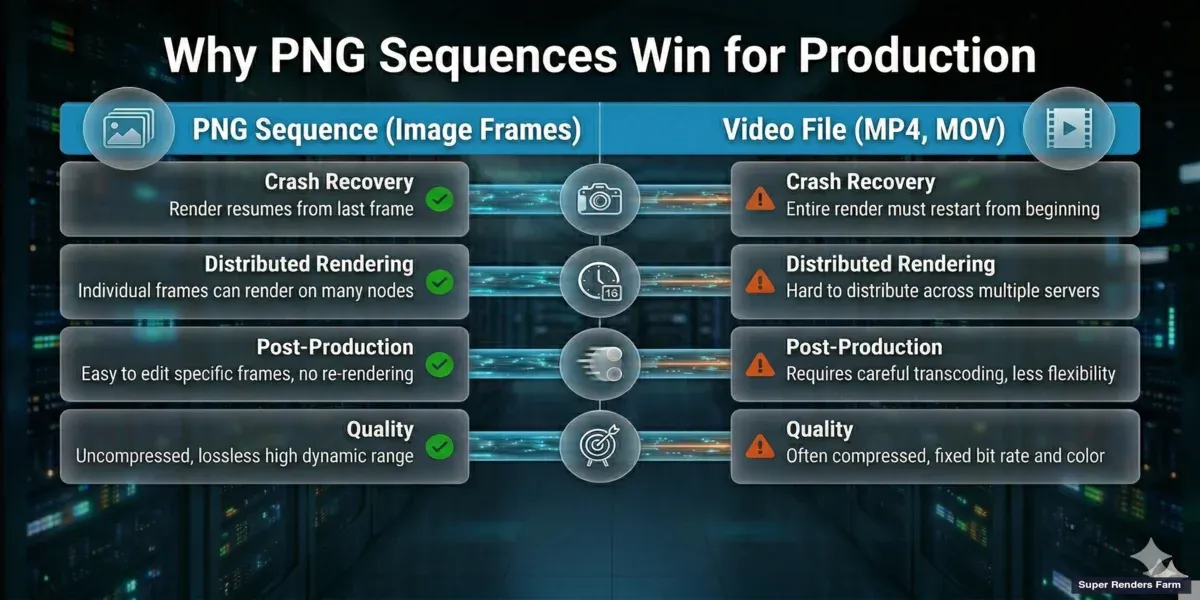

Format de sortie : séquence PNG vs fichier vidéo

C'est l'une des décisions les plus importantes pour le rendu d'animation, et la réponse est presque toujours : rendez vers une séquence d'images PNG, pas vers un fichier vidéo.

Pourquoi les séquences PNG sont préférées en production :

-

Reprise après crash. Si Blender plante à l'image 847 d'une animation de 1 200 images, vous avez 846 images terminées. Modifiez votre image de début à 847 et reprenez. Avec un fichier vidéo, un crash signifie recommencer — le fichier entier peut être corrompu.

-

Rendu distribué. Les fermes de rendu répartissent votre animation sur de nombreuses machines. La machine A rend les images 1 à 100, la machine B les images 101 à 200, etc. Chaque machine écrit des fichiers image individuels. Cela est impossible avec un seul conteneur vidéo.

-

Flexibilité en post-production. Les séquences d'images sont importées image par image dans les logiciels de compositing (After Effects, Nuke, DaVinci Resolve), permettant un étalonnage colorimétrique non destructif, un recalage temporel et des effets. Vous pouvez également remplacer des images défectueuses individuelles sans re-rendre l'intégralité de la séquence.

-

Aucune perte de qualité. Le PNG est sans perte. Les codecs vidéo comme H.264 sont avec perte — ils compriment les images et introduisent des artefacts, en particulier dans les zones à détails fins ou à dégradés subtils.

Quand la sortie vidéo est acceptable : Aperçus rapides, rendus de test, brouillons pour les réseaux sociaux où la commodité l'emporte sur la qualité. Utilisez FFmpeg (conteneur vidéo) avec un codec rapide pour ces cas.

Paramètres de sortie recommandés :

| Paramètre | Valeur | Pourquoi |

|---|---|---|

| Format de fichier | PNG | Sans perte, universel, sécurisé en cas de crash |

| Mode couleur | RGBA | Préserve la transparence pour le compositing |

| Profondeur de couleur | 16 bits | Plus de latitude pour l'étalonnage |

| Compression | 15 % | Bon équilibre taille/vitesse d'écriture |

| Chemin de sortie | //render/project-name/frame_#### | Relatif au fichier .blend, organisé |

Infographie comparant la séquence d'images PNG et la sortie vidéo pour le rendu d'animation Blender

Pour les workflows OpenEXR (compositing VFX avec passes de rendu), définissez le format de fichier sur OpenEXR Multilayer. Cela intègre toutes les passes de rendu (diffuse, brillance, ombre, brume, cryptomatte) dans un seul fichier par image — indispensable pour les pipelines de compositing professionnels. Consultez notre guide des workflows EXR et Cryptomatte pour plus de détails.

Optimiser les paramètres de rendu Cycles pour l'animation

Le rendu d'animation multiplie chaque inefficacité. Un paramètre qui ajoute 30 secondes par image ajoute 2,5 heures à une animation de 300 images. Voici comment optimiser Cycles spécifiquement pour le travail d'animation.

Sampling et sampling adaptatif

Cycles dans Blender 4.x utilise le sampling adaptatif par défaut. Au lieu de rendre un nombre fixe de samples par pixel, il arrête de sampler les pixels qui ont déjà convergé — les zones lumineuses bien éclairées convergent rapidement tandis que les coins sombres et les caustiques nécessitent davantage de samples.

Pour l'animation, configurez :

- Render Samples : Utilisez ce paramètre comme limite supérieure. 256 à 512 est une bonne plage pour la plupart des scènes avec le denoising activé. Les intérieurs complexes peuvent nécessiter 1 024.

- Noise Threshold : 0,01 est un bon défaut. Des valeurs inférieures (0,005) produisent des images plus propres mais augmentent le temps de rendu. Pour l'animation, la cohérence entre les images importe plus que la propreté absolue — un niveau de bruit uniforme est mieux géré par le denoising, tandis que des niveaux variables causent un effet de « nage » visible dans la vidéo finale.

- Min Samples : Maintenez à 32 ou plus pour éviter que le sampling adaptatif ne prenne des raccourcis sur les premiers pixels. Des valeurs inférieures à 16 peuvent causer des artefacts dans les zones en dégradé.

Denoising pour l'animation

Le denoising est essentiel pour l'animation — il permet de rendre avec moins de samples tout en maintenant la qualité visuelle. Mais tous les denoisers ne gèrent pas l'animation de la même façon.

- OpenImageDenoise (OIDN) : Basé sur CPU, inclus avec Blender. Produit d'excellents résultats et est l'option la plus stable pour l'animation. Un comportement cohérent image par image minimise le scintillement temporel. Utilisez-le par défaut.

- OptiX Denoiser : Basé sur GPU (NVIDIA uniquement). Plus rapide qu'OIDN mais peut produire des résultats légèrement différents d'une image à l'autre, ce qui peut causer un léger scintillement dans les animations. Plus adapté aux rendus de prévisualisation où la vitesse prime.

Pour l'animation en production, nous recommandons : OIDN avec le paramètre de qualité « Accurate », appliqué comme passe de rendu (pas viewport). Activez-le dans Render Properties > Sampling > Denoise. Assurez-vous que la passe Denoising Data est activée dans View Layer Properties > Passes > Data — cela fournit au denoiser des informations supplémentaires (passes normale et albedo) pour de meilleurs résultats.

Chemins de lumière

Les paramètres de chemins de lumière contrôlent le nombre de rebonds des rayons dans votre scène. Pour l'animation :

- Rebonds totaux : 8 à 12 pour la plupart des scènes. Les intérieurs architecturaux avec de nombreuses surfaces réfléchissantes peuvent nécessiter 12 à 16.

- Rebonds de transparence : Augmentez à 16 à 32 si votre scène comporte du verre empilé, des rideaux ou des matériaux translucides superposés. Des rebonds de transparence insuffisants causent des artefacts noirs qui scintillent dans l'animation.

- Rebonds de volume : N'augmentez au-dessus de 0 que si vous avez du brouillard volumétrique, de la fumée ou du feu. Chaque rebond de volume augmente significativement le temps de rendu.

Flou de mouvement

Cycles gère le flou de mouvement de façon physique — il échantillonne la scène à plusieurs moments dans l'intervalle d'obturation de chaque image. C'est précis mais coûteux.

- Shutter : 0,5 est standard (obturateur à 180 degrés). Des valeurs supérieures à 1,0 créent un flou exagéré. Des valeurs inférieures à 0,25 peuvent ne pas produire de flou visible à 24 fps.

- Steps : Contrôle la qualité du flou de mouvement. La valeur par défaut (1) fonctionne pour les mouvements simples. Augmentez à 3 à 5 pour les objets se déplaçant rapidement ou ayant une déformation complexe.

- Position : « Center on Frame » est le standard. « Start on Frame » décale la direction du flou.

Si le flou de mouvement ajoute plus de 30 % à votre temps de rendu, envisagez de rendre sans lui et de l'ajouter en post-production à l'aide d'une passe vecteur — exportez la passe de rendu Vector et appliquez un flou directionnel dans votre logiciel de compositing.

Gestion de la mémoire pour les animations longues

Les problèmes de mémoire sont la cause la plus fréquente d'échec des rendus d'animation. Une scène qui rend l'image 1 sans problème peut planter à l'image 400 car la mémoire augmente avec le temps.

Pourquoi la mémoire augmente pendant le rendu d'animation :

- Mise en cache des textures : Blender met les textures en cache en mémoire. Les textures animées ou les textures procédurales qui changent par image accumulent des données en cache.

- Systèmes de particules : Les simulations de cheveux, tissu et fluide stockent l'état par image. Les longues simulations peuvent consommer des gigaoctets.

- Historique d'annulation : Blender conserve par défaut les étapes d'annulation en mémoire. Pour le rendu, cela ne sert à rien.

Comment prévenir les plantages mémoire :

- Cuire les simulations avant de rendre. Cuisez les systèmes de particules, de tissu, de fluide et de corps rigides sur disque. Cela empêche Blender de recalculer la physique à chaque image et maintient la mémoire prévisible.

- Réduire les étapes d'annulation. Dans Preferences > System, réduisez Undo Steps à 0 pendant le rendu. Cela libère la mémoire qui s'accumulerait autrement.

- Utiliser Persistent Images (Render Properties > Performance). Cela maintient les données de texture en mémoire entre les images au lieu de les recharger — cela peut sembler contre-intuitif, mais cela empêche la fragmentation de la mémoire qui cause des fuites progressives.

- Activer le rendu CPU + GPU (Cycles). Dans Preferences > System > Cycles Render Devices, activez à la fois CPU et GPU. Cela répartit la charge de travail et peut prévenir le débordement de la mémoire GPU sur les scènes complexes. Consultez notre guide rendu GPU vs CPU pour savoir quand cela est pertinent.

- Rendre par blocs. Si vous rendez localement sur une machine avec peu de RAM, divisez votre animation en blocs (images 1 à 100, 101 à 200, etc.) et redémarrez Blender entre les blocs. Cela efface la mémoire accumulée.

Rendre des animations Blender sur une ferme de rendu

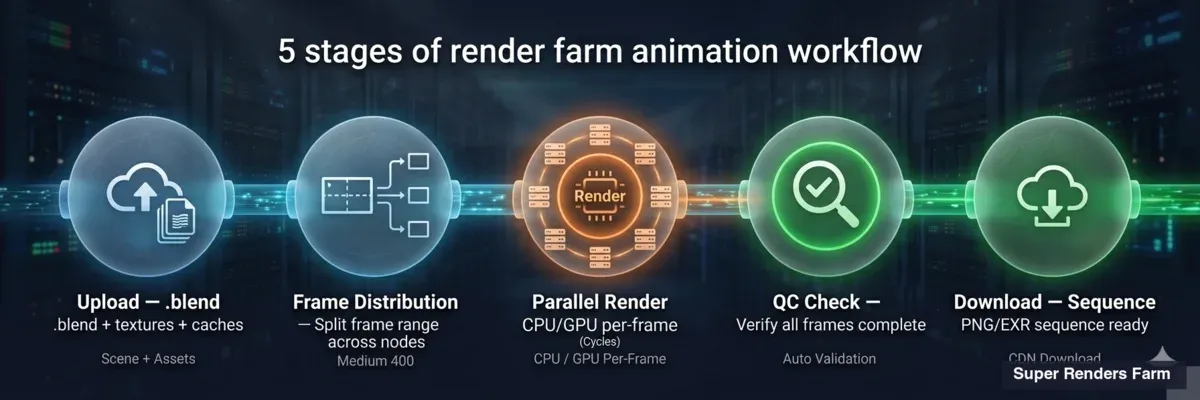

Pour les animations de plus de quelques centaines d'images, le rendu local est souvent peu pratique. Une animation Cycles de 500 images à 5 minutes par image prend 42 heures sur une seule machine. Sur une ferme de rendu, ces 500 images se répartissent sur des dizaines de machines et sont terminées en quelques heures plutôt qu'en jours.

Diagramme de pipeline montrant le workflow de ferme de rendu pour les animations Blender — upload, distribution, rendu, téléchargement

Comment fonctionne le rendu sur ferme pour les animations :

- Vous uploadez votre fichier .blend et tous les assets liés (textures, caches, HDRIs) via l'outil de soumission de la ferme.

- La ferme répartit votre plage d'images sur les machines disponibles. Chaque machine rend ses images assignées indépendamment.

- Les images terminées sont uploadées dans votre dossier de téléchargement sous forme de fichiers PNG ou EXR — un fichier par image.

- Vous téléchargez la séquence complète et l'assemblez localement.

C'est précisément pour cette raison que les séquences PNG sont importantes. Chaque machine écrit des fichiers d'images individuels. Il n'y a pas de conteneur vidéo unique susceptible d'être corrompu.

Ce que nous supportons pour Blender sur notre ferme :

- Cycles (CPU et GPU) : Support complet. Le rendu CPU utilise notre flotte de 20 000+ cœurs. Le rendu GPU utilise des cartes NVIDIA RTX 5090 avec 32 Go de VRAM — suffisant pour la plupart des scènes de production. Nous incluons automatiquement la licence Blender (Blender est open source, donc aucun coût de licence).

- Eevee : Support limité sur les fermes de rendu. Eevee dépend fortement du contexte GPU et de l'état du viewport d'une manière qui rend le rendu distribué peu fiable. Il fonctionne pour certaines scènes, mais nous recommandons Cycles pour les soumissions sur ferme. Si votre projet nécessite Eevee, testez d'abord une petite plage d'images.

Préparer votre fichier .blend pour la soumission sur ferme :

- Empaqueter les fichiers externes. Allez dans File > External Data > Pack Resources. Cela intègre les textures et HDRIs dans le fichier .blend pour qu'ils soient correctement transférés à la ferme.

- Cuire toutes les simulations. Les caches de particules, tissu et fluide doivent être cuits et sauvegardés — les machines de la ferme ne peuvent pas exécuter votre simulation depuis le début.

- Définir la sortie sur PNG ou EXR. Ne définissez jamais la sortie sur un format vidéo lors de la soumission à une ferme — chaque machine essaierait d'écrire dans le même fichier vidéo.

- Supprimer les objets viewport uniquement. Désactivez ou supprimez les objets utilisés uniquement pour la référence viewport (empties avec images d'arrière-plan, meshes de guidage). Ils gaspillent de la mémoire sur les machines de la ferme.

- Tester 3 images. Rendez localement des images depuis le début, le milieu et la fin de votre timeline pour vérifier les paramètres avant d'uploader. Cela détecte les problèmes qui gaspilleraient des crédits de rendu.

Pour un guide détaillé sur les tarifs et la soumission, consultez notre page de tarifs et le guide de ferme de rendu Blender.

Rendre plusieurs angles de caméra

De nombreux projets d'animation nécessitent des rendus depuis plusieurs angles de caméra — visites architecturales avec différents points de vue, plateaux tournants de produits avec gros plans et plans larges, ou plaques VFX depuis plusieurs caméras virtuelles.

Blender supporte cela grâce aux configurations multi-caméras basées sur les scènes et au rendu par lots Python. Plutôt que de dupliquer l'intégralité de la scène, vous créez des copies de scène liées qui partagent la géométrie mais référencent différentes caméras actives. Un script Python itère ensuite à travers les scènes et rend chacune séquentiellement.

Cette approche fonctionne bien à la fois sur les machines locales et sur les fermes de rendu. Sur une ferme, chaque angle de caméra peut être soumis comme un job séparé, rendant tous les angles en parallèle. Nous couvrons la configuration complète dans notre guide sur le rendu de plusieurs caméras dans Blender.

Problèmes courants de rendu d'animation

Scintillement entre les images

Le scintillement est généralement causé par un nombre insuffisant de samples dans les zones à éclairage complexe. Le sampling adaptatif peut converger différemment d'une image à l'autre, créant des variations de luminosité visibles. Solution : augmentez Min Samples à 64, resserrez Noise Threshold à 0,005, et assurez-vous que le denoising est activé. Pour les scènes riches en fireflies (pics de pixels lumineux dus aux caustiques), activez la valeur Clamp Indirect à 10 — cela plafonne la luminosité des chemins de lumière indirects.

Artefacts de denoising dans le mouvement

Les denoisers IA peuvent produire des résultats légèrement différents par image, causant un effet de texture « bouillonnante » ou « nageante » dans des zones qui devraient être statiques. Solution : utilisez OpenImageDenoise (OIDN) plutôt qu'OptiX pour les rendus finals. OIDN est plus temporellement cohérent. Assurez-vous également de rendre les passes Denoising Data (albedo + normale) — sans elles, le denoiser a moins d'informations et produit des résultats moins stables.

Plantages mémoire sur les images tardives

Si le rendu échoue à l'image N mais que l'image 1 se rend normalement, la mémoire s'accumule probablement. Consultez la section Gestion de la mémoire ci-dessus. Le coupable le plus courant est les simulations non cuites — cuisez tout sur disque avant de rendre.

Le rendu d'animation diffère de l'aperçu viewport

Cela se produit généralement parce que les paramètres viewport et rendu divergent. Vérifiez : la résolution de rendu vs la résolution viewport, les samples de rendu vs les samples viewport, et la caméra de rendu vs la caméra viewport. Le rendu utilise toujours la caméra active définie dans Scene Properties > Camera — pas la caméra à travers laquelle vous regardez dans le viewport.

La sortie de rendu écrase les images précédentes

Si votre chemin de sortie n'inclut pas un espace réservé de numéro d'image (####), Blender écrase le même fichier à chaque image. Assurez-vous que votre chemin de sortie se termine par quelque chose comme frame_#### — le #### est remplacé par le numéro d'image (complété à 4 chiffres).

Assembler votre vidéo finale

Après avoir rendu votre séquence PNG ou EXR, vous devez l'encoder dans un fichier vidéo pour la livraison.

Utiliser l'éditeur de séquence vidéo (VSE) de Blender :

- Ouvrez un nouveau fichier Blender (ou passez à l'espace de travail Video Editing).

- Dans le Sequencer, allez dans Add > Image/Sequence. Naviguez vers votre dossier de rendu et sélectionnez toutes les images.

- Définissez la résolution de sortie et la cadence pour correspondre à vos paramètres de rendu.

- Définissez Output sur FFmpeg Video, conteneur MP4, codec H.264, qualité d'encodage Haute ou Sans perte.

- Render Animation (Ctrl+F12) — cela encode la séquence dans une vidéo.

Utiliser FFmpeg directement (plus rapide, sans interface) :

ffmpeg -framerate 24 -i frame_%04d.png -c:v libx264 -crf 18 -pix_fmt yuv420p output.mp4

-framerate 24: correspondre à la cadence de votre projet-crf 18: qualité (plus bas = meilleur, 18 est visuellement sans perte)-pix_fmt yuv420p: assure la compatibilité avec la plupart des lecteurs

Pour une livraison professionnelle, rendez en ProRes (pour la remise en montage) ou DNxHR (pour la diffusion) plutôt qu'en H.264.

FAQ

Q: Quel format de sortie utiliser pour rendre des animations dans Blender ? A: La séquence d'images PNG est le format recommandé pour le rendu d'animation en production. Le PNG est sans perte, permet la reprise après crash (vous conservez toutes les images rendues avant un crash), et est compatible avec les workflows de ferme de rendu où plusieurs machines rendent des images simultanément. Encodez en H.264 ou ProRes uniquement comme étape de livraison finale.

Q: Comment réduire le temps de rendu pour les animations Blender ? A: Activez le sampling adaptatif avec un Noise Threshold de 0,01, utilisez OpenImageDenoise pour permettre des comptes de samples inférieurs (256 à 512 au lieu de 2 048+), réduisez les rebonds de chemins de lumière selon la complexité de votre scène, et rendez à la résolution minimale requise. Pour les grands projets, utiliser une ferme de rendu avec des milliers de cœurs CPU peut réduire des jours de rendu à quelques heures.

Q: Puis-je rendre des animations Eevee sur une ferme de rendu ? A: Eevee a un support limité sur les fermes de rendu car il dépend du contexte GPU et de l'état du viewport qui ne se transfère pas toujours proprement entre machines. Cycles est le moteur recommandé pour le rendu sur ferme. Si votre projet nécessite Eevee, testez d'abord une petite plage d'images sur la ferme pour vérifier la compatibilité avant de vous engager dans un rendu complet.

Q: Pourquoi mes images d'animation Blender scintillent-elles ? A: Le scintillement est typiquement causé par le sampling adaptatif qui converge différemment par image, produisant des niveaux de bruit variables que le denoiser traite de façon incohérente. Corrigez cela en augmentant Min Samples à 64, en resserrant Noise Threshold à 0,005, en utilisant OpenImageDenoise (plus temporellement stable qu'OptiX), et en activant les passes Denoising Data pour une meilleure entrée du denoiser.

Q: Faut-il utiliser le rendu GPU ou CPU pour les animations Blender ? A: Les deux fonctionnent bien pour les animations Cycles. Le rendu GPU (CUDA, OptiX, HIP) est plus rapide par image mais limité par la VRAM — les scènes complexes avec de nombreuses textures peuvent dépasser la mémoire GPU. Le rendu CPU gère n'importe quelle taille de scène mais est plus lent par image. Pour les fermes de rendu, les flottes CPU offrent plus de cœurs de calcul totaux, tandis que les machines GPU offrent des temps d'image individuels plus rapides. De nombreux artistes utilisent le rendu GPU pour les scènes simples et le CPU pour les complexes.

Q: Comment reprendre un rendu d'animation échoué dans Blender ? A: Si vous avez rendu vers une séquence d'images PNG ou EXR, vérifiez votre dossier de sortie pour trouver la dernière image rendue avec succès. Définissez l'image de début sur le numéro d'image suivant et rendez à nouveau — Blender reprend là où il s'est arrêté. Si vous activez « Overwrite » dans Output Properties, les images existantes sont re-rendues ; désactivez-le pour sauter les images déjà présentes sur disque.

Q: Qu'est-ce qui cause les plantages mémoire lors des longs rendus d'animation ? A: La mémoire s'accumule généralement à cause des simulations non cuites (particules, tissu, fluide), de la mise en cache des textures et de l'historique d'annulation. Cuisez toutes les simulations sur disque avant de rendre, réduisez Undo Steps à 0 dans Preferences, et activez Persistent Images dans les paramètres de performance du rendu. Pour les animations très longues, envisagez de rendre par blocs et de redémarrer Blender entre eux pour effacer la mémoire accumulée.

Q: De combien de samples ai-je besoin pour le rendu d'animation dans Cycles ? A: Avec le denoising activé, 256 à 512 samples et un Noise Threshold de 0,01 produisent des résultats propres pour la plupart des scènes. Les intérieurs architecturaux avec des caustiques complexes peuvent nécessiter 1 024 samples. La clé pour l'animation est la cohérence — un niveau de bruit uniforme entre les images est plus prévisible à dénoiser que des niveaux variables. Utilisez le sampling adaptatif pour laisser Blender allouer des samples supplémentaires uniquement là où c'est nécessaire.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.