Che cos'è il rendering? Una guida completa

Panoramica

Che cos'è il rendering nei grafici 3D?

Ogni immagine che vedi in un film Pixar, ogni frame di una visualizzazione architettonica e ogni esplosione in un videogioco condividono un'origine comune: il rendering. Nel suo nucleo, il rendering è il processo di conversione dei dati di una scena tridimensionale — geometria, materiali, illuminazione e informazioni sulla fotocamera — in un'immagine bidimensionale che gli umani possono visualizzare su uno schermo o stampare.

Pensalo come a una fotografia, ma completamente virtuale. Un fotografo tradizionale compone una scena, posiziona una fotocamera, regola l'illuminazione e preme l'otturatore. Il rendering segue la stessa logica: un artista 3D costruisce una scena digitale, posiziona una fotocamera virtuale, definisce le sorgenti di luce e poi ordina al computer di "scattare la foto". La differenza è che ogni fotone di luce, ogni riflessione superficiale e ogni ombra deve essere calcolata matematicamente piuttosto che catturata otticamente.

Il rendering è presente in quasi ogni industria visiva. Gli studi cinematografici lo usano per creare personaggi e ambienti fotorealistici. Gli studi di architettura producono presentazioni ai clienti indistinguibili da fotografie. Gli sviluppatori di giochi generano milioni di frame al secondo per mantenere il gameplay fluido. I ricercatori medici visualizzano strutture anatomiche complesse. I designer di prodotti iterano sui prototipi senza realizzare una singola unità fisica.

Questa guida esplora come funziona il rendering, le principali tecniche coinvolte, il software che lo alimenta, e cosa succede quando una singola workstation non è più sufficiente.

Rendering in tempo reale vs Rendering offline

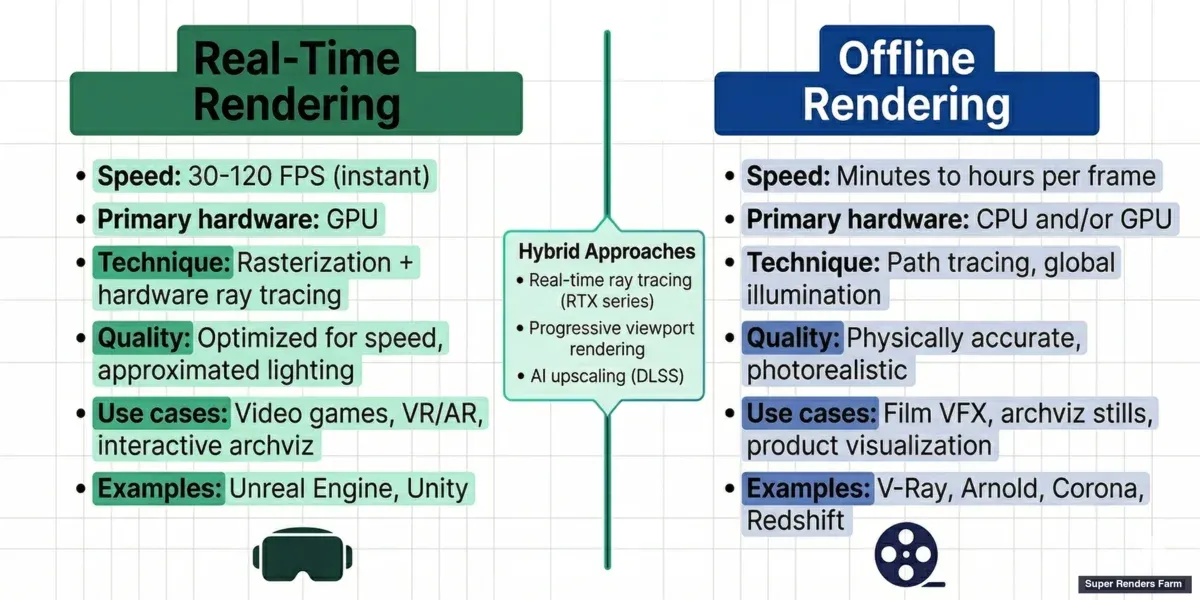

Il rendering si divide in due paradigmi fondamentali in base ai requisiti di velocità: tempo reale e offline.

Il rendering in tempo reale produce immagini abbastanza velocemente per l'uso interattivo — tipicamente da 30 a 120 frame al secondo. I videogiochi, la realtà virtuale, la realtà aumentata e le visualizzazioni architettoniche interattive dipendono tutte dal rendering in tempo reale. La GPU gestisce la maggior parte del calcolo, utilizzando algoritmi ottimizzati che danno priorità alla velocità rispetto all'accuratezza fisica assoluta. Tecnologie come la rasterizzazione (proiezione di triangoli 3D su uno schermo 2D) e il ray tracing accelerato da hardware (introdotto con l'architettura RTX di NVIDIA) lo rendono possibile.

Il rendering offline (chiamato anche pre-rendering) dà priorità alla qualità dell'immagine rispetto alla velocità. Un singolo frame potrebbe richiedere minuti, ore o persino giorni per essere calcolato. I film di livello professionale, l'animazione per la trasmissione, le immagini architettoniche fisse e la visualizzazione di prodotti di solito utilizzano il rendering offline. L'obiettivo è il fotorealismo o un aspetto artistico specifico, e il tempo di calcolo extra consente una simulazione della luce fisicamente accurata — illuminazione globale, caustiche, diffusione subsuperficiale e effetti volumetrici che i motori in tempo reale approssimano ma non possono completamente replicare.

Gli approcci ibridi stanno diventando sempre più comuni. Il ray tracing in tempo reale su GPU moderne (serie NVIDIA RTX, AMD RDNA 3+) porta alcuni effetti di qualità offline nei flussi di lavoro interattivi. Il rendering progressivo nelle anteprime dei viewport — disponibile in motori come V-Ray e Redshift — consente agli artisti di vedere un risultato approssimativo in pochi secondi che si perfeziona nel tempo. Le tecniche assistite dall'IA come NVIDIA DLSS utilizzano reti neurali per sottocampionare rendering a risoluzione inferiore, moltiplicando efficacemente le prestazioni senza una perdita di qualità proporzionale.

Real-time rendering vs offline rendering comparison — speed, quality, and use cases for games, film, and architecture

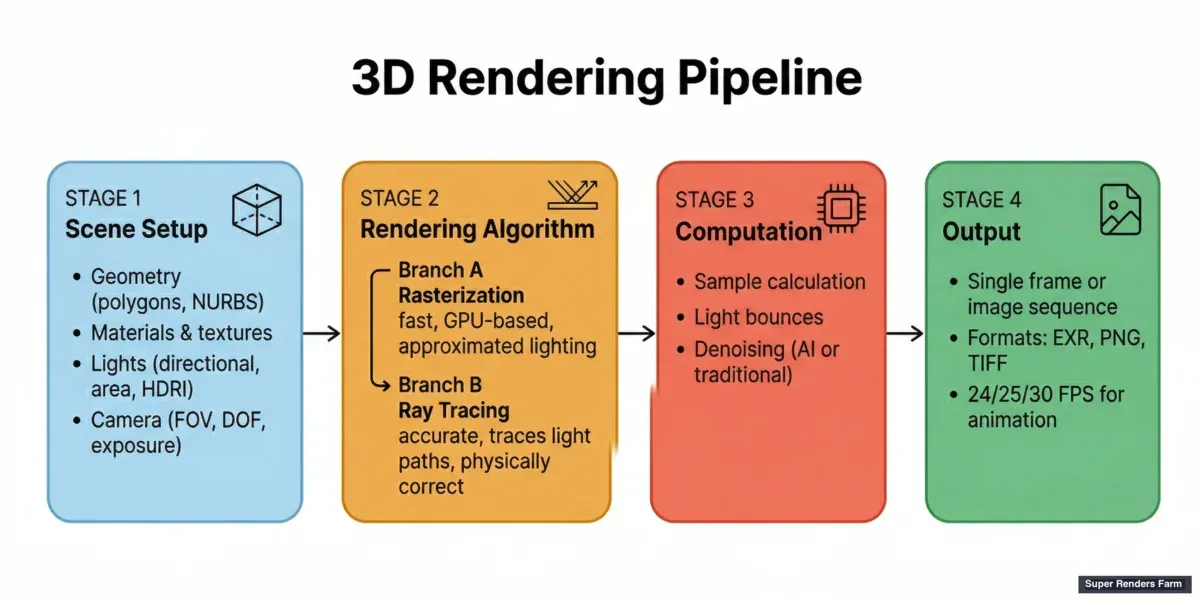

Come funziona il rendering: la pipeline tecnica

Comprendere la pipeline di rendering aiuta a chiarire cosa succede tra il clic su "Renderizza" e la visualizzazione di un'immagine finita.

La configurazione della scena arriva per prima. L'artista definisce la geometria (le forme 3D — poligoni, NURBS, superfici di suddivisione), applica materiali e texture (come appaiono le superfici — colore, riflettività, ruvidità, trasparenza), posiziona luci (direzionali, puntiformi, area, mappe ambientali) e posiziona una fotocamera virtuale (campo visivo, profondità di campo, esposizione).

L'algoritmo di rendering elabora quindi questa scena. Le due famiglie dominanti di algoritmi sono:

La rasterizzazione proietta ogni triangolo 3D della scena sullo schermo 2D, determinando quali pixel copre e quale colore dovrebbero avere quei pixel. È estremamente veloce — le GPU moderne possono rasterizzare miliardi di triangoli al secondo — ma gestisce l'illuminazione indiretta e le riflessioni attraverso approssimazioni (mappe di ombre, riflessi nello spazio dello schermo, light probe). La rasterizzazione alimenta praticamente tutto il rendering in tempo reale.

Il ray tracing simula la luce in modo più accurato tracciando il percorso dei singoli raggi dalla fotocamera attraverso ogni pixel e nella scena. Quando un raggio colpisce una superficie, può rimbalzare, rifrangere o disperdersi, generando raggi secondari che interagiscono con altri oggetti. Il path tracing è una forma specifica di ray tracing che segue i raggi attraverso molti rimbalzi per convergere su un risultato fisicamente accurato. Il ray tracing gestisce naturalmente riflessioni, rifrazioni, ombre morbide e illuminazione globale ma richiede significativamente più calcolo.

Altre tecniche esistono per casi d'uso specifici. La radiosity calcola il trasferimento di energia luminosa tra le superfici e eccelle nelle inter-riflessioni diffuse e morbide nelle scene architettoniche. Il photon mapping gestisce le caustiche (i motivi di luce focalizzata che vedi sul fondo di una piscina) in modo più efficiente del pure path tracing.

L'output è il passaggio finale. Una singola immagine renderizzata è chiamata frame. Per l'animazione, il renderer produce una sequenza di frame — tipicamente 24, 25 o 30 al secondo per film e trasmissioni, o superiore per il lavoro in slow-motion. I formati di output includono EXR (gamma dinamica elevata, standard industriale per VFX compositing), PNG (senza perdita, adatto per immagini fisse), TIFF e JPEG.

3D rendering pipeline diagram — scene setup, rendering algorithm, and output stages

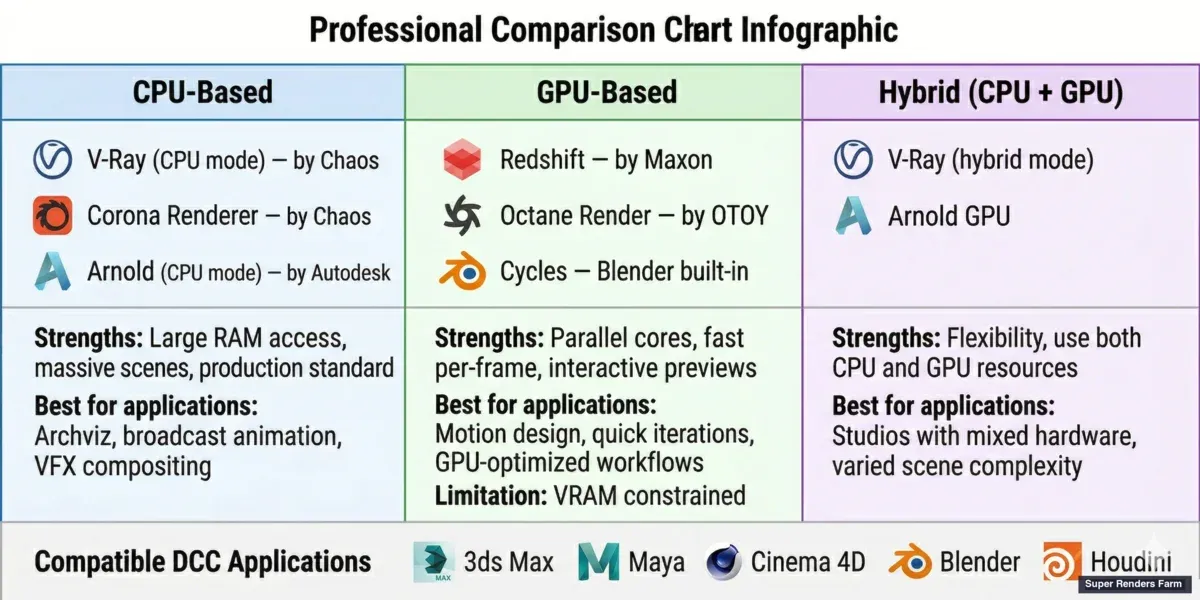

Motori di render: il software che fa il lavoro

Un motore di render è il componente software che esegue l'algoritmo di rendering. La maggior parte delle applicazioni 3D viene fornita con un renderer integrato ma supporta anche motori di terze parti che offrono capacità specializzate.

I motori di render basati su CPU vengono eseguiti principalmente sul processore. Possono sfruttare grandi quantità di RAM di sistema, rendendoli adatti a scene con geometria massiccia o dataset di texture. Gli esempi includono V-Ray (modalità CPU), Corona Renderer e Arnold. V-Ray e Corona Renderer sono sviluppati da Chaos, mentre Arnold è un prodotto Autodesk. Il rendering su CPU è stato lo standard di produzione per decenni e rimane il motore principale per la visualizzazione architettonica, l'animazione per la trasmissione e il VFX compositing.

I motori di render basati su GPU vengono eseguiti sulla scheda grafica, sfruttando i migliaia di core paralleli della GPU per accelerare drasticamente il rendering. Redshift (un prodotto Maxon), Octane Render, V-Ray GPU e Cycles (il motore integrato di Blender) rientrano tutti in questa categoria. Il rendering su GPU è tipicamente più veloce per frame ma è limitato dalla VRAM disponibile — le scene che superano la memoria della GPU devono ricorrere al rendering out-of-core o al processing su CPU.

I motori ibridi possono utilizzare sia le risorse CPU che GPU. V-Ray, ad esempio, offre sia la modalità di rendering su CPU che su GPU e può combinarle in un singolo render. Arnold ha aggiunto il supporto GPU nelle versioni recenti.

CPU vs GPU render engines comparison — V-Ray, Corona, Arnold, Redshift, Octane, and Cycles

Questi motori si collegano alle principali applicazioni 3D: Autodesk 3ds Max, Autodesk Maya, Maxon Cinema 4D, Blender e SideFX Houdini. La scelta del motore dipende dai requisiti del progetto — velocità, qualità, spazio di memoria e compatibilità della pipeline. Per un confronto più approfondito di come V-Ray funziona su diversi host 3D, consulta il nostro confronto tra V-Ray per Blender e 3ds Max.

Sfide comuni nel rendering

Anche con hardware potente e software maturo, il rendering presenta sfide ricorrenti in produzione.

I lunghi tempi di rendering sono il collo di bottiglia più universale. Un singolo frame di uno spazio interno architettonico complesso con illuminazione globale, texture ad alta risoluzione e vegetazione dettagliata (Forest Pack, RailClone) può richiedere da 20 minuti a diverse ore su una workstation di fascia alta. Moltiplicalo per migliaia di frame per un'animazione e una singola macchina diventa rapidamente impraticabile. La nostra guida all'ottimizzazione dei tempi di rendering copre tecniche pratiche per ridurre i tempi di rendering per frame senza sacrificare la qualità.

Le limitazioni di memoria vincono ciò che una scena può contenere. Il rendering su GPU è particolarmente sensibile ai limiti di VRAM — una scena che si adatta comodamente a 64 GB di RAM di sistema potrebbe non funzionare su una GPU con 24 GB di VRAM. Le mappe di spostamento, la vegetazione ad alta densità di poligoni, i sistemi di particelle e le mappe texture 8K+ contribuiscono tutti alla pressione della memoria. Comprendere la differenza tra rendering su GPU e CPU aiuta quando si pianifica una pipeline.

Il rumore e gli artefatti appaiono quando il renderer non ha calcolato abbastanza campioni di luce. Il path tracing produce rumore che diminuisce man mano che vengono calcolati più campioni, ma raggiungere un risultato pulito richiede tempo. I denoiser — sia tradizionali (ad es., Intel Open Image Denoise) che basati su IA (NVIDIA OptiX, denoiser integrato di V-Ray) — possono ridurre il rumore visibile senza richiedere il conteggio completo dei campioni, ma il denoising aggressivo può offuscare i dettagli fini.

La gestione del colore assicura che le immagini renderizzate abbiano un aspetto coerente su display diversi e nel compositing. ACES (Academy Color Encoding System) è diventato lo standard della pipeline di colore nel cinema e nella visualizzazione di alta fascia, mentre sRGB rimane comune per l'output web e game.

Per un riferimento completo per la risoluzione dei problemi, la nostra guida ai problemi comuni di rendering e soluzioni affronta i problemi che i team di produzione incontrano più frequentemente.

Render farm: scalare il rendering oltre una singola macchina

Quando le esigenze di rendering di un progetto superano ciò che una singola workstation può fornire — migliaia di frame di animazione, una scadenza ristretta o scene troppo complesse per l'hardware locale — il passo successivo è una render farm.

Una render farm è una raccolta di computer in rete (chiamati nodi) che dividono il lavoro di rendering tra loro. Invece di una macchina che impiega 100 ore per renderizzare 1.000 frame in sequenza, una farm con 100 nodi può completare lo stesso lavoro in approssimativamente 1 ora renderizzando i frame in parallelo. Questo concetto di rendering distribuito è come gli studi di tutte le dimensioni soddisfano i tempi di scadenza della produzione senza acquistare centinaia di macchine direttamente.

Ci sono due approcci principali. Costruire una render farm privata significa acquistare, ospitare e mantenere il tuo hardware — un'opzione che ha senso per gli studi con esigenze di rendering costanti e ad alto volume e il personale tecnico per gestire l'infrastruttura. Le render farm cloud forniscono la stessa capacità di rendering parallelo come servizio: carichi la tua scena, la farm la renderizza su molti nodi simultaneamente e scarichi i frame finiti. Nessun acquisto di hardware, nessuna manutenzione, nessuna macchina inattiva tra i progetti. Per una spiegazione più ampia del rendering basato sul cloud, consulta la nostra guida al rendering cloud.

Le render farm cloud stesse vengono in due modelli. Le farm self-service (IaaS) ti danno accesso remoto a macchine virtuali — installi il software, gestisci le licenze e risolvi i problemi tu stesso. Le farm completamente gestite gestiscono l'intera pipeline: installazione del software, compatibilità dei plugin, gestione delle licenze e supporto tecnico. Carichi un file di scena, configuri le impostazioni di rendering e ricevi i frame finiti. Per ulteriori informazioni su come questi modelli differiscono, consulta il nostro confronto tra render farm completamente gestite vs DIY.

Super Renders Farm funziona come una render farm cloud completamente gestita, supportando i principali motori di render — V-Ray, Corona, Arnold, Redshift, Octane e Cycles — su 3ds Max, Maya, Cinema 4D, Blender, Houdini, After Effects e NukeX. Come partner ufficiale Chaos e Maxon, SuperRenders include il rendering con licenza per i motori supportati senza costi aggiuntivi. L'infrastruttura funziona su più di 20.000 core CPU e una flotta GPU dedicata con NVIDIA RTX 5090 (32 GB VRAM per scheda), gestendo sia i carichi di lavoro di visualizzazione architettonica pesanti su CPU che le pipeline di motion design accelerate su GPU.

Per un'analisi dettagliata di come appaiono i costi di rendering su base per-frame, consulta la nostra guida ai costi delle render farm. Gli studi che considerano se il rendering cloud si adatta al loro budget potrebbero trovare utile anche la nostra guida su cos'è una render farm cloud come punto di partenza.

Il futuro del rendering

Diversi trend stanno plasmando dove si dirige il rendering.

Il rendering assistito dall'IA è già pronto per la produzione. I denoiser basati su IA riducono il numero di campioni necessari per un'immagine pulita, riducendo significativamente i tempi di rendering. NVIDIA DLSS 4, rilasciato insieme alla serie RTX 50, utilizza Multi-Frame Generation per produrre più frame generati da IA per ogni frame renderizzato nativamente. Le reti di upscaling ricostruiscono immagini ad alta risoluzione da rendering a bassa risoluzione con minima perdita di qualità visibile. Questi strumenti non sostituiscono gli algoritmi di rendering sottostanti — li accelerano.

Il neural rendering rappresenta un cambiamento più fondamentale. Tecniche come Neural Radiance Fields (NeRF) e 3D Gaussian Splatting addestrano reti neurali per rappresentare scene intere, abilitando la sintesi di nuovi punti di vista senza rendering tradizionale basato sulla geometria. Come Jensen Huang ha sottolineato nei recenti keynote, il neural rendering rappresenta una direzione importante per il settore. Le pipeline di produzione attuali usano il neural rendering principalmente per la previsualizzazione e il layout piuttosto che per output di qualità finale, ma il divario si sta colmando.

I flussi di lavoro nativi del cloud stanno spostando il rendering da un'attività su macchina locale a un servizio cloud integrato. Gli studi sempre più frequentemente inviano scene direttamente alle render farm cloud dalle loro applicazioni 3D piuttosto che esportare e caricare manualmente. Ciò riduce l'attrito e rende il rendering distribuito accessibile ai freelancer e ai piccoli studi, non solo alle grandi strutture.

Il path tracing in tempo reale continua a migliorare. Ogni generazione di GPU avvicina ulteriormente il ray tracing hardware alla qualità offline con frame rate interattivi. Per applicazioni non interattive come archviz e visualizzazione di prodotti, i motori in tempo reale stanno iniziando a produrre risultati che in precedenza richiedevano renderer offline.

FAQ

Qual è la differenza tra rendering e modellazione?

La modellazione è il processo di creazione della geometria 3D — le forme, le superfici e la struttura degli oggetti in una scena. Il rendering è ciò che accade dopo la modellazione: il computer calcola come la luce interagisce con quelle superfici per produrre un'immagine 2D finale. La modellazione definisce come la scena appare strutturalmente; il rendering definisce come appare visivamente.

Quanto tempo richiede il rendering?

I tempi di rendering variano enormemente a seconda della complessità della scena, della risoluzione, del motore di render e dell'hardware. Un semplice scatto di prodotto potrebbe renderizzare in pochi secondi su una GPU moderna. Uno spazio interno architettonico complesso con illuminazione globale può richiedere da 20 minuti a diverse ore per frame su una workstation di fascia alta. I progetti di animazione con migliaia di frame spesso utilizzano render farm per parallelizzare il carico di lavoro e rispettare i tempi di scadenza.

Qual è la differenza tra rendering su CPU e GPU?

Il rendering su CPU utilizza il processore del computer e la RAM di sistema, rendendolo adatto a scene che richiedono molta memoria con grandi dataset di texture. Il rendering su GPU utilizza i core di elaborazione parallela della scheda grafica per velocità per-frame più elevate ma è limitato dalla VRAM disponibile. Molti moderni motori di render supportano entrambi — la scelta dipende dalla complessità della scena, dai requisiti di memoria e dalla pressione delle scadenze.

Che cos'è il ray tracing?

Il ray tracing è una tecnica di rendering che simula la luce tracciando il percorso dei singoli raggi dalla fotocamera attraverso la scena. Quando i raggi colpiscono le superfici, rimbalzano, si rifrangono o si disperdono — producendo riflessioni, ombre e illuminazione fisicamente accurate. Il path tracing estende questo seguendo i raggi attraverso molti rimbalzi per calcolare l'illuminazione globale. Il ray tracing produce risultati più realistici della rasterizzazione ma richiede più calcolo.

Ho bisogno di un computer potente per renderizzare?

Per scene semplici e lavoro in tempo reale, una workstation di medio livello con una moderna GPU gestisce il rendering comodamente. Per il rendering di qualità produzione offline — specialmente sequenze di animazione o immagini fisse ad alta risoluzione — hardware più potente riduce significativamente i tempi di attesa. Le render farm cloud offrono un'alternativa: invece di investire in costoso hardware locale, puoi scaricare il rendering su infrastruttura remota e pagare solo il tempo di calcolo utilizzato.

Che cos'è una render farm?

Una render farm è una rete di computer che lavorano insieme per renderizzare i frame in parallelo. Invece di una macchina che renderizza un'animazione di 1.000 frame sequenzialmente, centinaia di macchine possono renderizzare simultaneamente frame diversi, riducendo il tempo di rendering totale da giorni a ore. Le render farm possono essere costruite internamente o accessibili come servizio cloud. Leggi la nostra guida completa alle render farm cloud per una spiegazione completa.

Quali formati di file produce il rendering?

I formati di output comuni includono EXR (gamma dinamica elevata, standard per VFX compositing e color grading), PNG (senza perdita, adatto per web e stampa), TIFF (senza perdita, utilizzato in stampa e archivio) e JPEG (con perdita, dimensione file più piccola per anteprime). Per l'animazione, i frame vengono generalmente renderizzati come sequenze di immagini (un file per frame) piuttosto che file video, dando ai compositori la massima flessibilità in post-produzione.

Il rendering può essere fatto nel cloud?

Sì. Le render farm cloud distribuiscono il tuo carico di lavoro di rendering su molte macchine remote, fornendo frame finiti senza richiedere investimento in hardware locale. I servizi vanno da piattaforme self-service dove gestisci le tue stesse macchine virtuali a render farm completamente gestite che gestiscono la configurazione del software, le licenze e il supporto. Il rendering cloud è particolarmente prezioso per progetti di animazione, scadenze ristrette e studi che hanno bisogno di capacità scalabile senza mantenere la loro propria infrastruttura.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.