Qu'est-ce que le rendu ? Guide complet du rendu infographique

Aperçu

Qu'est-ce que le rendu en infographie ?

Chaque image que vous voyez dans un film Pixar, chaque frame d'une visite architecturale, et chaque explosion d'un jeu vidéo partage une origine commune : le rendu. Dans son essence, le rendu est le processus de conversion de données de scène tridimensionnelles — géométrie, matériaux, éclairage et informations de caméra — en image bidimensionnelle que les humains peuvent voir sur un écran ou imprimer.

Pensez-y comme à de la photographie, mais entièrement virtuelle. Un photographe traditionnel compose une scène, positionne une caméra, ajuste l'éclairage et appuie sur le déclencheur. Le rendu suit la même logique : un artiste 3D construit une scène numérique, place une caméra virtuelle, définit les sources de lumière, puis demande à l'ordinateur de « prendre la photo ». La différence est que chaque photon de lumière, chaque réflexion de surface et chaque ombre doit être calculée mathématiquement plutôt que capturée optiquement.

Le rendu apparaît dans presque tous les secteurs visuels. Les studios de cinéma l'utilisent pour créer des personnages et des environnements photoréalistes. Les cabinets d'architecture produisent des présentations clients qui semblent indistinguibles des photographies. Les développeurs de jeux génèrent des millions de frames par seconde pour maintenir la fluidité du jeu. Les chercheurs en médecine visualisent des structures anatomiques complexes. Les concepteurs de produits itèrent sur des prototypes sans fabriquer une seule unité physique.

Ce guide explique le fonctionnement du rendu, les principales techniques impliquées, les logiciels qui l'alimentent, et ce qui se passe quand une seule station de travail ne suffit plus.

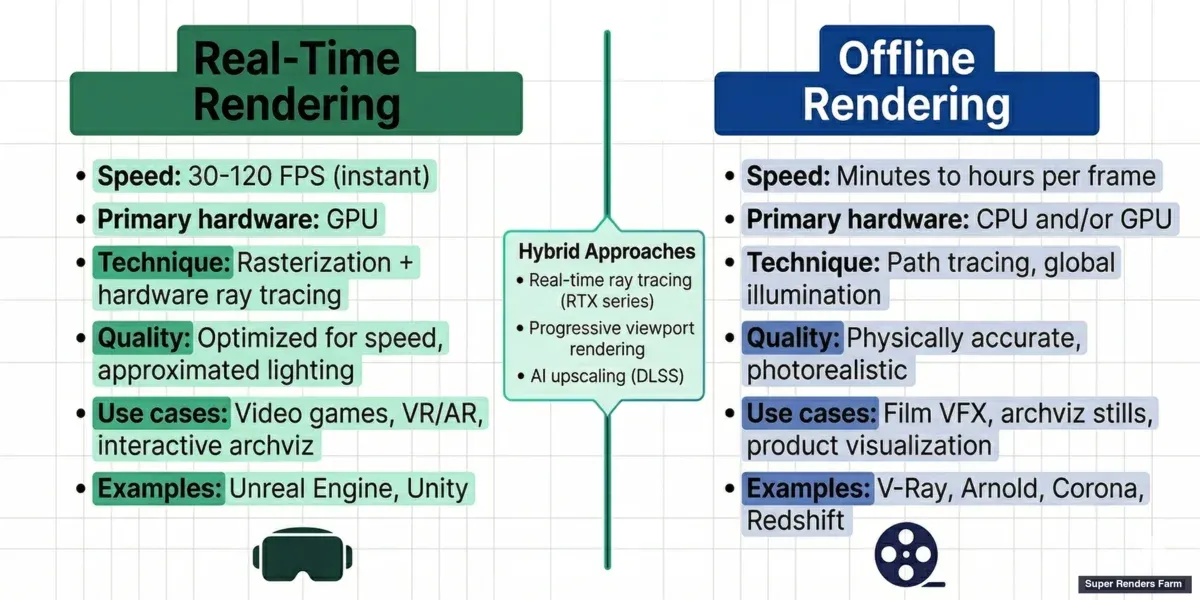

Rendu temps réel vs rendu hors ligne

Le rendu se divise en deux paradigmes fondamentaux en fonction des exigences de vitesse : le temps réel et le hors ligne.

Le rendu temps réel produit des images assez rapidement pour une utilisation interactive — généralement 30 à 120 images par seconde. Les jeux vidéo, la réalité virtuelle, la réalité augmentée et les visualisations architecturales interactives dépendent tous du rendu temps réel. Le GPU traite la plupart du calcul, en utilisant des algorithmes optimisés qui privilégient la vitesse par rapport à la précision physique absolue. Les technologies comme la rastérisation (projeter des triangles 3D sur un écran 2D) et le lancer de rayons accéléré matériellement (introduit avec l'architecture RTX de NVIDIA) le rendent possible.

Le rendu hors ligne (aussi appelé pré-rendu) privilégie la qualité d'image par rapport à la vitesse. Une seule image peut prendre des minutes, des heures ou même des jours à calculer. Les films de cinéma, les animations pour la diffusion, les images architecturales fixes et la visualisation de produits utilisent généralement le rendu hors ligne. L'objectif est le photoréalisme ou un look artistique spécifique, et le temps de calcul supplémentaire permet une simulation de lumière physiquement précise — illumination globale, caustiques, diffusion subsurfacique et effets volumétriques que les moteurs temps réel peuvent approximer mais ne peuvent pas reproduire entièrement.

Les approches hybrides deviennent de plus en plus courantes. Le lancer de rayons temps réel sur les GPU modernes (séries NVIDIA RTX, AMD RDNA 3+) apporte certains effets de qualité hors ligne dans les workflows interactifs. Le rendu progressif dans les aperçus de viewport — disponible dans des moteurs comme V-Ray et Redshift — permet aux artistes de voir un résultat approximatif en quelques secondes qui s'affine au fil du temps. Les techniques assistées par IA comme NVIDIA DLSS utilisent des réseaux de neurones pour upscaler les rendus basse résolution, multipliant effectivement les performances sans perte de qualité proportionnelle.

Real-time rendering vs offline rendering comparison — speed, quality, and use cases for games, film, and architecture

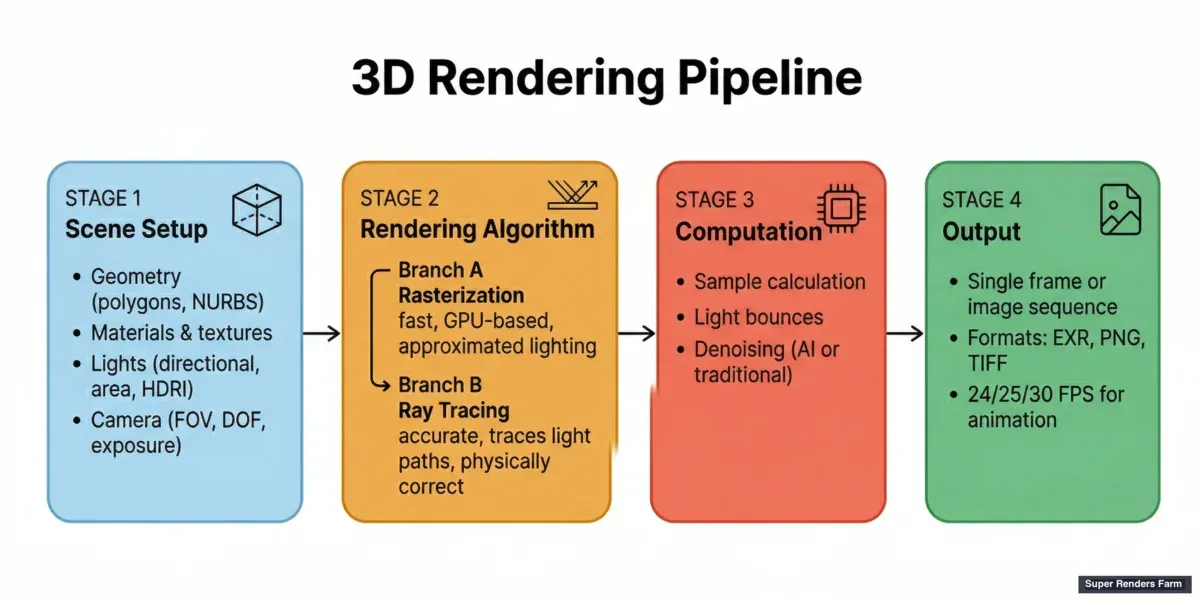

Comment fonctionne le rendu : le pipeline technique

Comprendre le pipeline de rendu aide à démystifier ce qui se passe entre le clic sur « Rendu » et la visualisation d'une image finie.

La configuration de scène vient en premier. L'artiste définit la géométrie (les formes 3D — polygones, NURBS, surfaces de subdivision), applique les matériaux et textures (l'aspect des surfaces — couleur, réflectivité, rugosité, transparence), place les lumières (directionnelle, ponctuelle, surfacique, cartes d'environnement) et positionne une caméra virtuelle (champ de vision, profondeur de champ, exposition).

L'algorithme de rendu traite ensuite cette scène. Les deux familles d'algorithmes dominantes sont :

La rastérisation projette chaque triangle 3D de la scène sur l'écran 2D, déterminant les pixels qu'il couvre et la couleur que ces pixels doivent avoir. Elle est extrêmement rapide — les GPU modernes peuvent rastériser des milliards de triangles par seconde — mais elle gère l'éclairage indirect et les réflexions via des approximations (shadow maps, réflexions en espace écran, light probes). La rastérisation alimente pratiquement tout le rendu temps réel.

Le lancer de rayons simule la lumière plus précisément en traçant le chemin des rayons individuels de la caméra à travers chaque pixel et dans la scène. Quand un rayon frappe une surface, il peut rebondir, se réfracter ou se disperser, générant des rayons secondaires qui interagissent avec d'autres objets. Le lancer de chemin (path tracing) est une forme spécifique du lancer de rayons qui suit les rayons à travers de nombreux rebonds pour converger vers un résultat physiquement précis. Le lancer de rayons gère naturellement les réflexions, les réfractions, les ombres douces et l'illumination globale mais nécessite considérablement plus de calcul.

D'autres techniques existent pour des cas d'usage spécifiques. La radiosité calcule le transfert d'énergie lumineuse entre les surfaces et excelle aux inter-réflexions douces et diffuses dans les scènes architecturales. Le photon mapping gère plus efficacement les caustiques (les motifs de lumière focalisée que vous voyez au fond d'une piscine) que le pur lancer de chemin.

La sortie est l'étape finale. Une seule image rendue s'appelle un frame. Pour l'animation, le renderer produit une séquence d'images — généralement 24, 25 ou 30 par seconde pour le cinéma et la diffusion, ou plus pour le travail au ralenti. Les formats de sortie incluent EXR (plage dynamique élevée, norme industrielle pour la composition VFX), PNG (sans perte, approprié pour les images fixes), TIFF et JPEG.

3D rendering pipeline diagram — scene setup, rendering algorithm, and output stages

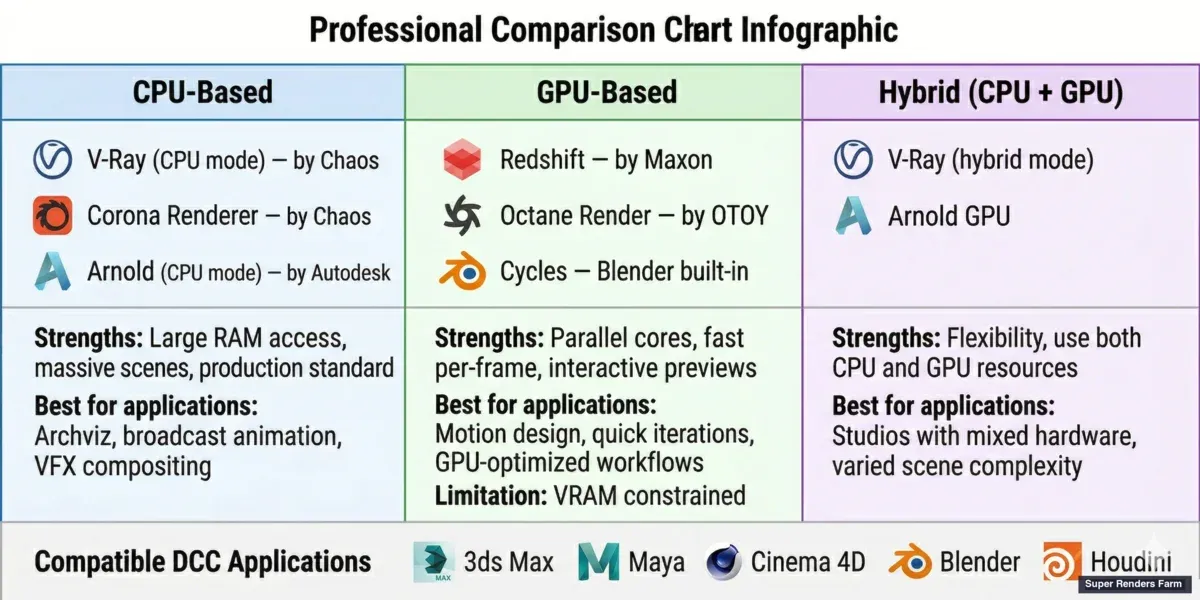

Moteurs de rendu : le logiciel qui fait le travail

Un moteur de rendu est le composant logiciel qui exécute l'algorithme de rendu. La plupart des applications 3D sont livrées avec un renderer intégré mais supportent aussi des moteurs tiers qui offrent des capacités spécialisées.

Les moteurs de rendu basés sur CPU fonctionnent principalement sur le processeur. Ils peuvent exploiter de grandes quantités de RAM système, ce qui les rend adaptés aux scènes avec une géométrie massive ou des ensembles de données de texture. Les exemples incluent V-Ray (mode CPU), Corona Renderer et Arnold. V-Ray et Corona sont développés par Chaos, tandis qu'Arnold est un produit Autodesk. Le rendu CPU a été la norme de production depuis des décennies et reste le moteur de travail pour la visualisation architecturale, l'animation pour la diffusion et la composition VFX.

Les moteurs de rendu basés sur GPU fonctionnent sur la carte graphique, exploitant les milliers de cœurs parallèles du GPU pour accélérer dramatiquement le rendu. Redshift (un produit Maxon), Octane Render, V-Ray GPU et Cycles (le moteur intégré de Blender) entrent tous dans cette catégorie. Le rendu GPU est généralement plus rapide par frame mais est limité par la VRAM disponible — les scènes qui dépassent la mémoire du GPU doivent revenir au rendu hors-core ou au traitement CPU.

Les moteurs hybrides peuvent utiliser les ressources CPU et GPU. V-Ray, par exemple, offre des modes de rendu CPU et GPU et peut les combiner dans un seul rendu. Arnold a aussi ajouté le support GPU dans les versions récentes.

CPU vs GPU render engines comparison — V-Ray, Corona, Arnold, Redshift, Octane, and Cycles

Ces moteurs se connectent aux principales applications 3D : Autodesk 3ds Max, Autodesk Maya, Maxon Cinema 4D, Blender et SideFX Houdini. Le choix du moteur dépend des exigences du projet — vitesse, qualité, espace mémoire et compatibilité pipeline. Pour une comparaison plus approfondie de la performance de V-Ray sur différents hôtes 3D, voir notre comparaison V-Ray pour Blender vs 3ds Max.

Défis courants du rendu

Même avec un matériel puissant et un logiciel mature, le rendu présente des défis récurrents en production.

Les temps de rendu longs sont le goulot d'étranglement le plus universel. Une seule image d'un intérieur architectural complexe avec illumination globale, textures haute résolution et végétation détaillée (Forest Pack, RailClone) peut prendre 20 minutes à plusieurs heures sur une station de travail haut de gamme. Multipliez cela par des milliers de frames pour une animation, et une seule machine devient rapidement impraticable. Notre guide d'optimisation du temps de rendu couvre des techniques pratiques pour réduire les temps de rendu par frame sans sacrifier la qualité.

Les limitations de mémoire contraignent ce qu'une scène peut contenir. Le rendu GPU est particulièrement sensible aux limites VRAM — une scène qui tient confortablement dans 64 GB de RAM système peut échouer sur un GPU avec 24 GB de VRAM. Les cartes de déplacement, la végétation haute résolution, les systèmes de particules et les textures 8K+ contribuent tous à la pression mémoire. Comprendre la différence entre le rendu GPU et CPU aide à planifier un pipeline.

Le bruit et les artefacts apparaissent quand le renderer n'a pas calculé assez d'échantillons de lumière. Le lancer de chemin produit du bruit qui diminue à mesure que plus d'échantillons sont calculés, mais atteindre un résultat propre prend du temps. Les dénoiseurs — traditionnels (par ex., Intel Open Image Denoise) et assistés par IA (NVIDIA OptiX, le débruiteur intégré de V-Ray) — peuvent réduire le bruit visible sans nécessiter le nombre d'échantillons complet, mais un débruitage agressif peut flouter les détails fins.

La gestion des couleurs assure que les images rendues semblent cohérentes sur différents écrans et en composition. ACES (Academy Color Encoding System) est devenu la norme pipeline de couleur dans le cinéma et la visualisation haut de gamme, tandis que sRGB reste courant pour la sortie web et jeu.

Pour une référence de dépannage complète, notre guide sur les problèmes de rendu courants et les solutions aborde les problèmes que les équipes de production rencontrent le plus souvent.

Fermes de rendu : montée en charge du rendu au-delà d'une seule machine

Quand les demandes de rendu d'un projet dépassent ce qu'une seule station de travail peut fournir — des milliers de frames d'animation, une échéance serrée ou des scènes trop complexes pour le matériel local — l'étape suivante est une ferme de rendu.

Une ferme de rendu est une collection d'ordinateurs en réseau (appelés nœuds) qui partagent le travail de rendu entre eux. Au lieu qu'une seule machine passe 100 heures à rendre 1 000 frames séquentiellement, une ferme avec 100 nœuds peut accomplir le même travail en à peu près 1 heure en rendant les frames en parallèle. Ce concept de rendu distribué est comment les studios de toutes tailles respectent les délais de production sans acheter des centaines de machines d'emblée.

Il y a deux approches principales. Construire une ferme de rendu privée signifie acheter, héberger et maintenir votre propre matériel — une option qui a du sens pour les studios avec des besoins de rendu constants et de haut volume et le personnel technique pour gérer l'infrastructure. Les fermes de rendu cloud offrent la même capacité de rendu parallèle en tant que service : vous téléchargez votre scène, la ferme la rend sur de nombreux nœuds simultanément, et vous téléchargez les frames finis. Aucun achat de matériel, aucune maintenance, aucune machine inactive entre les projets. Pour une explication plus large du rendu basé sur le cloud, voir notre guide de rendu cloud.

Les fermes de rendu cloud elles-mêmes se présentent sous deux modèles. Les fermes libre-service (IaaS) vous donnent un accès à distance à des machines virtuelles — vous installez le logiciel, gérez les licences et dépannez les problèmes vous-même. Les fermes entièrement gérées gèrent le pipeline entier : installation du logiciel, compatibilité des plugins, gestion des licences et support technique. Vous téléchargez un fichier de scène, configurez les paramètres de rendu et recevez les frames finis. Pour plus d'informations sur la façon dont ces modèles diffèrent, voir notre comparaison des fermes de rendu entièrement gérées vs DIY.

Super Renders Farm fonctionne comme une ferme de rendu cloud entièrement gérée, supportant les principaux moteurs de rendu — V-Ray, Corona, Arnold, Redshift, Octane et Cycles — sur 3ds Max, Maya, Cinema 4D, Blender, Houdini, After Effects et NukeX. En tant que partenaire officiel Chaos et Maxon, SuperRenders inclut le rendu sous licence pour les moteurs supportés sans frais supplémentaires. L'infrastructure fonctionne sur plus de 20 000 cœurs CPU et une flotte GPU dédiée avec NVIDIA RTX 5090 (32 GB VRAM par carte), gérant à la fois les charges de travail de visualisation architecturale lourdes en CPU et les pipelines de motion design accélérés par GPU.

Pour une ventilation détaillée de ce que coûte le rendu par frame, voir notre guide des coûts de ferme de rendu. Les studios qui envisagent si le rendu cloud correspond à leur budget peuvent aussi trouver utile notre guide sur ce qu'est une ferme de rendu cloud comme point de départ.

L'avenir du rendu

Plusieurs tendances façonnent la direction du rendu.

Le rendu assisté par IA est déjà prêt pour la production. Les dénoiseurs IA réduisent le nombre d'échantillons nécessaires pour une image propre, réduisant considérablement les temps de rendu. NVIDIA DLSS 4, lancé aux côtés de la série RTX 50, utilise Multi-Frame Generation pour produire plusieurs frames générés par IA par frame nativement rendu. Les réseaux d'upscaling reconstruisent des images haute résolution à partir de rendus basse résolution avec une perte de qualité minimale visible. Ces outils ne remplacent pas les algorithmes de rendu sous-jacents — ils les accélèrent.

Le rendu neuronal représente un changement plus fondamental. Les techniques comme Neural Radiance Fields (NeRF) et 3D Gaussian Splatting entraînent des réseaux de neurones pour représenter des scènes entières, permettant la synthèse de nouvelles vues sans rendu traditionnel basé sur la géométrie. Comme Jensen Huang l'a souligné dans ses récentes keynotes, le rendu neuronal représente une direction majeure pour l'industrie. Les pipelines de production actuels utilisent le rendu neuronal principalement pour la prévisualisation et la mise en page plutôt que pour la sortie de qualité finale, mais l'écart se réduit.

Les workflows cloud-natifs déplacent le rendu d'une tâche locale à un service cloud intégré. Les studios envoient de plus en plus les scènes directement aux fermes de rendu cloud depuis leurs applications 3D plutôt que d'exporter et télécharger manuellement. Cela réduit les frictions et rend le rendu distribué accessible aux freelances et petits studios, pas seulement aux grandes installations.

Le lancer de rayons temps réel continue de s'améliorer. Chaque génération de GPU rapproche le ray tracing matériel de la qualité hors ligne à des fréquences d'images interactives. Pour les applications non-interactives comme l'archviz et la visualisation de produits, les moteurs temps réel commencent à produire des résultats qui nécessitaient auparavant des renderers hors ligne.

FAQ

Q : Quelle est la différence entre le rendu et la modélisation ? A : La modélisation est le processus de création de la géométrie 3D — les formes, surfaces et structure des objets dans une scène. Le rendu est ce qui se passe après la modélisation : l'ordinateur calcule comment la lumière interagit avec ces surfaces pour produire une image 2D finale. La modélisation définit à quoi ressemble la scène structurellement ; le rendu définit à quoi elle ressemble visuellement.

Q : Combien de temps prend le rendu ? A : Les temps de rendu varient énormément en fonction de la complexité de la scène, de la résolution, du moteur de rendu et du matériel. Un simple produit shot peut rendre en quelques secondes sur un GPU moderne. Un intérieur architectural complexe avec illumination globale peut prendre 20 minutes à plusieurs heures par frame sur une station de travail haut de gamme. Les projets d'animation avec des milliers de frames utilisent souvent des fermes de rendu pour paralléliser la charge de travail et respecter les délais.

Q : Quelle est la différence entre le rendu CPU et GPU ? A : Le rendu CPU utilise le processeur de l'ordinateur et la RAM système, ce qui le rend adapté aux scènes consommatrices de mémoire avec de grands ensembles de données de texture. Le rendu GPU utilise les cœurs de traitement parallèles de la carte graphique pour des vitesses par frame plus rapides mais est limité par la VRAM disponible. Beaucoup de moteurs de rendu modernes supportent les deux — le choix dépend de la complexité de la scène, des besoins en mémoire et de la pression des délais.

Q : Qu'est-ce que le lancer de rayons ? A : Le lancer de rayons est une technique de rendu qui simule la lumière en traçant le chemin des rayons individuels de la caméra à travers la scène. Quand les rayons frappent les surfaces, ils rebondissent, se réfractent ou se dispersent — produisant des réflexions physiquement précises, des ombres et de l'éclairage. Le lancer de chemin étend ceci en suivant les rayons à travers de nombreux rebonds pour calculer l'illumination globale. Le lancer de rayons produit des résultats plus réalistes que la rastérisation mais nécessite plus de calcul.

Q : Ai-je besoin d'un ordinateur puissant pour rendre ? A : Pour les scènes simples et le travail temps réel, une station de travail moyenne avec un GPU moderne gère confortablement le rendu. Pour le rendu de qualité production hors ligne — surtout les séquences d'animation ou les images fixes haute résolution — un matériel plus puissant réduit les temps d'attente considérablement. Les fermes de rendu cloud offrent une alternative : plutôt que d'investir dans du matériel local coûteux, vous pouvez décharger le rendu sur l'infrastructure distante et payer uniquement le temps de calcul utilisé.

Q : Qu'est-ce qu'une ferme de rendu ? A : Une ferme de rendu est un réseau d'ordinateurs qui travaillent ensemble pour rendre les frames en parallèle. Au lieu qu'une seule machine rende une animation de 1 000 frames séquentiellement, des centaines de machines peuvent chacune rendre des frames différentes simultanément, réduisant le temps de rendu total de jours à heures. Les fermes de rendu peuvent être construites en interne ou accessibles comme un service cloud. Lire notre guide complet des fermes de rendu cloud pour une explication complète.

Q : Quels formats de fichier le rendu produit-il ? A : Les formats de sortie courants incluent EXR (plage dynamique élevée, norme pour la composition VFX et l'étalonnage des couleurs), PNG (sans perte, approprié pour le web et l'impression), TIFF (sans perte, utilisé en impression et archivage) et JPEG (avec perte, taille de fichier plus petite pour les aperçus). Pour l'animation, les frames sont généralement rendus en tant que séquences d'images (un fichier par frame) plutôt que des fichiers vidéo, donnant aux compositeurs une flexibilité maximale en post-production.

Q : Le rendu peut-il être fait dans le cloud ? A : Oui. Les fermes de rendu cloud distribuent votre charge de travail de rendu sur de nombreuses machines distantes, livrant des frames finis sans nécessiter d'investissement en matériel local. Les services vont des plates-formes libre-service où vous gérez vos propres machines virtuelles aux fermes entièrement gérées qui gèrent la configuration du logiciel, les licences et le support. Le rendu cloud est particulièrement précieux pour les projets d'animation, les délais serrés et les studios qui ont besoin d'une capacité scalable sans maintenir leur propre infrastructure.

About Alice Harper

Blender and V-Ray specialist. Passionate about optimizing render workflows, sharing tips, and educating the 3D community to achieve photorealistic results faster.